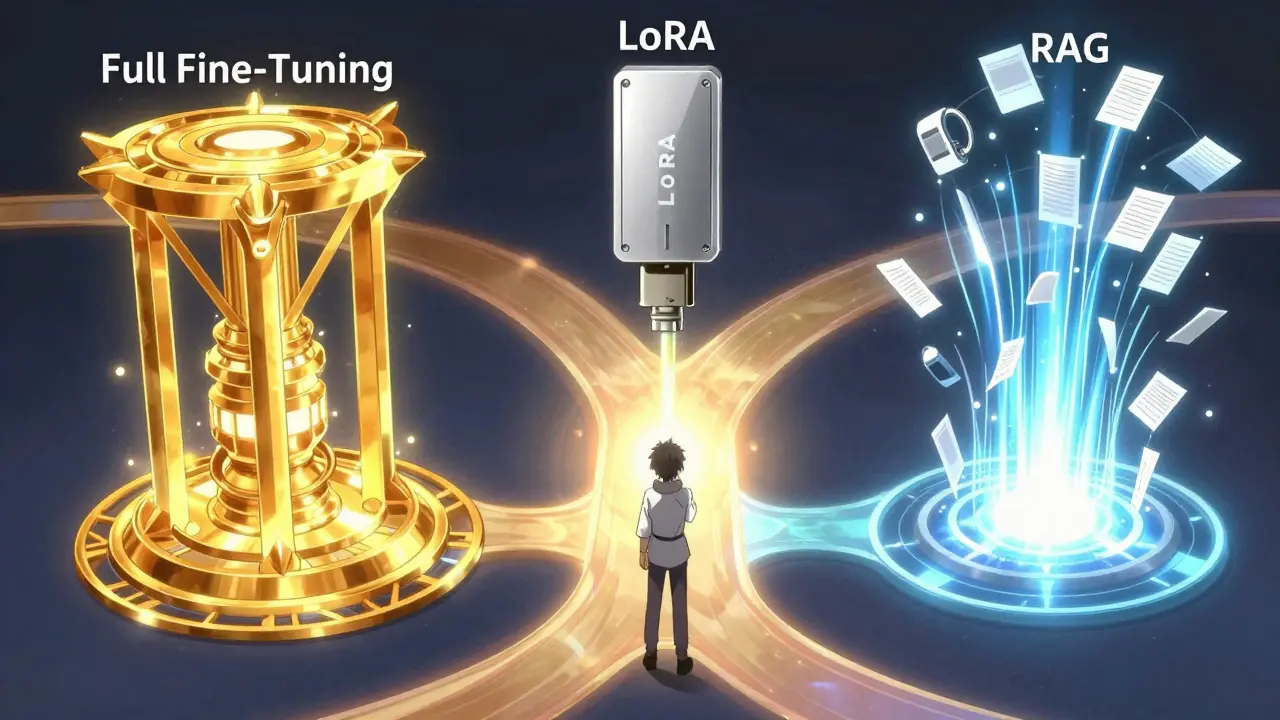

Vous avez un modèle d'intelligence artificielle puissant sur les mains, mais il répond comme un généraliste. Vous voulez qu'il agisse comme un expert juridique, un développeur Python ou un support client empathique pour votre marque. Le problème ? Entraîner un modèle de zéro coûte une fortune en énergie et en temps. Heureusement, vous n'êtes pas obligé de tout recommencer. Il existe trois chemins principaux pour adapter ces modèles géants à vos besoins spécifiques sans exploser votre budget.

Ces méthodes sont le fine-tuning (ajustement fin), l'utilisation d'adapters (comme LoRA) et la conception avancée de prompts. Chacune a ses forces, ses coûts cachés et son moment idéal d'utilisation. Comprendre ces différences est la clé pour passer d'un outil générique à un actif stratégique pour votre entreprise.

Le Fine-Tuning Complet : La Force Brute

Le fine-tuning complet consiste à prendre un modèle pré-entraîné existant et à ajuster tous ses paramètres internes en utilisant vos propres données. Imaginez que vous embauchiez un professeur brillant et que vous lui fassiez relire toute la documentation technique de votre entreprise pendant six mois pour qu'il devienne l'expert absolu de votre produit.

Le fine-tuning complet est une méthode qui met à jour tous les poids du modèle neuronal avec des données spécifiques au domaine cible.Cette approche offre la plus grande flexibilité. Le modèle intègre profondément la structure logique et le vocabulaire de votre secteur. Cependant, le coût est astronomique. Pour un modèle de taille moyenne, cela nécessite des cartes graphiques (GPU) haut de gamme avec beaucoup de mémoire vidéo (VRAM). Vous devez stocker non seulement le modèle original, mais aussi les gradients et les états d'optimisation pendant l'apprentissage.

De plus, le fine-tuning complet comporte un risque technique majeur appelé "oubli catastrophique". En forçant le modèle à apprendre de nouvelles informations, vous risquez de faire disparaître sa connaissance générale du monde. Votre assistant juridique pourrait soudainement oublier comment calculer un pourcentage simple parce qu'il s'est trop concentré sur la jurisprudence.

Les Adapters et PEFT : L'Efficacité Intelligente

Pour contourner les limites du fine-tuning complet, la communauté technique a développé les méthodes d'ajustement efficace des paramètres (PEFT). Au lieu de toucher à tout le modèle, on gèle les poids originaux et on ajoute de petites couches supplémentaires, appelées adapters, qui font tout le travail d'apprentissage.

La méthode la plus populaire ici est LoRA (Low-Rank Adaptation). L'idée derrière LoRA est mathématiquement élégante : quand un modèle apprend une nouvelle tâche, les changements nécessaires dans ses milliards de paramètres ne se produisent pas partout au hasard, mais suivent quelques directions principales. LoRA identifie ces directions et n'entraîne que les petits modules nécessaires pour les capturer.

| Critère | Fine-Tuning Complet | Adapters (LoRA) | Prompts Avancés / RAG |

|---|---|---|---|

| Coût Calcul | Très Élevé | Faible à Modéré | Négligeable |

| Besoins Mémoire GPU | Énorme (plusieurs To) | Réduit (quelques Go) | Standard |

| Qualité Spécialisation | Maximale | Haute (proche du complet) | Moyenne à Haute |

| Gestion Oubli Catastrophique | Risqué | Sécurisé (modèle gelé) | Aucun risque |

| Déploiement | Lourd (nouveau modèle) | Léger (fichier adapter séparé) | Instantané |

Une variante encore plus performante est QLoRA. Elle combine la logique de LoRA avec la quantification. La quantification réduit la précision numérique des données (par exemple, passer de 32 bits à 4 bits), ce qui permet de faire tourner des modèles gigantesques sur une seule carte graphique grand public. C'est aujourd'hui la norme pour les startups et les chercheurs qui veulent expérimenter sans cluster de serveurs.

L'avantage opérationnel des adapters est énorme. Vous pouvez garder un seul modèle de base et charger différents fichiers LoRA selon le contexte. Un matin, vous chargez l'adapter "Support Client", l'après-midi celui "Analyse Financière", sans jamais modifier le cœur du système.

Les Prompts et le Contexte : La Solution Zéro Code

Tout le monde commence par les prompts. Mais il y a une différence entre taper "Résume ce texte" et utiliser des techniques de prompt engineering avancées ou de RAG (Génération Augmentée par Récupération).

Si votre besoin principal est d'accéder à des informations factuelles mises à jour (comme les derniers prix de vos produits ou les contrats signés hier), le fine-tuning n'est souvent pas la meilleure solution. Les modèles de langage ont une date de coupure ; ils ne savent pas ce qui s'est passé après leur entraînement initial. De plus, les faits peuvent être erronés si le modèle les a mal mémorisés.

Ici, le RAG brille. Au lieu d'essayer de faire apprendre des faits au modèle, vous lui fournissez ces faits en temps réel via son contexte (le prompt). Vous interrogez votre base de données, récupérez les documents pertinents, et les injectez dans la question posée à l'IA. Le modèle agit alors comme un moteur de raisonnement sur des données fraîches.

Les techniques de Prompt Tuning vont plus loin. Elles ajoutent des vecteurs virtuels au début de l'entrée du modèle. Contrairement aux mots lisibles par un humain, ce sont des nombres flottants optimisés pour orienter le modèle vers un style ou une tâche spécifique. C'est moins lourd que LoRA, mais souvent moins précis pour des tâches complexes nécessitant une compréhension structurelle profonde.

Comment Choisir la Bonne Stratégie ?

Ne choisissez pas votre méthode au hasard. Posez-vous cette question : quelle est la nature de la spécialisation requise ?

- Priorité à la voix et au format : Si vous voulez que l'IA réponde toujours avec un ton professionnel spécifique, génère du code dans une architecture stricte ou suive un format JSON exact, utilisez le fine-tuning paramétrique (LoRA/QLoRA). Le modèle doit intégrer ces règles dans son "instinct".

- Priorité aux faits dynamiques : Si vous avez besoin de réponses basées sur votre base de connaissances interne qui change chaque semaine, oubliez le fine-tuning lourd. Optez pour le RAG. C'est plus propre, plus vérifiable et évite les hallucinations liées à des données obsolètes.

- Priorité à la rapidité d'expérimentation : Commencez par des prompts complexes (Few-Shot Prompting). Si cela suffit, parfait. Sinon, passez à un petit adapter LoRA pour figer ce comportement.

En pratique, la plupart des systèmes robustes combinent ces approches. On utilise un modèle de base affiné par LoRA pour garantir le style et la sécurité, et on lui superpose une couche RAG pour fournir les données contextuelles précises au moment de la génération.

Alignement et Préférences Humaines

Une fois que vous avez adapté le modèle techniquement, reste la question du comportement. Est-ce que les réponses sont utiles ? Sont-elles sûres ? C'est là qu'interviennent les techniques d'alignement comme le RLHF (Apprentissage par Renforcement avec Feedback Humain) ou le DPO (Optimisation Directe des Préférences).

Ces méthodes ne consistent pas à apprendre des faits, mais à préférer une réponse A plutôt qu'une réponse B. Lors de la phase de fine-tuning, vous pouvez inclure des paires de réponses (une bonne, une mauvaise) pour guider le modèle vers le style souhaité. Le DPO est particulièrement intéressant car il simplifie le processus complexe du RLHF, le rendant plus stable et moins gourmand en ressources pour les équipes qui ne disposent pas d'infrastructures massives.

Il est crucial de noter que même avec LoRA, vous devez valider manuellement les sorties. L'automatisation totale n'existe pas encore sans supervision humaine, surtout pour les applications critiques en santé, finance ou droit.

Quel est le meilleur compromis entre LoRA et le Fine-Tuning complet ?

Pour 95% des cas d'usage actuels, LoRA (ou QLoRA) est supérieur. Il offre des performances quasi identiques au fine-tuning complet pour un coût computationnel divisé par dix ou cent. Le fine-tuning complet ne justifie son existence que si vous devez modifier radicalement l'architecture de compréhension du langage ou fusionner plusieurs compétences contradictoires au sein du même modèle de manière irréversible.

Puis-je utiliser LoRA sur mon ordinateur personnel ?

Oui, grâce à QLoRA. Avec une carte graphique moderne possédant au moins 16 Go de VRAM (comme certaines RTX 3080 ou 4080), vous pouvez entraîner des adapters sur des modèles de taille moyenne (7 à 13 milliards de paramètres). Cela prendra plus de temps que sur un serveur cloud, mais c'est techniquement réalisable et très économique.

Combien de données ai-je besoin pour faire du fine-tuning ?

La qualité prime sur la quantité. Pour adapter le style ou le format (via LoRA), quelques centaines d'exemples bien rédigés suffisent souvent. Pour enseigner de nouvelles connaissances factuelles, il faut davantage de données, mais attention : si les données sont bruitées ou contradictoires, vous dégraderrez le modèle. Visez 1 000 à 5 000 exemples propres pour commencer.

Quelle est la différence entre Prompt Tuning et Adapter Tuning ?

Le Prompt Tuning modifie uniquement l'entrée du modèle (des vectores invisibles ajoutés au texte), tandis que l'Adapter Tuning (comme LoRA) insère de petites couches neuronales apprenantes directement à l'intérieur de l'architecture du modèle. L'Adapter Tuning est généralement plus performant pour les tâches complexes car il influence le traitement interne des données, pas juste la perception initiale.

Est-ce que le RAG remplace complètement le besoin de fine-tuning ?

Non. Le RAG résout le problème des connaissances factuelles et de la mise à jour des données. Le fine-tuning (notamment via LoRA) résout le problème du style, du format de sortie, de la sécurité et de la logique de raisonnement spécialisée. Les deux sont complémentaires : le RAG donne les faits, le fine-tuning donne la forme et la discipline à la réponse.