Imaginez un modèle d’IA générative qui peut analyser vos données médicales, vos transactions bancaires ou vos messages privés - sans jamais les voir. Pas de déchiffrement. Pas de stockage en clair. Pas de point d’entrée pour un pirate. C’est ce que permet le chiffrement homomorphe, une avancée cryptographique qui transforme la façon dont l’IA traite les données sensibles. Et ce n’est pas de la science-fiction : en mars 2025, des laboratoires aux États-Unis et en Europe ont démontré que cette technologie fonctionne en pratique, même sur des appareils à ressources limitées.

Comment l’IA peut-elle travailler sur des données cryptées ?

Traditionnellement, quand un modèle d’IA comme GPT ou une intelligence artificielle médicale analyse des données, ces données doivent être déchiffrées avant traitement. C’est comme envoyer un dossier médical scellé à un médecin - mais vous devez d’abord l’ouvrir, le lire, puis le refermer. Pendant ce temps, le fichier est exposé. À qui ? Au serveur cloud. À l’administrateur système. À un hacker qui pénètre le réseau. Le chiffrement homomorphe, lui, élimine cette faille. Il permet d’effectuer des calculs - addition, multiplication, même des opérations complexes de réseaux de neurones - directement sur les données chiffrées. Le résultat est aussi chiffré. Seul le propriétaire de la clé secrète peut le déchiffrer et lire la réponse.

Cela signifie qu’un hôpital peut envoyer des données de patients cryptées à un centre de recherche distant, qui y applique un modèle d’IA pour prédire les risques de complications chirurgicales - sans jamais connaître le nom du patient, son historique médical ou même la nature de la maladie étudiée. Le modèle apprend, prédit, et renvoie un résultat chiffré. Rien n’est exposé. Rien n’est volable.

Le chiffrement homomorphe complet (FHE) et le schéma CKKS

Pas tous les chiffrements homomorphes sont égaux. Le chiffrement homomorphe partiel permet seulement des additions ou des multiplications. Le chiffrement homomorphe complet (FHE), lui, permet n’importe quelle opération. Et c’est celui qui intéresse l’IA générative. En 2024, des chercheurs du Pacific Northwest National Laboratory (PNNL) ont montré que le schéma CKKS - conçu pour traiter des nombres à virgule flottante - peut fonctionner efficacement sur des appareils IoT, des caméras intelligentes ou des capteurs médicaux. Ces appareils n’ont ni puissance ni mémoire pour déchiffrer des données massives. Mais ils peuvent les traiter chiffrées.

Avant, les calculs sur données chiffrées prenaient des heures, voire des jours. Aujourd’hui, avec CKKS, certains modèles d’IA exécutent des inférences en moins de 10 secondes sur des systèmes embarqués. Ce n’est pas encore aussi rapide qu’un serveur classique, mais c’est suffisant pour des applications critiques : diagnostic médical à distance, détection de fraude en temps réel, analyse de données financières sans quitter les serveurs bancaires.

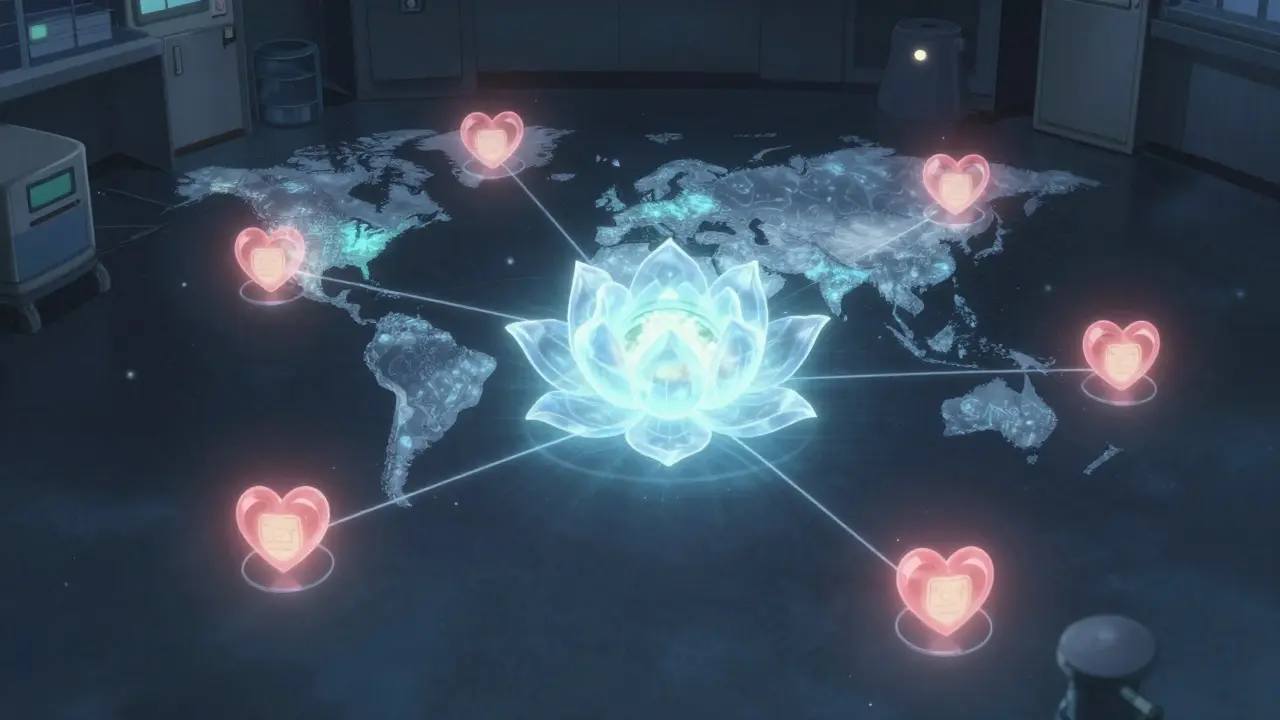

Le mariage avec l’apprentissage fédéré

L’apprentissage fédéré permet à plusieurs organisations - disons, cinq hôpitaux - d’entraîner un modèle d’IA ensemble, sans partager leurs données. Chaque hôpital entraîne une version locale du modèle, puis envoie seulement les mises à jour (des poids mathématiques) à un serveur central. Le serveur agrège ces mises à jour pour créer un modèle global. C’est déjà une excellente solution pour la vie privée… mais pas parfaite.

En 2023, des chercheurs ont prouvé qu’on pouvait reconstruire des parties des données d’origine à partir des mises à jour. Un patient atteint de cancer pourrait être identifié, même si son nom n’apparaissait pas. Le chiffrement homomorphe résout ce problème. Au lieu d’envoyer les mises à jour en clair, les hôpitaux les envoient chiffrées. Le serveur central agrège les données chiffrées. Il ne voit rien. Il ne peut rien déduire. Et le modèle global est renvoyé aussi chiffré. Chaque hôpital le déchiffre localement. Résultat : un modèle plus précis, sans aucune donnée exposée.

IBM a déjà intégré cette combinaison dans son framework d’apprentissage fédéré. Des banques en France et en Allemagne l’utilisent pour détecter les fraudes transfrontalières. Des cliniques aux États-Unis et au Japon partagent des données sur les effets secondaires des traitements contre le cancer - sans violer la loi HIPAA ou le RGPD.

Protection des modèles et conformité réglementaire

Le chiffrement homomorphe ne protège pas seulement les données. Il protège aussi les modèles eux-mêmes. Imaginez une entreprise qui a développé un algorithme unique pour prédire les tendances du marché. Elle veut le vendre à des clients, mais ne veut pas qu’ils le copient. Avec le chiffrement homomorphe, elle peut exécuter le modèle sur des données clients - sans jamais le déployer en clair. Le client obtient une prédiction, mais ne voit jamais l’algorithme. C’est comme louer un coffre-fort qui calcule pour vous, sans vous donner la clé du coffre.

Cela répond à une exigence croissante du RGPD : la preuve mathématique de protection, pas seulement des clauses contractuelles. Le RGPD exige que les données soient protégées « par conception ». Le chiffrement homomorphe est la seule technologie qui offre cette garantie : même en cas de violation, les données restent illisibles. Paul Baka, directeur de SSLTrust, le confirme : « Ce n’est plus une question de confiance. C’est une question de mathématiques. »

Applications concrètes aujourd’hui

En 2025, cette technologie n’est pas encore dans tous les smartphones, mais elle est déjà en production dans des domaines critiques :

- Santé : Des centres de recherche aux États-Unis utilisent des modèles d’IA chiffrés pour prédire les risques de rechute après chirurgie, en combinant des données de 17 hôpitaux sans jamais les fusionner.

- Finance : Une banque suisse et une entreprise allemande de fintech collaborent pour détecter les fraudes internationales. Les transactions restent sur les serveurs locaux. Seules les analyses chiffrées sont partagées.

- Assurance : Des compagnies d’assurance en Europe utilisent des modèles d’IA pour évaluer les risques de santé des clients, sans accéder à leurs dossiers médicaux. Le modèle apprend des tendances globales, pas des cas individuels.

- Chaînes d’approvisionnement : Des fabricants de pièces automobiles évaluent les risques de pénurie en analysant les données chiffrées de leurs fournisseurs, sans révéler leurs propres stocks ou prévisions.

Robert Coombs, fondateur de Baton Health, le dit clairement : « Avant, on partageait des données avec des risques. Maintenant, on partage des résultats. Et c’est une révolution. »

Limites et défis à venir

Mais cette technologie n’est pas parfaite. Elle reste lente comparée aux méthodes classiques. Elle exige des ressources de calcul importantes. Elle est complexe à intégrer dans des systèmes existants. Et il n’y a pas encore de standards universels pour son déploiement.

Le principal frein ? La performance. Un modèle d’IA qui prend 5 secondes en clair peut prendre 45 secondes en chiffrement homomorphe. Pour certains usages - comme une réponse en temps réel à une requête vocale - ce délai est inacceptable. Mais pour des analyses quotidiennes, des rapports hebdomadaires ou des modèles de diagnostic, 45 secondes, c’est acceptable.

Les chercheurs travaillent sur des accélérateurs matériels dédiés. Des puces spécialisées, conçues pour exécuter des opérations chiffrées en parallèle, sont en phase de test. En 2026, on devrait voir les premiers serveurs IA avec chiffrement homomorphe intégré en usine.

Le futur : blockchain, IA et confidentialité absolue

Les architectes de systèmes commencent à imaginer des modèles encore plus avancés. Et si les mises à jour de modèles d’IA étaient enregistrées sur une blockchain, chiffrées, et vérifiées par des contrats intelligents ? Une clinique envoie une mise à jour cryptée. Un contrat intelligent vérifie qu’elle est valide. Le modèle global est mis à jour. Rien n’est stocké en clair. Rien n’est accessible. Rien n’est modifiable sans autorisation.

Ce n’est pas un rêve. Des prototypes existent déjà. Des plateformes de recherche médicale décentralisées utilisent cette combinaison. Elles permettent à n’importe quel hôpital du monde de contribuer à l’IA médicale, sans jamais céder son contrôle sur les données. C’est la promesse d’une IA véritablement démocratisée - et protégée.

La vraie révolution n’est pas dans la puissance de l’IA. C’est dans sa capacité à respecter la vie privée sans sacrifier la performance. Le chiffrement homomorphe et les enclaves sécurisées ne sont pas des options. Ce sont les fondations du futur de l’IA responsable. Et ce futur est déjà en train de s’écrire - chiffré, silencieux, et inviolable.

Qu’est-ce que le chiffrement homomorphe ?

Le chiffrement homomorphe est une technique cryptographique qui permet d’effectuer des calculs sur des données chiffrées sans jamais les déchiffrer. Le résultat du calcul reste chiffré, et seul le propriétaire de la clé secrète peut le déchiffrer pour obtenir la réponse. Cela permet d’utiliser des modèles d’IA sur des données sensibles - comme des dossiers médicaux ou des transactions financières - sans exposer ces données aux serveurs ou aux opérateurs.

Le chiffrement homomorphe est-il plus sûr que l’apprentissage fédéré ?

L’apprentissage fédéré protège les données brutes, mais les mises à jour de modèle peuvent encore révéler des informations sensibles. Le chiffrement homomorphe protège à la fois les données et les mises à jour. Ensemble, ils forment une solution plus robuste : l’apprentissage fédéré évite le transfert des données, le chiffrement homomorphe évite la fuite d’informations à partir des mises à jour. L’un n’exclut pas l’autre - ils se complètent.

Pourquoi le schéma CKKS est-il important pour l’IA générative ?

Le schéma CKKS est conçu pour traiter des nombres à virgule flottante, ce qui est essentiel pour les réseaux de neurones. Les modèles d’IA utilisent des poids décimaux, pas des entiers. Les anciens schémas de chiffrement homomorphe ne pouvaient pas le faire efficacement. CKKS change la donne : il permet des calculs précis sur données chiffrées, ce qui rend l’IA générative opérationnelle dans des environnements protégés.

Le chiffrement homomorphe est-il conforme au RGPD ?

Oui, et c’est l’un de ses atouts majeurs. Le RGPD exige des garanties de protection par conception. Le chiffrement homomorphe offre une preuve mathématique que les données restent confidentielles même pendant le traitement. Contrairement à d’autres méthodes basées sur des accords contractuels, il n’y a pas de « trou » de sécurité. Cela le rend idéal pour les secteurs réglementés comme la santé ou la finance.

Quand cette technologie sera-t-elle disponible pour les entreprises ?

Déjà. En 2025, des grandes entreprises - notamment dans la santé, la finance et l’assurance - l’utilisent en production. Mais elle reste complexe et coûteuse à intégrer. Pour les PME, les outils simplifiés devraient arriver d’ici 2027. Les premiers fournisseurs de cloud proposent déjà des services d’IA chiffrée comme option premium. Ce n’est plus une question de « si », mais de « quand ».