Imaginez que vous demandiez à un expert de répondre à une question extrêmement simple, comme « Quelle est la couleur du ciel ? ». L'expert n'a pas besoin de réfléchir pendant dix minutes ou de consulter tous ses livres de référence pour répondre ; il vous donne la réponse instantanément. Les Large Language Models (LLM) ne fonctionnent pas naturellement comme ça. Habituellement, même pour le mot le plus simple, le modèle fait transiter l'information à travers toutes ses couches de calcul, ce qui gaspille un temps et une énergie folles. C'est là qu'interviennent le Layer Dropping et l'Early Exit : des techniques qui permettent à l'IA de s'arrêter de réfléchir dès qu'elle est sûre de sa réponse.

L'idée derrière la sortie anticipée : Pourquoi tout calculer ?

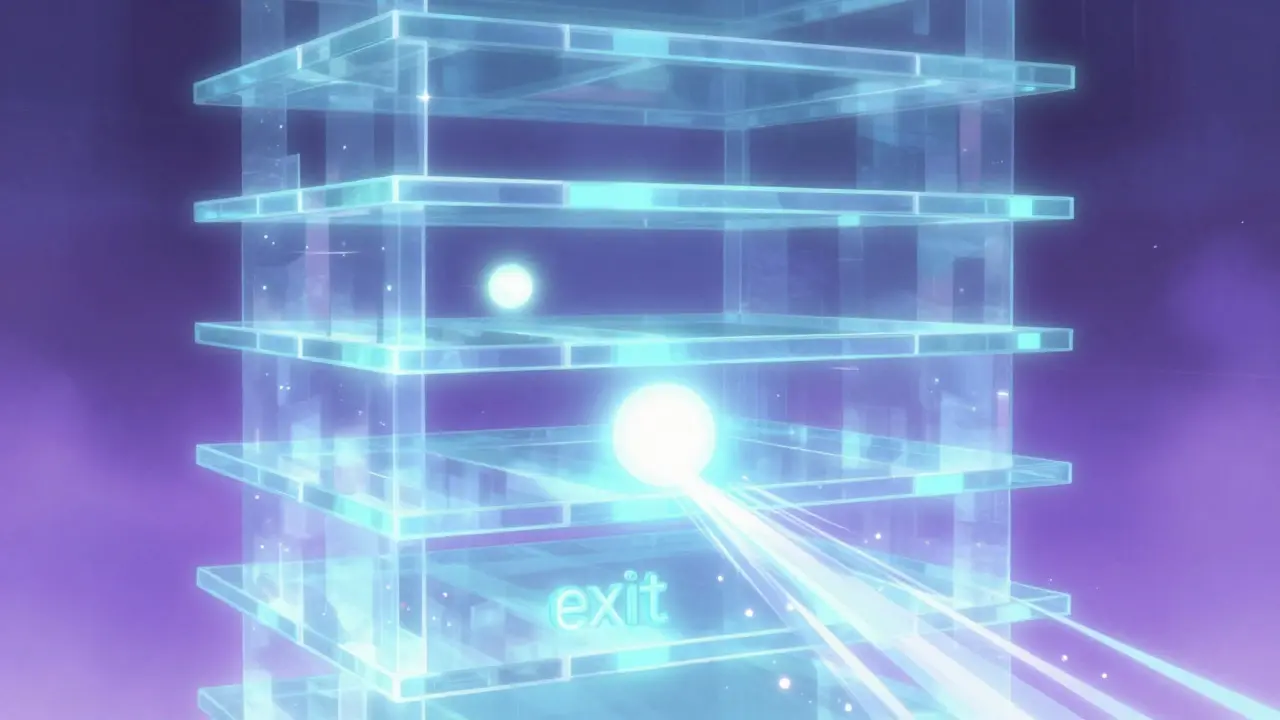

Dans un Transformer est l'architecture neuronale à la base des LLM, composée d'une pile de couches identiques qui traitent les données , chaque couche affine la compréhension du texte. Mais pour beaucoup de jetons (tokens), la réponse est déjà évidente après seulement quelques couches. L'Early Exit (ou sortie anticipée) consiste à ajouter des « portes de sortie » intermédiaires. Si le modèle atteint un certain seuil de confiance, il sort du pipeline et livre le résultat sans passer par les couches restantes.

Concrètement, cela réduit drastiquement la latence d'inférence. On ne parle pas d'un gain marginal, mais d'accélérations allant de 1,5x à 3x. Bien sûr, il y a un arbitrage : plus on veut aller vite (seuil de confiance bas), plus on risque de perdre en précision. Mais pour 95 % de la précision originale, on peut souvent gagner un temps considérable.

Les stratégies concrètes : LayerSkip, EE-LLM et SLED

Plusieurs approches se distinguent aujourd'hui pour mettre cela en œuvre, chacune avec sa propre philosophie technique.

Le framework LayerSkip est une méthode développée par Meta AI combinant le dropout de couches lors de l'entraînement et le décodage auto-spéculatif . Au lieu de simplement couper le calcul, LayerSkip entraîne le modèle à être robuste même quand certaines couches manquent. Lors de l'inférence, sur un modèle Llama-7B, on voit souvent des sorties anticipées vers les couches 6 ou 12 avec un seuil de confiance de 0,95. L'avantage majeur ici est la réduction de l'empreinte mémoire (15 à 25 % de moins que le décodage spéculatif classique) car le modèle partage ses activations entre l'étape de brouillon et de vérification.

De son côté, EE-LLM est un système optimisé pour le parallélisme 3D (données, tenseur, pipeline) permettant de déployer l'early exit à très grande échelle . Contrairement à d'autres, EE-LLM gère mieux les gros volumes de données (batch sizes supérieurs à 32) en utilisant des ressources inactives dans le planning du pipeline. On peut configurer des modules de sortie soit avant, soit après la couche transformer principale, ce qui offre une flexibilité précieuse pour les ingénieurs.

Enfin, Google a proposé SLED (Selective Layer Extraction for Decoding). Là où les autres cherchent à s'arrêter tôt, SLED utilise les prédictions de toutes les couches et les combine intelligemment. Étonnamment, cela peut même augmenter la précision. Par exemple, sur des tâches de raisonnement mathématique (GSM8K), SLED a mieux réussi à prédire des symboles comme « x » au lieu de « = » dans des séquences de multiplication, prouvant que les couches intermédiaires possèdent parfois des informations que la couche finale a fini par oublier.

| Technique | Objectif Principal | Gain de Vitesse | Impact Précision | Point Fort |

|---|---|---|---|---|

| LayerSkip | Efficacité mémoire | 1.5x - 2x | Très faible perte | Décodage auto-spéculatif |

| EE-LLM | Déploiement massif | Jusqu'à 3x | Variable (selon seuil) | Parallélisme 3D |

| SLED | Précision + Vitesse | ~2x | Amélioration possible | Extraction multi-couches |

Le défi technique : Le problème de l'uniformité des batchs

Si tout semble parfait, pourquoi n'utilise-t-on pas cela partout ? Il existe un obstacle majeur : la synchronisation des batchs. Dans un déploiement réel, on traite souvent des groupes de requêtes (batchs) simultanément pour optimiser le GPU. Le problème est que tous les jetons d'un batch doivent généralement sortir à la même couche.

Si un jeton dans votre batch est très simple et veut sortir à la couche 6, mais qu'un autre est complexe et nécessite la couche 32, le premier doit attendre que le second ait fini. C'est ce qu'on appelle le « batch uniformity problem ». Cela limite les gains théoriques de 3x à environ 1,8x en conditions réelles de charge hétérogène. C'est le grand chantier actuel des chercheurs, notamment chez NVIDIA et Meta, qui tentent de créer des serveurs d'inférence capables de gérer des sorties asynchrones.

Mise en œuvre pratique et configuration

Pour ceux qui souhaitent tester ces approches, notamment via des outils comme Megatron-LM, la mise en place demande quelques ajustements précis. L'ajout de mécanismes de sortie demande généralement 10 à 15 % de paramètres supplémentaires. Voici les étapes clés pour un déploiement réussi :

- Définition des couches de sortie : Pour un modèle Llama-7B, on configure souvent les sorties aux couches 6 et 12.

- Phase de Warm-up : Il est crucial d'utiliser un échauffement des poids des couches de sortie (environ 1 000 itérations) pour éviter que le modèle ne diverge durant l'entraînement.

- Réglage du seuil (Threshold) : C'est le curseur magique. Un seuil de 0,7-0,8 booste la vitesse mais peut introduire des erreurs de raisonnement. Un seuil de 0,95+ garantit la qualité mais réduit le gain de performance.

- Normalisation : L'utilisation de

--use-exit-normet de MLP (Multi-Layer Perceptrons) aux sorties aide à stabiliser les prédictions.

L'avenir : Vers une IA qui adapte son effort

L'industrie se dirige vers ce que Gartner appelle le « calcul dynamique ». D'ici 2026, on estime que 70 % des déploiements d'entreprises utiliseront des techniques de ce type. L'idée est simple : ne plus traiter chaque mot avec la même intensité. Un « Bonjour » ne doit pas coûter la même énergie qu'une démonstration mathématique complexe.

On voit apparaître des versions de SLED de deuxième génération qui ajustent le poids des couches en temps réel selon la complexité de l'entrée. On pourrait ainsi atteindre des accélérations de 3,5x tout en maintenant 98 % de précision. Le futur des LLM n'est pas seulement dans la taille du modèle, mais dans sa capacité à être « paresseux » intelligemment.

Quelle est la différence entre Layer Dropping et Early Exit ?

Le Layer Dropping consiste à supprimer aléatoirement des couches pendant l'entraînement pour rendre le modèle robuste à l'absence de certaines étapes. L'Early Exit est une stratégie d'inférence où le modèle s'arrête dès qu'il a assez de confiance dans sa réponse, sautant ainsi les couches restantes.

Est-ce que l'Early Exit réduit la précision du modèle ?

Oui, généralement. Il y a un compromis entre vitesse et précision. Cependant, avec un seuil de confiance élevé (ex: 0,95), la perte est quasi imperceptible. Dans certains cas comme avec SLED, l'utilisation d'informations multi-couches peut même améliorer la précision sur des tâches spécifiques.

Pourquoi le « batch uniformity problem » est-il gênant ?

Parce que les GPUs traitent les données en blocs. Si un seul élément du bloc nécessite toutes les couches, tout le bloc doit attendre, annulant le gain de vitesse obtenu pour les éléments plus simples qui auraient pu sortir plus tôt.

Combien de ressources supplémentaires faut-il pour implémenter l'EE-LLM ?

L'ajout des modules de sortie augmente le nombre de paramètres d'environ 10 à 15 %. Côté développement, cela peut ajouter 2 à 3 semaines de travail pour une équipe maîtrisant déjà Megatron-LM en raison de la complexité du parallélisme de pipeline.

Quelles sont les applications les plus adaptées à ces techniques ?

Les chatbots conversationnels et les assistants IA où la latence (le temps de réponse) est critique pour l'expérience utilisateur. C'est moins recommandé pour des tâches de raisonnement ultra-complexes si les seuils de confiance sont réglés trop bas.