Lorsque vous utilisez un modèle comme GPT-4, DALL-E 3 ou Stable Diffusion 3, vous ne voyez que le résultat final : un texte fluide, une image réaliste, une réponse précise. Mais derrière cette apparence simple se cache une révolution silencieuse : l'apprentissage auto-supervisé. Ce n’est pas une technique marginale. C’est le moteur invisible qui alimente presque toute l’IA générative moderne. Et il fonctionne sans données étiquetées.

Comment l’apprentissage auto-supervisé crée du sens sans étiquettes

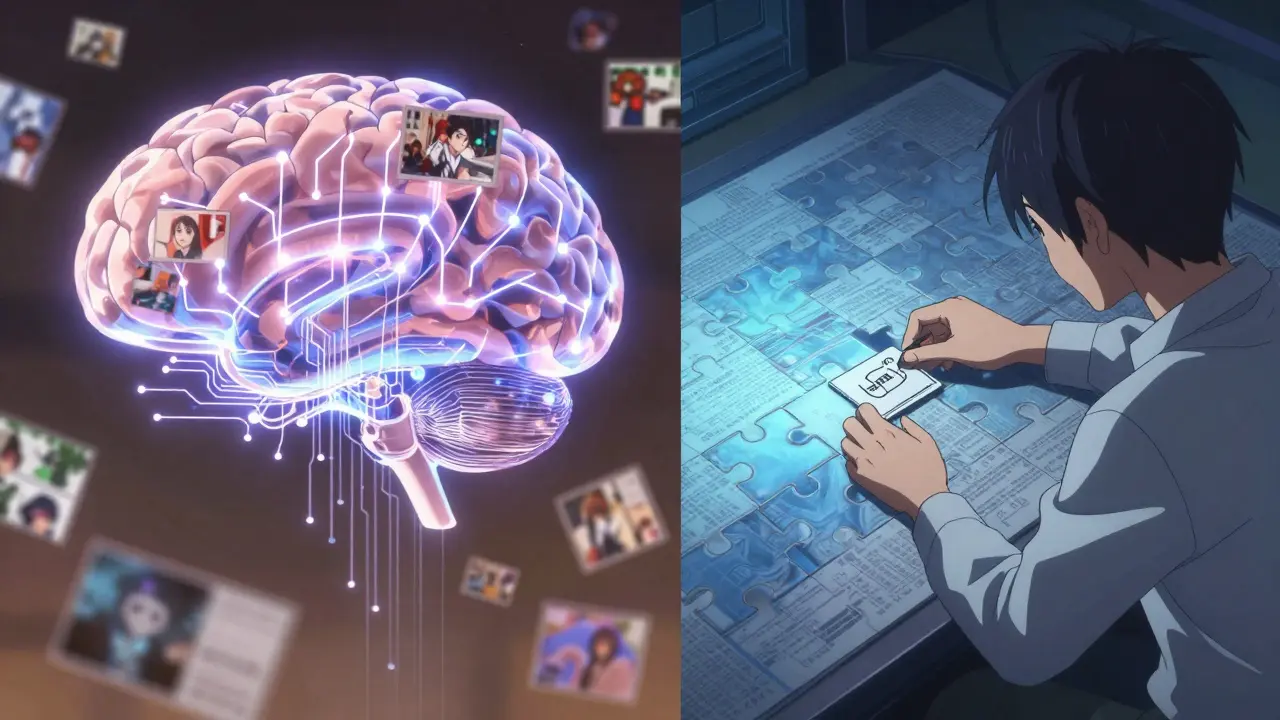

Imaginons que vous appreniez à lire en ne regardant que des livres, sans jamais avoir de correction externe. Vous ne connaissez pas les mots, mais vous voyez des motifs : certains mots apparaissent souvent après d’autres. « Le chat » est suivi de « dort » ou de « miaule ». Avec le temps, vous devinez les règles. C’est exactement ce que fait l’apprentissage auto-supervisé.

Plutôt que de demander à un humain d’étiqueter des milliards d’images ou de textes, le modèle se crée ses propres exercices. Pour le texte, il cache 15 % des mots et apprend à les prédire - c’est le masked language modeling. Pour les images, il coupe une partie du cadre et demande au modèle de la recréer - comme un puzzle. Il n’y a pas de réponse correcte fournie par un humain. Le modèle apprend à reconstruire le monde à partir de ses propres indices.

Cette méthode a explosé entre 2018 et 2020, avec l’arrivée des architectures Transformer. Avant cela, les modèles d’IA avaient besoin de millions d’images étiquetées - une tâche coûteuse, lente, et limitée. Aujourd’hui, 98 % des données disponibles sont non étiquetées : vidéos YouTube, articles en ligne, photos de caméras de sécurité, capteurs industriels. L’apprentissage auto-supervisé permet d’utiliser cette masse de données. C’est pourquoi les géants comme Meta, Google et OpenAI ont abandonné les approches supervisées pour la préformation. Ils ne veulent plus être limités par la rareté des données étiquetées. Ils veulent apprendre du monde réel, tel qu’il est.

De la préformation à l’ajustement fin : deux étapes, un seul objectif

L’apprentissage auto-supervisé ne se fait pas en une seule étape. Il y a deux phases clés : la préformation et l’ajustement fin.

La préformation est le travail de fond. Le modèle est entraîné sur des milliards d’exemples non étiquetés. Pour GPT-4, cela signifie lire des pages entières de Wikipedia, des forums, des livres numérisés - sans jamais savoir ce qu’il doit apprendre au final. Il apprend simplement à prédire ce qui vient après, à remplir les trous, à reconnaître les structures. Cette phase consomme des ressources colossales : le préentraînement de GPT-3 a utilisé 3 640 petaflop/s-jours, l’équivalent de plusieurs milliers de GPU fonctionnant pendant des mois. C’est ici que les coûts sont les plus élevés - jusqu’à 45 000 $ pour un modèle de taille moyenne sur AWS.

Ensuite vient l’ajustement fin. À ce stade, le modèle a déjà une compréhension profonde du langage ou des images. On lui donne seulement quelques milliers d’exemples étiquetés - par exemple, des textes classés comme « positifs » ou « négatifs » pour un système de sentiment. Avec 10 à 20 % de données étiquetées, il atteint des performances proches de celles d’un modèle entraîné sur 100 % de données étiquetées. C’est là que réside le vrai pouvoir : une efficacité étonnante. Dans la médecine, des chercheurs ont utilisé l’apprentissage auto-supervisé sur un million de radiographies non étiquetées. Ensuite, ils ont ajusté finement le modèle sur seulement 5 000 images annotées. Le résultat ? Une détection de pneumonie plus précise de 18,7 % que les modèles supervisés classiques.

Les modèles qui ont changé la donne

Chaque grand modèle d’IA générative moderne repose sur cette approche.

- GPT-4 utilise un modèle auto-régressif : il lit un texte mot par mot et prédit le suivant. Sa fenêtre de contexte peut atteindre 32 768 tokens - plus qu’un roman court. Il a été préformé sur des milliards de pages web.

- DALL-E 3 combine la préformation sur des images avec des descriptions textuelles. Il apprend à associer des motifs visuels à des mots en masquant des parties d’images et en les reconstruisant à partir du texte.

- Stable Diffusion 3 utilise un processus de diffusion, mais la première étape est toujours un apprentissage auto-supervisé sur des millions d’images et légendes non étiquetées. C’est ce qui lui permet de générer des détails réalistes, même sur des sujets inédits.

- Llama 3 de Meta introduit un système d’« masquage adaptatif » : il ajuste automatiquement la proportion d’éléments masqués selon la complexité du contenu. Cela réduit le temps d’ajustement fin de 23 %.

Et ce n’est pas qu’une affaire de géants. Des modèles open source comme Mistral et Phi-3 utilisent aussi cette méthode. Ils sont plus petits, mais ils apprennent de la même manière. La technologie est devenue accessible.

Les avantages : moins de données étiquetées, plus de performances

Les bénéfices ne sont pas théoriques. Ils se mesurent en dollars, en heures, en résultats concrets.

Dans la finance, des banques ont utilisé l’apprentissage auto-supervisé pour analyser 10 millions de transactions non étiquetées. Elles ont appris à repérer les anomalies - des transactions inhabituelles, des schémas de fraude invisibles aux algorithmes traditionnels. Résultat : une réduction de 27 % des faux positifs et une augmentation de 33 % de la détection réelle de fraude.

Dans la fabrication, Siemens a entraîné un modèle sur les données de capteurs de machines. Sans aucune étiquette de défaillance, le modèle a appris ce qu’est un fonctionnement « normal ». Ensuite, avec seulement 5 % de données étiquetées (où les machines avaient réellement échoué), il a pu prédire les pannes avec 92 % de précision, jusqu’à 72 heures à l’avance. Cela a réduit les arrêts de production de 18 %.

En comparaison, un modèle entièrement supervisé aurait nécessité des milliers d’heures de travail humain pour étiqueter chaque défaillance. Avec l’apprentissage auto-supervisé, ce travail est réduit à une fraction. Et les performances sont souvent supérieures.

Les limites : coûts, obscurité et biais

Malgré tout, ce n’est pas une solution magique.

Le premier obstacle est le coût computationnel. Préformer un modèle moderne demande des ressources qui dépassent le budget de la plupart des petites entreprises. Même si l’ajustement fin est peu coûteux, la préformation reste un luxe. Seuls les grands acteurs peuvent le financer - ce qui crée une concentration du pouvoir technologique.

Le deuxième problème est l’obscurité. Les représentations apprises par l’apprentissage auto-supervisé sont des milliards de poids numériques. Personne ne sait exactement ce qu’elles représentent. Un modèle peut détecter une maladie, mais il ne peut pas expliquer pourquoi. C’est une boîte noire. Pour certains ingénieurs, c’est une source de frustration : « On obtient de bons résultats, mais on ne sait pas comment ni pourquoi. »

Et puis il y a les bais. L’apprentissage auto-supervisé apprend à partir de données du monde réel - et le monde réel est biaisé. Si les textes utilisés pour préformer un modèle contiennent des stéréotypes de genre, de race ou de classe, le modèle les apprendra aussi. Selon l’AI Now Institute, les modèles basés sur SSL amplifient ces biais de 18 à 25 % par rapport aux modèles supervisés sur des jeux de données soigneusement curatés. Et il n’existe pas encore de méthode fiable pour les détecter et les corriger.

Le futur : plus rapide, plus efficace, plus universel

Les chercheurs travaillent déjà sur les prochaines étapes.

Google vient de lancer PaLM-E 2, capable de préformer simultanément sur du texte, des images et des données de capteurs - une approche multimodale. Stanford a démontré une méthode appelée « sparse SSL » qui réduit la puissance de calcul nécessaire de 65 %, tout en conservant 95 % des performances. Meta, avec Llama 3, montre que l’ajustement du masquage en temps réel peut améliorer l’efficacité.

Le but ultime ? Rendre l’apprentissage auto-supervisé accessible à tous. Des outils comme Hugging Face rendent les modèles pré-entraînés téléchargeables en quelques clics. Les frameworks comme PyTorch et TensorFlow intègrent désormais des bibliothèques dédiées à SSL. En 2025, 92 % des entreprises utilisent cette méthode dans leurs pipelines d’IA. IDC prédit qu’en 2027, 99 % des systèmes d’IA générative l’adopteront comme standard.

Yann LeCun, scientifique en chef de l’IA chez Meta, l’appelle « la matière noire de l’intelligence ». On ne la voit pas, mais elle maintient tout ensemble. Sans elle, l’IA générative n’existerait pas. Elle permet aux machines de comprendre le monde sans qu’on leur dise tout. Ce n’est pas de la magie. C’est de l’apprentissage - à grande échelle, silencieux, et profond.

Comment commencer ?

Si vous voulez expérimenter :

- Commencez avec un modèle pré-entraîné sur Hugging Face (comme BERT pour le texte ou CLIP pour les images).

- Utilisez des données non étiquetées de votre domaine - des emails, des rapports, des photos de produits.

- Essayez un simple masquage : cachez 15 % des mots ou 50 % de l’image, puis entraînez le modèle à les reconstruire.

- Ensuite, ajoutez 1 000 exemples étiquetés pour l’ajustement fin.

- Comparez les résultats avec un modèle entièrement supervisé.

Vous n’avez pas besoin de supercalculateurs. Un GPU cloud à 1 $/heure suffit pour des tests. L’important, c’est de comprendre que vous ne devez pas tout étiqueter. Apprenez d’abord. Ensuite, affinez.

Quelle est la différence entre apprentissage supervisé et auto-supervisé ?

L’apprentissage supervisé nécessite des données étiquetées par des humains - par exemple, des images de chats marquées comme « chat ». L’apprentissage auto-supervisé utilise des données non étiquetées et crée ses propres étiquettes : il cache un mot dans une phrase et demande au modèle de le deviner. Il n’y a pas de personne pour dire « c’est bon » ou « c’est mauvais ». Le modèle apprend seul.

Pourquoi l’apprentissage auto-supervisé est-il si populaire aujourd’hui ?

Parce qu’il utilise la masse de données non étiquetées disponibles - 98 % du total - alors que les données étiquetées sont rares, coûteuses et lentes à produire. Avec l’arrivée des Transformers, il est devenu possible d’apprendre des représentations très riches à partir de ces données, ce qui a révolutionné la qualité des modèles génératifs.

Est-ce que l’apprentissage auto-supervisé remplace complètement l’apprentissage supervisé ?

Non. Il le complète. La préformation auto-supervisée donne au modèle une compréhension générale. Mais pour des tâches précises - comme diagnostiquer un cancer ou classer un courriel comme spam - il faut encore un ajustement fin avec des données étiquetées. Les deux méthodes fonctionnent ensemble.

Quels sont les principaux défis techniques de l’apprentissage auto-supervisé ?

Les trois principaux défis sont : 1) le coût computationnel élevé de la préformation, 2) le choix du bon « prétexte » (le type de masquage ou de tâche de prédiction), et 3) le risque de « collapse » des représentations, où le modèle apprend une solution trop simple et perd en richesse. Des techniques comme le contraste, les encodeurs de momentum (MoCo) ou les pertes à température ajustée (SimCLR) aident à les résoudre.

Est-ce que l’apprentissage auto-supervisé est sécurisé et éthique ?

Pas automatiquement. Comme il apprend à partir de données du monde réel, il peut intégrer des biais, des stéréotypes ou des contenus nuisibles. Il n’y a pas de filtre naturel. Les entreprises doivent maintenant documenter les sources de données et tester les biais, surtout avec la régulation de l’UE sur l’IA. L’apprentissage auto-supervisé n’est pas en soi éthique - il faut le rendre éthique.

Prochaines étapes

Si vous êtes un développeur : essayez de préformer un modèle BERT sur vos propres documents. Utilisez Hugging Face et un jeu de données non étiqueté. Comparez les résultats avec un modèle non préformé.

Si vous êtes un décideur : demandez à votre équipe d’IA quel pourcentage de leur temps est consacré à l’étiquetage de données. Si c’est plus de 30 %, l’apprentissage auto-supervisé pourrait réduire ce coût de 80 %.

Si vous êtes curieux : regardez les résultats de DALL-E 3 ou de ChatGPT. Derrière chaque image, chaque réponse, il y a des milliards de mots masqués, des pixels cachés, des modèles qui ont appris à reconstruire le monde - sans qu’on leur dise quoi faire. C’est là que l’IA générative a vraiment commencé.