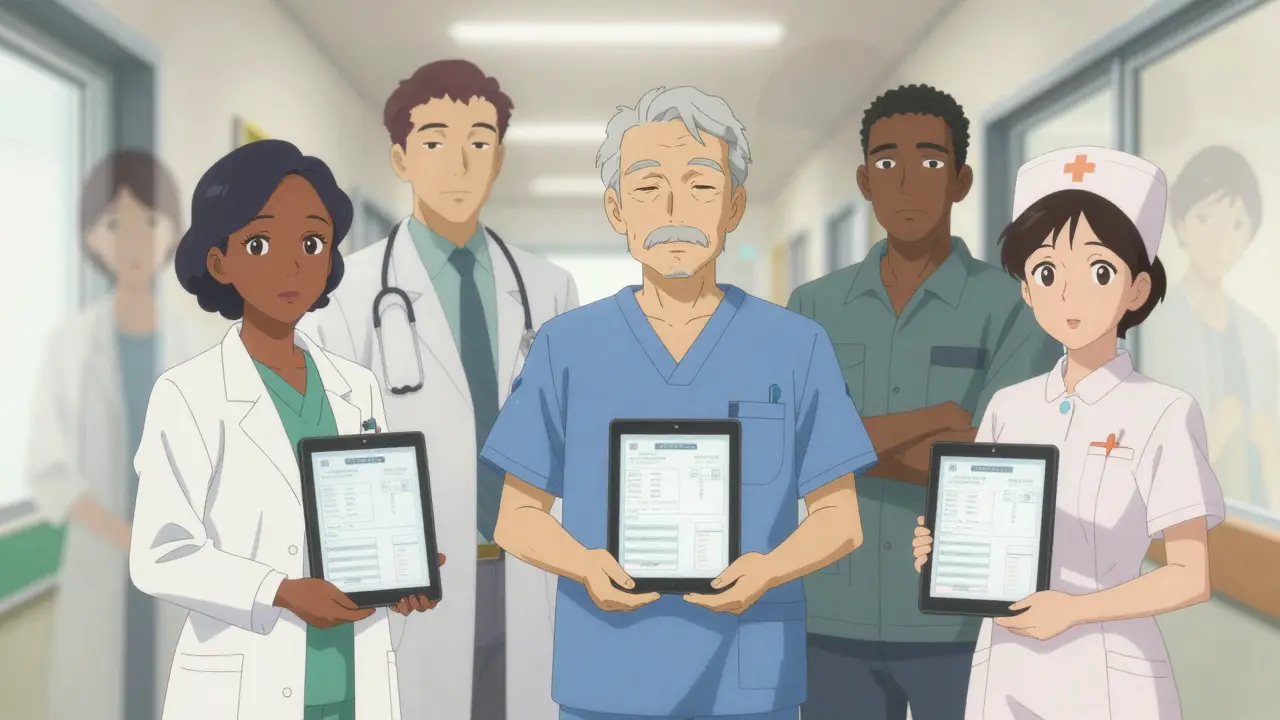

Quand vous demandez à une IA de générer une image d’un médecin, que voyez-vous ? Un homme en blouse blanche ? Une femme ? Une personne âgée ? Une personne noire ? Ce que vous voyez n’est pas un hasard. C’est le reflet d’un biais profondément ancré dans les données qui ont formé cette IA. Et ce problème n’est pas limité aux images. Il traverse aussi les textes, les sons, les vidéos - tout ce que les systèmes multimodaux traitent ensemble. La question n’est plus seulement « l’IA fonctionne-t-elle ? », mais « qui est représenté, et comment ? ».

Comment les biais se forment dans les données multimodales

Les modèles d’IA générative apprennent à partir de gigantesques jeux de données collectés sur internet. Des forums, des livres numérisés, des photos publiées sur les réseaux sociaux, des vidéos YouTube - tout cela devient leur bibliothèque. Mais internet n’est pas un miroir neutre de l’humanité. Il reflète les inégalités du monde réel. Les populations avec un meilleur accès à internet, à l’éducation, à la technologie, sont sur-représentées. Les voix marginalisées, les langues minoritaires, les cultures non occidentales - elles sont presque absentes. Prenons un exemple concret : un modèle qui génère à la fois des textes et des images. Si la majorité des photos de « directeurs d’entreprise » dans les données montrent des hommes blancs, le modèle apprend que cette association est « normale ». Il va alors produire presque exclusivement des images de ce type, même si vous demandez simplement « un PDG ». Même pire : si les images de travailleurs manuels sont souvent associées à des personnes à peau foncée dans les données, le modèle va répéter cette stéréotype, même si vous demandez « un ouvrier » sans précision. Ces biais ne sont pas des erreurs accidentelles. Ils sont systématiques. Et ils se renforcent quand les modèles combinent plusieurs modalités. Un texte qui dit « la nurse » peut être associé à une image d’une femme jeune, alors qu’un texte qui dit « le chirurgien » est associé à un homme âgé. Le modèle ne « pense » pas. Il suit les motifs qu’il a vus des milliards de fois.Les trois formes de biais de représentation

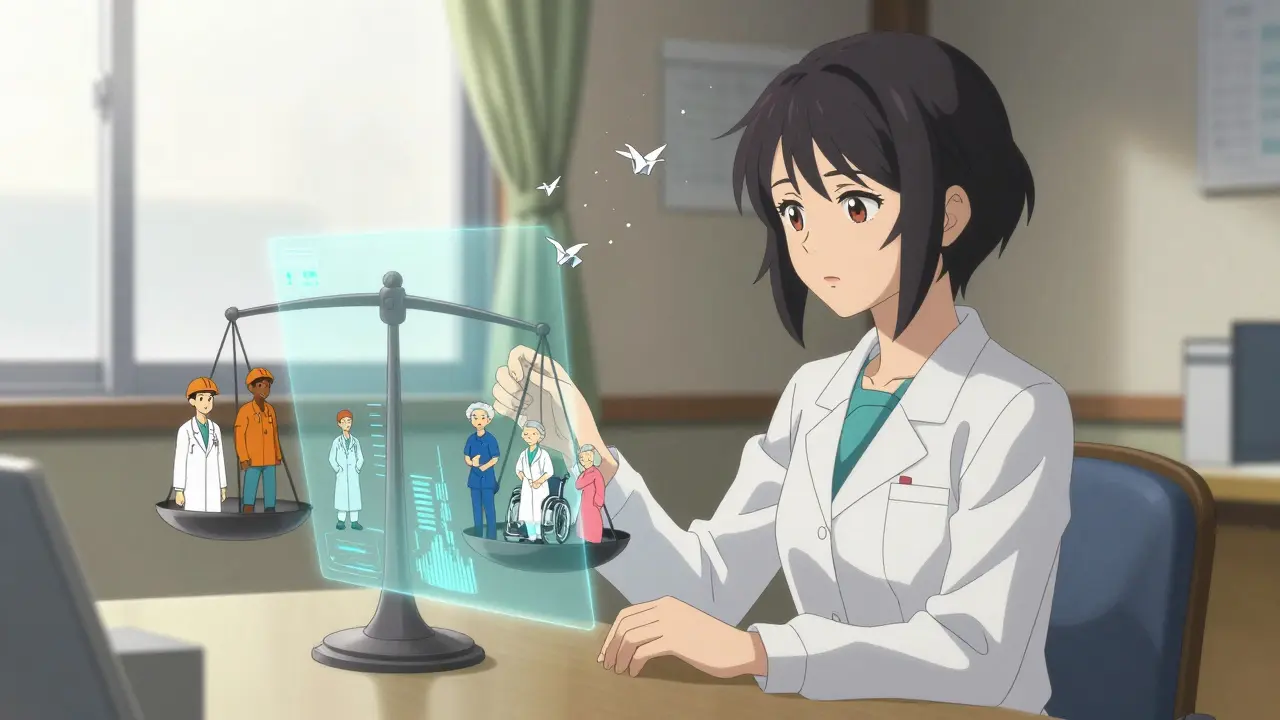

Les chercheurs ont identifié trois types principaux de biais dans les systèmes multimodaux :- Sous-représentation : certains groupes sont presque invisibles. Les femmes dans les images de scientifiques, les personnes handicapées dans les représentations de la vie quotidienne, les langues autochtones dans les textes générés - ils sont absents, ou presque.

- Sur-représentation : certains groupes dominent à l’excès. Les visages blancs, anglophones, occidentaux apparaissent dans 80 % des images générées par des modèles comme Stable Diffusion, même quand la requête est neutre. Cela crée une vision étroite du monde.

- Mé-représentation : un groupe est présent, mais de manière stéréotypée ou négative. Par exemple, les personnes noires apparaissent dans des images de travailleurs de basse rémunération ou de délinquants, même quand la requête est neutre. Ce n’est pas une absence - c’est une distortion.

Comment mesurer le biais ?

Mesurer le biais, ce n’est pas juste compter combien de femmes apparaissent dans les images. Il faut regarder les interactions entre les modalités. Une méthode simple consiste à lancer des requêtes comme « un professeur d’université », « un infirmier », « un entrepreneur » et mesurer la répartition des genres, des races, des âges dans les résultats. Mais ce n’est pas suffisant. Les chercheurs utilisent maintenant trois niveaux d’analyse :- Biais pré-utilisation : on analyse les données d’entraînement avant même de lancer le modèle. On cherche les déséquilibres dans les sources.

- Biais intrinsèque : on examine les sorties du modèle lui-même. Combien de fois génère-t-il des stéréotypes ? Quelle est la similarité entre les représentations de différents groupes dans l’espace vectoriel ?

- Biais extrinsèque : on regarde les impacts réels. Si une IA génère des CV biaisés, est-ce qu’elle affecte les chances d’embauche ? Si elle produit des images médicales erronées, est-ce qu’elle mène à des diagnostics erronés ?

Comment corriger ces biais ?

Il n’existe pas de solution miracle. Mais plusieurs approches montrent des résultats prometteurs. D’abord, nettoyer les données d’entraînement. Cela veut dire retirer les sources connues pour leur contenu toxique ou stéréotypé - certains forums, certains sites de presse biaisés, certains jeux de photos publicitaires. Mais ce n’est pas facile. Qui décide ce qui est « toxique » ? Et que faire des données qui sont rares mais importantes ? Ensuite, rééquilibrer les données. Une technique appelée oversampling consiste à créer artificiellement plus d’exemples pour les groupes sous-représentés. Par exemple, si seulement 5 % des images de médecins montrent des femmes, on génère des versions synthétiques de ces images pour les faire passer à 50 %. Des méthodes comme SMOTE ou des réseaux génératifs avancés (comme les CA-GAN) permettent de créer des images et des textes réalistes qui ne copient pas les stéréotypes, mais les contredisent. Une autre approche est la génération de contre-factuels. Au lieu de juste montrer une femme médecin, on montre une femme médecin dans un contexte où elle est souvent invisible - par exemple, dans un laboratoire de recherche, ou en tant que chef d’équipe. Cela force le modèle à apprendre que ces rôles ne sont pas liés à un genre, une race ou un âge. Les architectures de modèles aussi doivent évoluer. Les anciens modèles comme les GAN classiques ont tendance à se concentrer sur les groupes majoritaires. Les nouvelles versions, comme les Wasserstein GAN with Gradient Penalty ou les CA-GAN, utilisent des couches de réseaux plus complexes et des taux d’apprentissage ajustés pour mieux traiter les données rares. Des études montrent que ces modèles génèrent des images plus équitables pour les patients noirs et les femmes, sans sacrifier la qualité.

Un problème ignoré : les modèles multimodaux sont moins étudiés que les modèles textuels

Voici un fait troublant : les chercheurs passent beaucoup plus de temps à étudier les biais dans les modèles de langage (comme GPT) que dans les modèles multimodaux (comme LLaVA ou Flamingo). Pourquoi ? Parce que les modèles textuels sont plus faciles à analyser. On peut lire les mots. On peut compter les occurrences. Mais dans les modèles multimodaux, le biais se dissimule dans les interactions entre l’image et le texte. Et c’est là que les pires dérives arrivent. Une revue récente a identifié 50 jeux de données et modèles multimodaux. Moins de 20 % avaient été évalués pour leur équité. C’est une faille critique. Parce que quand un modèle génère à la fois une image et un texte, il peut renforcer un stéréotype. Par exemple : un texte qui dit « une mère célibataire » est associé à une image d’une femme pauvre, dans un quartier défavorisé. Le texte seul pourrait être neutre. L’image seule pourrait être banale. Mais ensemble, ils créent un récit nuisible.Que faire maintenant ?

Les entreprises qui utilisent ces IA ne peuvent plus dire « on ne savait pas ». Les outils existent. Les méthodes sont testées. Les preuves sont là. Si vous développez ou utilisez une IA générative multimodale, vous devez :- Évaluer vos données d’entraînement avec des métriques de représentation (genre, race, âge, langue, région).

- Tester vos sorties avec des requêtes variées et mesurer les écarts.

- Utiliser des méthodes de correction comme le rééquilibrage ou les contre-factuels.

- Ne pas vous arrêter à la qualité technique. Posez-vous la question : est-ce que cette IA reproduit les inégalités du monde, ou la déconstruit ?

Qu’est-ce qu’un biais de représentation dans l’IA multimodale ?

Un biais de représentation se produit quand certains groupes de personnes sont mal représentés - soit trop peu, soit de manière stéréotypée - dans les données d’entraînement, ce qui conduit l’IA à générer des résultats inéquitables. Par exemple, une IA peut générer des images de médecins presque exclusivement masculines, ou associer des personnes noires à des rôles de travailleurs manuels, même quand la requête est neutre.

Pourquoi les modèles multimodaux sont-ils plus difficiles à contrôler que les modèles textuels ?

Parce que les biais se croisent. Un modèle textuel peut être biaisé sur les mots. Un modèle multimodal combine texte, image, son - et les biais dans chaque modalité peuvent se renforcer mutuellement. Par exemple, un texte neutre peut être accompagné d’une image stéréotypée, créant un récit plus puissant et plus nuisible que l’un ou l’autre isolément. Cela rend la détection et la correction beaucoup plus complexes.

Les techniques comme SMOTE ou CA-GAN fonctionnent-elles vraiment ?

Oui, dans des contextes contrôlés. Des études montrent que SMOTE et CA-GAN améliorent significativement la représentation des groupes sous-représentés - par exemple, en augmentant la proportion d’images de femmes dans des rôles de leadership ou de patients noirs dans des diagnostics médicaux. Ces méthodes ne suppriment pas entièrement le biais, mais elles réduisent les écarts de manière mesurable, surtout quand elles sont combinées avec une évaluation qualitative.

Est-ce que nettoyer les données d’entraînement suffit à corriger le biais ?

Non. Retirer les sources toxiques est un bon début, mais les biais sont souvent invisibles dans les données « propres ». Par exemple, une image de « famille » dans un magazine peut sembler neutre, mais montrer uniquement des parents hétérosexuels et blancs. Le problème n’est pas toujours la qualité des données - c’est leur homogénéité. Il faut aussi ajouter des données diverses, pas seulement en retirer des mauvaises.

Qui est responsable de corriger ces biais ?

Tout le monde. Les ingénieurs doivent concevoir des modèles équitables. Les équipes de données doivent sélectionner des jeux de données diversifiés. Les décideurs doivent exiger des audits d’équité avant le déploiement. Et les utilisateurs doivent poser des questions : « Qui a été oublié ici ? » La responsabilité n’est pas uniquement technique - elle est éthique, sociale et politique.