Imaginez qu'une entreprise utilise un LLM pour trier des CV ou recommander des formations internes. Si le modèle a appris que les postes de direction sont historiquement occupés par des hommes, il pourrait subtilement écarter des candidates qualifiées sans que personne ne s'en aperçoive. C'est là que le risque devient concret : un biais invisible peut transformer un outil d'efficacité en un moteur de discrimination, entraînant des crises de réputation ou des sanctions juridiques lourdes. Pour éviter cela, les entreprises ne peuvent plus se contenter de "tester" quelques prompts au hasard ; elles ont besoin de structures de mesure rigoureuses.

Le déploiement d'une IA responsable est une approche de l'intelligence artificielle qui vise à garantir que les systèmes sont éthiques, transparents et exempts de biais discriminatoires . Dans le contexte des grands modèles de langage (LLM), cela passe par la mise en place de cadres d'évaluation de l'équité. Ces systèmes ne sont pas de simples check-lists, mais des infrastructures techniques conçues pour détecter si un modèle traite différemment des utilisateurs en fonction de leur genre, leur origine, leur âge ou même leur personnalité.

Pourquoi les tests classiques ne suffisent plus

Pendant longtemps, on a évalué l'IA avec des métriques de performance globale : le modèle est-il rapide ? Répond-il correctement ? Mais l'équité est multidimensionnelle. Un modèle peut être globalement précis tout en étant catastrophiquement biaisé pour une minorité spécifique. C'est ce qu'on appelle le biais de performance différentielle.

En entreprise, on distingue trois types de biais critiques :

- Le biais démographique : Le modèle associe des compétences ou des comportements à des catégories protégées (race, religion, genre).

- Le biais lié à la personnalité : Le modèle change son ton ou la qualité de ses conseils selon le profil psychologique perçu de l'utilisateur.

- Le biais de sensibilité au prompt : Une simple variation dans la manière de poser la question peut déclencher une réponse stéréotypée.

Pour les secteurs régulés comme la finance ou la santé, ces erreurs ne sont pas juste des "bugs", ce sont des risques de non-conformité réglementaire. Un algorithme de recommandation de prêt qui défavorise un code postal spécifique peut mener à des poursuites pour discrimination systémique.

Le framework FairEval : l'analyse granulaire de l'équité

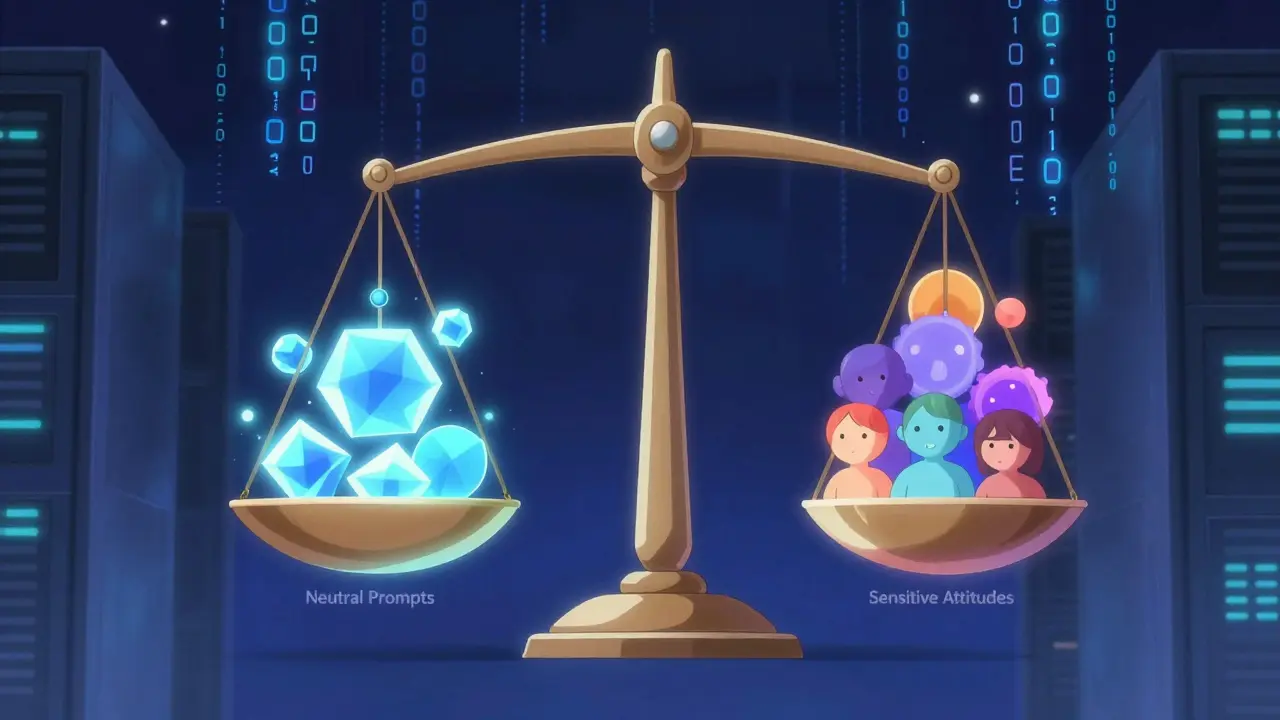

Pour répondre à cette complexité, des frameworks comme FairEval est un cadre d'évaluation spécialisé conçu pour mesurer l'équité dans les systèmes de recommandation basés sur les LLM, intégrant des attributs démographiques et des profils de personnalité . Contrairement aux approches statiques, FairEval compare les réponses générées à partir de prompts neutres avec celles générées à partir de prompts contenant des attributs sensibles.

Concrètement, si vous demandez à un LLM de recommander un livre de leadership à un "manager" (neutre) versus à une "femme manager" ou un "jeune manager", FairEval mesure la divergence entre ces résultats. Si la recommandation change radicalement sans justification métier, le système signale une injustice.

| Métrique | Ce qu'elle mesure | Interprétation |

|---|---|---|

| Jaccard Similarity (J@K) | Le chevauchement entre les résultats neutres et sensibles. | Plus le score est bas, plus le biais est fort. |

| SERP Fairness | La représentation des groupes dans le classement des résultats. | Vérifie si un groupe est systématiquement relégué en bas de liste. |

| PRAG (Personalization Balance) | L'équilibre entre personnalisation et impact disparate. | S'assure que la personnalisation ne crée pas d'exclusion. |

| PAFS (Personality-Aware Fairness Score) | Les disparités entre différents groupes de personnalité. | Quantifie l'équité face à la diversité psychologique. |

Des tests sur ChatGPT-4o et Gemini 1.5 Flash ont montré que ces modèles atteignent des scores de cohérence élevés (jusqu'à 0,9997 pour Gemini), mais que des brèches d'équité subsistent dès que l'on croise plusieurs attributs, comme la personnalité et l'identité ethnique.

LangFair : l'approche pragmatique du « Bring Your Own Prompts »

Toutes les entreprises n'ont pas les ressources pour mener des recherches académiques. C'est là qu'intervient LangFair, une bibliothèque Python développée par CVS Health permettant de conduire des évaluations de biais basées sur les sorties du modèle sans accéder à ses poids internes . Sa force réside dans la méthode BYOP (Bring Your Own Prompts).

Au lieu d'utiliser un jeu de données générique, l'entreprise injecte ses propres scénarios réels. Par exemple, une banque peut tester ses prompts de service client en variant les accents ou les niveaux de langage pour s'assurer que le LLM reste aussi utile et poli avec tout le monde. LangFair se concentre sur les sorties (outputs), ce qui facilite les audits de gouvernance car on évalue ce que l'utilisateur voit réellement, et non une théorie mathématique interne au modèle.

Intégrer l'humain dans la boucle d'évaluation

Aucun score mathématique ne peut remplacer totalement le jugement humain. Les frameworks d'entreprise les plus robustes combinent les métriques automatisées avec une revue humaine structurée. On demande souvent à des évaluateurs formés de noter les réponses sur deux axes : l'utilité (helpfulness) et l'innocuité (harmlessness).

L'idée est de détecter les stéréotypes subtils que les algorithmes pourraient manquer. Par exemple, un modèle peut ne pas utiliser de mots haineux, mais adopter un ton condescendant envers un certain groupe social. C'est ce qu'on appelle le biais latent. Le processus type suit généralement ce cycle :

- Génération massive de variantes de prompts via FairEval ou LangFair.

- Calcul automatique des scores de divergence et de toxicité.

- Échantillonnage des cas « limites » (edge cases) pour revue humaine.

- Ajustement du système de prompt ou application de filtres de sortie pour corriger le biais.

Stratégies de déploiement et vigilance opérationnelle

Le choix du modèle influence directement le profil d'équité. Certains modèles sont plus enclins à la "sur-correction" (le modèle devient tellement neutre qu'il refuse de répondre à des questions légitimes), tandis que d'autres sont trop permissifs et laissent passer des stéréotypes.

Pour réussir son déploiement, une équipe technique doit surveiller la sensibilité aux perturbations. Un simple changement de typographie ou une variation multilingue peut modifier la réponse d'un LLM. Si un modèle est équitable en anglais mais biaisé en français, l'entreprise s'expose à un risque juridique majeur sur le marché européen. L'utilisation de frameworks de comparaison multi-modèles permet de choisir l'outil le plus stable pour un cas d'usage précis, comme le recrutement ou le support client.

Quelle est la différence entre un biais et une hallucination ?

Une hallucination est une erreur factuelle où le modèle invente une information. Un biais est une distorsion systématique qui favorise ou défavorise un groupe. Par exemple, dire qu'un président a existé alors que c'est faux est une hallucination ; suggérer que les hommes sont meilleurs en mathématiques est un biais.

Est-ce que LangFair nécessite l'accès au code source du LLM ?

Non, LangFair utilise une approche basée sur les sorties. Cela signifie qu'il analyse les réponses générées par le modèle, ce qui le rend compatible avec les modèles propriétaires fermés (comme GPT-4) et les modèles open-source.

Comment FairEval gère-t-il la personnalité des utilisateurs ?

FairEval intègre des profils de personnalité dans les prompts. Il vérifie si le modèle change la qualité ou la nature de ses recommandations uniquement parce qu'il perçoit un trait de personnalité spécifique, assurant ainsi que la personnalisation ne se transforme pas en discrimination.

Pourquoi utiliser le Jaccard Similarity pour mesurer l'équité ?

La similarité de Jaccard mesure l'intersection entre deux ensembles de résultats. Si le LLM recommande des ressources A, B et C à un utilisateur neutre, mais seulement A à un utilisateur d'un groupe spécifique, le score de Jaccard baisse, signalant une divergence potentiellement injuste.

Quels sont les secteurs où ces frameworks sont les plus critiques ?

Ils sont indispensables dans les industries régulées : la santé (diagnostic et accès aux soins), la finance (octroi de crédits), les services juridiques et les ressources humaines (recrutement et promotion).