On pense souvent qu’un modèle de langage est « grand » simplement parce qu’il a des milliards ou des billions de paramètres. Mais cette idée est de plus en plus dépassée. En 2026, la vraie mesure d’un modèle large n’est plus son nombre de paramètres - c’est ce qu’il fait avec eux.

Le mythe du nombre de paramètres

Il y a cinq ans, un modèle avec 340 millions de paramètres, comme BERT, était considéré comme impressionnant. Aujourd’hui, il serait qualifié de « minuscule ». Les grands modèles comme GPT-4 ou LLaMA-3 70B dépassent les 70 milliards, voire 1 800 milliards de paramètres. Mais pourquoi cela compte-t-il vraiment ? La réponse simple : ça ne compte pas tout seul. Un modèle avec 100 milliards de paramètres peut être moins performant qu’un autre avec 30 milliards, si celui-ci est mieux conçu. Ce n’est pas la quantité de paramètres qui définit la grandeur - c’est la capacité émergente qu’ils permettent.Les capacités qui apparaissent soudainement

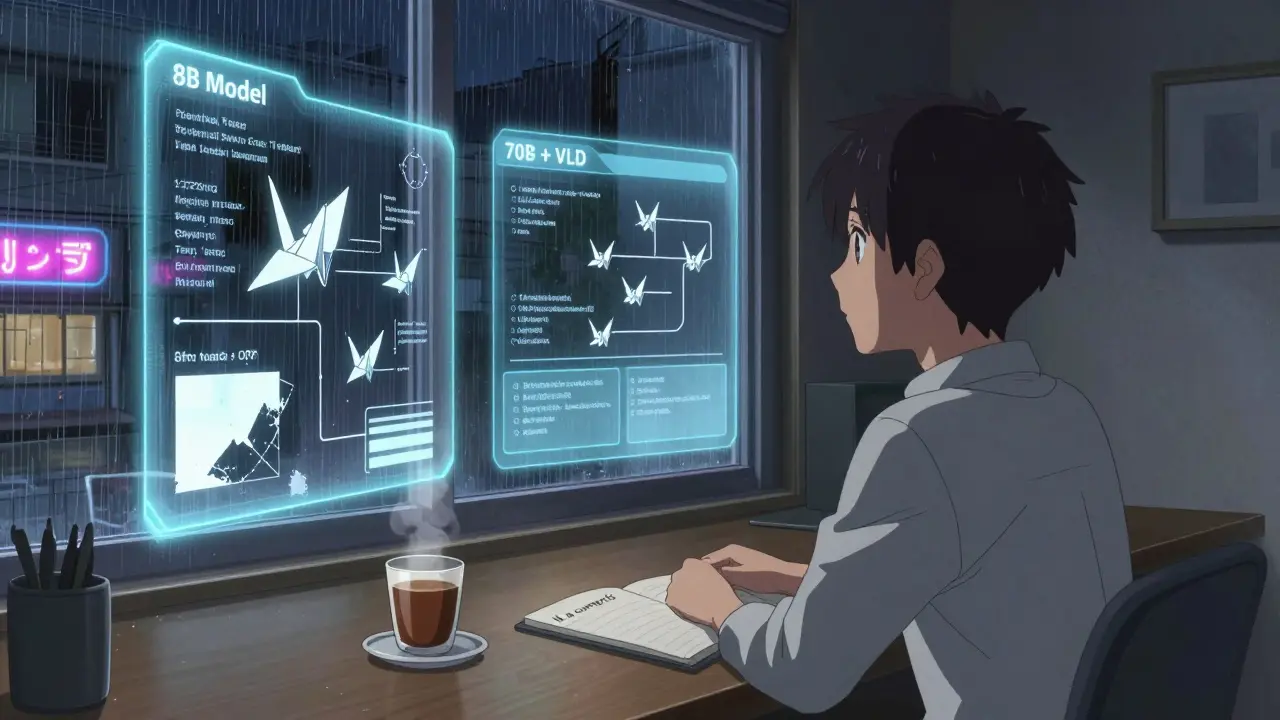

Les chercheurs de Stanford ont découvert en 2025 un phénomène clé : certaines capacités n’apparaissent qu’au-delà d’un seuil précis. C’est ce qu’ils appellent des « ruptures dans les lois d’échelle ». Pas de progression linéaire. Pas d’amélioration progressive. Un saut brutal. Par exemple, avant 62 milliards de paramètres, les modèles ne comprennent pas le raisonnement en plusieurs étapes - même si on leur demande explicitement de réfléchir pas à pas. Ils font des erreurs, se contredisent, ou pire : ils inventent des réponses plausibles mais fausses. Au-delà de ce seuil, ils commencent à raisonner comme un humain. Ils peuvent prendre un texte en hinglish (un mélange d’hindi et d’anglais), identifier les éléments offensants, et produire une version équivalente en anglais. Ils peuvent traduire des proverbes swahili en anglais, en gardant le sens culturel. Ces compétences ne sont pas programmées. Elles émergent. C’est ce que les développeurs ressentent en pratique. Sur Reddit, un ingénieur a écrit : « Passer de Llama-3 8B à 70B n’a pas juste donné de meilleures réponses. Cela a changé la façon dont le modèle abordait les problèmes. Il a commencé à raisonner tout seul - sans que je le lui demande. »La profondeur logique virtuelle (VLD) : une révolution silencieuse

L’idée la plus fascinante de 2025 vient toujours de Stanford. Une équipe a introduit la profondeur logique virtuelle (VLD) : une méthode qui augmente la capacité de raisonnement sans ajouter de paramètres. Comment ? En réutilisant intelligemment les mêmes poids pendant l’entraînement et l’inférence. C’est comme si un pianiste apprenait à jouer une mélodie plus complexe en répétant les mêmes touches, mais dans un ordre plus sophistiqué. Le nombre de touches ne change pas. Mais la musique devient plus riche. Les résultats ? Une amélioration de 23,7 % sur des tests de raisonnement complexe, avec exactement le même nombre de paramètres. Cela signifie qu’un modèle de 7 milliards de paramètres, optimisé avec VLD, peut rivaliser avec un modèle de 70 milliards sur certaines tâches. C’est une révolution : la grandeur n’est plus seulement une question de taille, mais de structure.

Architecture : ce qui fait la différence

Le nombre de paramètres n’est qu’un élément. L’architecture compte autant - voire plus. BERT, par exemple, n’était pas le plus grand modèle de son époque. Mais son approche bidirectionnelle - où chaque mot prend en compte le contexte avant et après - lui a permis de surpasser des modèles plus gros sur des tâches de compréhension. Aujourd’hui, les modèles comme LLaMA-3 70B gagnent en performance grâce à des optimisations architecturales : une meilleure gestion de la mémoire, une répartition plus efficace des couches, une attention plus ciblée. Les chercheurs d’Anthropic ont aussi découvert un phénomène appelé « localisation de la connaissance ». Plus un modèle est grand, plus ses connaissances sont organisées de façon précise. Il ne les stocke pas au hasard. Il les range, comme un bibliothécaire qui sait exactement où trouver chaque livre. Cela réduit les erreurs, les fuites de mémoire, et les réponses incohérentes.Le fossé entre les petits et les grands modèles

Les modèles sous 50 milliards de paramètres atteignent seulement 42,3 % de précision sur des tâches de raisonnement à plusieurs étapes. Au-delà de 60 milliards, ce chiffre saute à 78,9 %. Ce n’est pas une amélioration. C’est un changement de nature. Les petits modèles, comme les variantes de BERT, sont excellents pour des tâches spécifiques : classification de texte, détection de sentiments, extraction d’informations. Ils sont rapides, peu coûteux, et parfois plus précis que les géants pour ces cas d’usage. Mais ils ne peuvent pas faire ce que les grands modèles font naturellement : utiliser des outils externes, suivre des instructions complexes, ou s’adapter à des contextes inédits sans réentraînement. Un développeur sur GitHub a écrit : « J’ai passé trois semaines à optimiser mes prompts pour le modèle de 8B. Avec le 70B, j’ai juste écrit la question. Il a compris. »Le coût réel de la grandeur

Mais tout ça a un prix. Déployer un modèle de plus de 60 milliards de paramètres nécessite des GPU NVIDIA A100 avec 80 Go de mémoire. Chaque nœud coûte environ 12 500 $ par mois dans le cloud. L’entraînement d’un modèle de cette taille peut atteindre 2 à 3 millions de dollars. C’est pourquoi 78 % des entreprises utilisent encore des modèles sous 20 milliards de paramètres. Elles n’ont pas besoin de la puissance brute. Elles veulent des résultats fiables, à moindre coût. Les modèles optimisés avec VLD ou d’autres techniques de compression deviennent donc la nouvelle norme : 63 % des entreprises du Fortune 500 les utilisent désormais.

Les risques cachés des modèles intermédiaires

Il y a un danger que personne ne parle assez : les modèles entre 10 et 50 milliards de paramètres. Ils sont assez grands pour acquérir des capacités dangereuses - comme générer des discours de haine, manipuler des opinions, ou imiter des experts - mais pas assez grands pour être bien alignés. La chercheuse Emily Chen a écrit en décembre 2025 : « Focaliser sur la taille crée une illusion. Les modèles de taille moyenne gagnent des compétences critiques sans les mécanismes de sécurité nécessaires. C’est comme donner un fusil à un enfant qui ne sait pas comment l’utiliser. » L’Union européenne l’a compris. Dans sa mise à jour de janvier 2026 de la loi sur l’IA, elle a imposé des exigences spécifiques aux modèles au-delà de 50 milliards de paramètres. Le coût de conformité ? 1,2 million de dollars par modèle. Ce n’est pas une taxe. C’est une protection.Le futur : ce qui compte vraiment

Le futur des modèles de langage ne sera pas écrit en billions de paramètres. Il sera écrit en profondeur logique, en organisation de la connaissance, et en efficacité d’usage. Google, Anthropic et Stanford sont d’accord : la prochaine génération de modèles sera mesurée non pas par leur taille, mais par leur profondeur effective. Comment ils pensent. Comment ils retiennent. Comment ils réutilisent. Comment ils raisonnent. Les développeurs le savent déjà. Ce n’est plus : « Quel est le plus gros modèle ? » C’est : « Quel modèle fait ce que je veux, avec le moins de ressources ? »Les trois niveaux du marché en 2026

Le marché des modèles de langage s’est divisé en trois catégories claires :- Modèles fondationnels : plus de 100 milliards de paramètres. Coût d’entraînement : 1 à 3 millions de dollars. Réservés aux géants comme OpenAI, Google, Meta.

- Modèles grands optimisés : 20 à 100 milliards de paramètres, avec VLD ou autres techniques. Coût : 250 000 à 750 000 dollars. Le nouveau standard pour les entreprises sérieuses.

- Modèles spécialisés : moins de 20 milliards de paramètres. Coût : moins de 100 000 dollars. Parfaits pour les tâches précises, rapides et bon marché.

La tendance est claire : les entreprises ne veulent plus de la plus grande taille. Elles veulent la meilleure efficacité.

Un modèle avec moins de paramètres peut-il être aussi performant qu’un grand modèle ?

Oui, mais seulement pour certaines tâches. Les petits modèles, comme BERT ou Llama-3 8B, sont souvent meilleurs pour des travaux spécifiques comme la classification de texte ou l’extraction d’informations. Ils sont plus rapides, moins chers, et plus faciles à déployer. Mais ils ne peuvent pas faire ce que les grands modèles font naturellement : raisonner en plusieurs étapes, suivre des instructions complexes, ou utiliser des outils externes. La performance dépend de ce que vous voulez qu’il fasse.

Qu’est-ce que la profondeur logique virtuelle (VLD) ?

La VLD est une technique développée par Stanford en 2025 qui permet d’augmenter la capacité de raisonnement d’un modèle sans ajouter de paramètres. Elle réutilise intelligemment les mêmes poids pendant l’entraînement et l’inférence, comme un musicien qui joue une mélodie plus complexe avec les mêmes touches. Cela améliore les performances sur les tâches de raisonnement jusqu’à 23,7 %, avec le même nombre de paramètres.

Pourquoi 62 milliards de paramètres est-il un seuil critique ?

Des recherches de Google en 2022 ont montré que les modèles en dessous de ce seuil ne bénéficient pas du raisonnement en chaîne - ils deviennent même moins performants. Au-delà de 62 milliards, ils commencent à raisonner de manière autonome, sans qu’on les pousse à le faire. C’est un saut qualitatif, pas quantitatif. C’est là que les modèles passent de « répéter » à « comprendre ».

Les modèles grands sont-ils toujours meilleurs ?

Non. Pour 80 % des applications commerciales, un modèle de moins de 30 milliards de paramètres, bien optimisé, suffit. Les grands modèles sont utiles pour les tâches complexes : analyse de documents, génération de code, prise de décision multi-étapes. Mais pour répondre à un email, classer des tickets, ou analyser des avis clients, un petit modèle est souvent plus rapide, plus précis et beaucoup moins cher.

Pourquoi les entreprises n’utilisent-elles pas toujours les plus grands modèles ?

Parce que le coût et la complexité sont élevés. Déployer un modèle de plus de 60 milliards de paramètres nécessite des GPU puissants, des pipelines d’inférence personnalisés, et une équipe technique expérimentée. Pour la plupart des entreprises, le gain de performance ne justifie pas le coût. Les modèles optimisés entre 30 et 70 milliards de paramètres offrent un meilleur équilibre entre capacité et coût.

Quelle est la tendance future pour les modèles de langage ?

Le futur ne sera plus dans la taille, mais dans la structure. Les chercheurs se concentrent sur la profondeur logique, l’organisation de la connaissance, et la réutilisation intelligente des paramètres. La prochaine révolution ne viendra pas d’un modèle plus gros, mais d’un modèle plus intelligent dans la façon dont il utilise ce qu’il a déjà.