Le RAG : Ancrer l'IA dans la réalité

Le secret du RAG réside dans le passage d'un mode de "rappel global" à un mode de "génération basée sur des faits". Au lieu de laisser l'agent puiser dans ses données d'entraînement (qui peuvent dater ou être imprécises), on met en place un processus de récupération rigoureux. Concrètement, cela fonctionne ainsi : quand l'utilisateur pose une question, le système convertit cette requête en vecteurs mathématiques via des modèles comme BERT. Il fouille ensuite dans une base de données vectorielle pour extraire les passages les plus pertinents. Ces extraits sont injectés dans le prompt du LLM avec une consigne simple : "Utilise uniquement ces informations pour répondre". Par exemple, si vous demandez à un agent les spécifications d'une API interne, sans RAG, il pourrait inventer des points de terminaison plausibles mais faux. Avec le RAG, il récupère la documentation technique exacte et s'en sert comme unique source de vérité. Cela réduit drastiquement les erreurs, car le modèle n'a plus besoin de deviner.Les Guardrails : Le filet de sécurité programmable

Si le RAG apporte la bonne information, les Guardrails (ou garde-fous) sont là pour vérifier que l'IA ne s'égare pas malgré tout. Considérez-les comme un filtre de contrôle qualité placé entre le modèle et l'utilisateur final. Ces systèmes fonctionnent via des validateurs programmables. L'un des outils les plus efficaces est le validateur de provenance. Il analyse la réponse du LLM phrase par phrase et vérifie si chaque affirmation s'appuie réellement sur les documents fournis par le RAG. Si le modèle ajoute une information qui ne figure pas dans la source, le Guardrail peut soit supprimer la phrase hallucinée, soit demander au modèle de reformuler sa réponse.| Approche | Mécanisme principal | Point fort | Limite |

|---|---|---|---|

| RAG | Injection de données externes | Précision factuelle accrue | Dépendance à la qualité de l'indexation |

| Guardrails | Validation post-génération | Sécurité et conformité | Peut ajouter de la latence |

| Human-in-the-loop | Révision humaine | Fiabilité maximale | Non scalable en temps réel |

Détecter et mesurer : Le rôle des métriques RAGAS

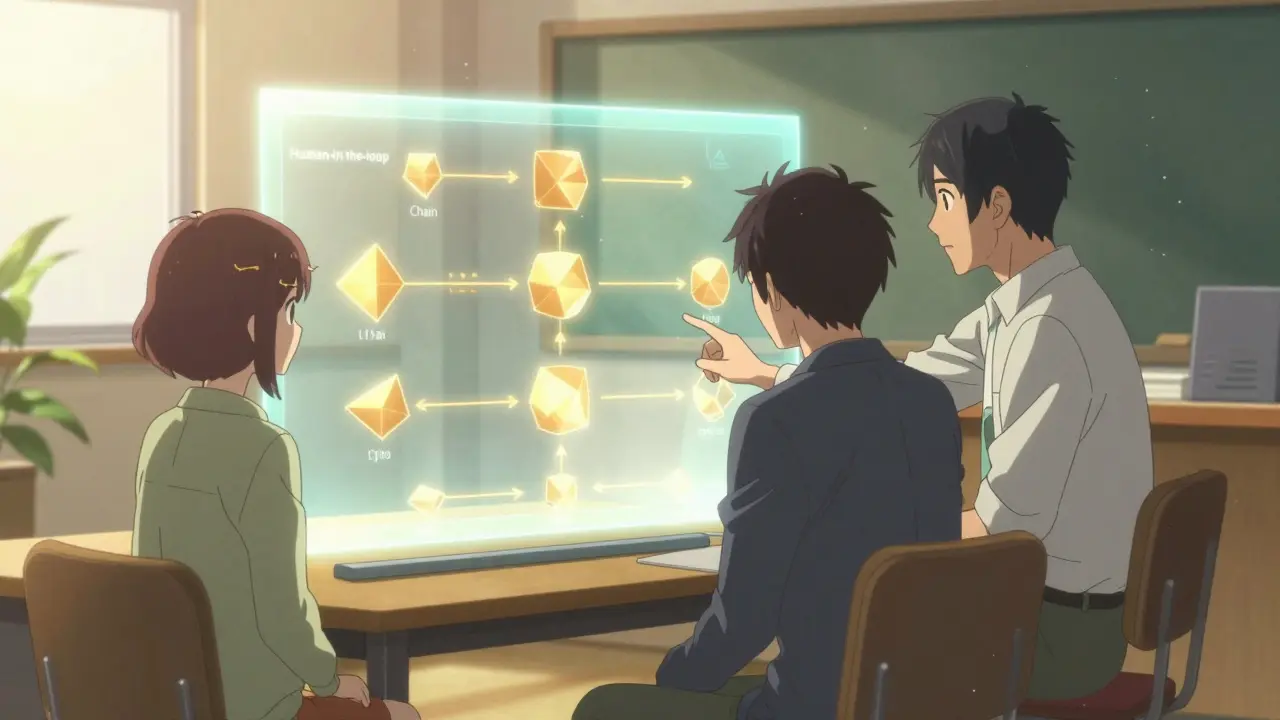

On ne peut pas améliorer ce qu'on ne mesure pas. Pour savoir si vos agents hallucinent encore, vous avez besoin de métriques concrètes. C'est là qu'intervient RAGAS (Retrieval Augmented Generation Automatic Score). Ce framework permet de quantifier la performance de l'IA selon deux axes majeurs : la pertinence de la réponse et sa fidélité par rapport au contexte. En utilisant RAGAS, vous pouvez définir des seuils de tolérance. Si le score de "fidélité" descend en dessous de 0,8, par exemple, le système peut déclencher une alerte. Dans un workflow avancé, cette alerte peut envoyer la réponse vers une file d'attente de service client pour qu'un humain vérifie l'information avant qu'elle n'atteigne le client. C'est ce qu'on appelle le processus "Human-in-the-loop".

Stratégies complémentaires pour une fiabilité maximale

Le RAG et les Guardrails sont puissants, mais ils fonctionnent encore mieux quand on les combine à des techniques de prompting avancées. Le Chain of Thought (Chaîne de Pensée) est particulièrement utile. Au lieu de demander une réponse directe, on force le modèle à détailler son raisonnement étape par étape. Cela réduit les erreurs de logique qui mènent souvent aux hallucinations. Vous pouvez aussi ajouter du Few-Shot Prompting, c'est-à-dire donner au modèle quelques exemples de questions-réponses parfaites avant qu'il ne traite la demande réelle. Cela lui donne un « moule » de comportement à suivre. Enfin, pour les entreprises avec des besoins très spécifiques, le fine-tuning (ajustement précis) du modèle sur des données métier reste une option, même si elle est plus coûteuse et moins flexible que le RAG. L'idéal est d'adopter une stratégie en couches : un modèle de qualité, optimisé par du RAG, surveillé par des Guardrails et affiné par des retours humains.Arbitrer entre latence et précision

Le grand défi lors du déploiement d'agents IA est le compromis entre la vitesse et la fiabilité. Un agent qui utilise des flux de travail statiques et des Guardrails simples sera très rapide, mais moins adaptable. À l'inverse, un agent capable d'orchestrer son propre raisonnement en temps réel, de vérifier ses sources via RAGAS et de solliciter un humain en cas de doute, sera infiniment plus fiable mais plus lent. Pour les domaines à haut risque comme la santé ou la finance, la latence est un prix acceptable pour garantir l'exactitude. Pour un chatbot de support basique, on privilégiera des Guardrails légers et un RAG optimisé pour maintenir une expérience utilisateur fluide.Est-il possible d'éliminer totalement les hallucinations ?

Honnêtement, non. Les LLM sont probabilistes par nature. Cependant, la combinaison du RAG et des Guardrails peut réduire les erreurs à un niveau statistiquement négligeable, rendant l'IA utilisable même dans des contextes professionnels exigeants.

Quelle est la différence entre le RAG et le fine-tuning ?

Le fine-tuning modifie les poids internes du modèle pour qu'il apprenne un style ou un domaine. Le RAG ne modifie pas le modèle, mais lui donne un "livre ouvert" de connaissances externes. Le RAG est beaucoup plus facile à mettre à jour : il suffit de modifier le document source sans avoir à réentraîner l'IA.

Comment fonctionnent concrètement les Guardrails de provenance ?

Ils comparent chaque affirmation de la réponse générée avec les segments de texte récupérés par le RAG. Si une phrase ne trouve aucune correspondance sémantique forte dans la source, elle est marquée comme hallucination et peut être supprimée ou signalée.

RAGAS est-il indispensable pour réduire les hallucinations ?

Ce n'est pas indispensable pour le fonctionnement, mais c'est crucial pour l'optimisation. Sans métriques comme RAGAS, vous avancez à l'aveugle. Cela vous permet de savoir précisément si vos hallucinations diminuent après un changement de prompt ou de base de données.

Le Chain of Thought aide-t-il vraiment contre les hallucinations ?

Oui, car il force le modèle à décomposer la logique. En écrivant les étapes intermédiaires, le modèle a plus de chances de détecter une incohérence avant d'arriver à la conclusion finale, ce qui stabilise la réponse.