Les entreprises qui utilisent des modèles de langage à grande échelle (LLM) comme ChatGPT, Claude ou Gemini ne gèrent pas simplement un logiciel. Elles gèrent une relation dynamique, imprévisible et hautement risquée avec un fournisseur dont le produit change chaque semaine. Les contrats traditionnels, conçus pour des logiciels statiques, ne suffisent plus. Ils ne prévoient pas ce qui arrive quand un modèle génère des informations fausses, biaisées ou illégales. Et pourtant, beaucoup d’organisations signent encore des accords basés sur des SLA classiques : « uptime à 99,9 % », « support 24/7 », « mises à jour trimestrielles ». C’est comme signer un contrat pour une voiture en ne mentionnant que la couleur et la garantie, sans parler du freinage ou de la sécurité des passagers.

Les cinq différences fondamentales entre les contrats traditionnels et ceux pour les LLM

Les contrats pour les fournisseurs de LLM doivent être réinventés. Voici les cinq domaines où la différence est cruciale.

Le premier point, c’est la nature des SLA (accords de niveau de service). Dans le monde du logiciel classique, un SLA garantit que le système est disponible 99,9 % du temps. Pour un LLM, la disponibilité ne compte pas. Ce qui compte, c’est la précision. Un modèle qui fonctionne 100 % du temps mais qui donne 40 % de réponses erronées est un échec. Les contrats modernes exigent des indicateurs comme : précision minimale de 85 % sur les tâches critiques, dégradation mensuelle du modèle inférieure à 1 %, et capacité à expliquer 80 % des décisions prises. Cela demande une surveillance continue, pas une vérification annuelle.

Le deuxième point, c’est la propriété des données et des sorties. Dans un contrat SaaS classique, vous payez pour accéder à un logiciel. Les données que vous y entrez vous appartiennent. Avec un LLM, c’est différent. Quand vous envoyez des contrats clients, des documents internes ou des données de clients à un modèle, vous ne savez pas toujours ce qu’il en fait. Il peut les utiliser pour entraîner sa prochaine version. Certains fournisseurs incluent des clauses qui leur permettent d’utiliser vos données pour améliorer leurs modèles. Les contrats efficaces interdisent cela explicitement. Ils précisent que les données d’entrée, les sorties générées et les ajustements faits par vos équipes restent votre propriété exclusive.

Le troisième point est la responsabilité légale. Dans un contrat traditionnel, la responsabilité est limitée à 1 à 2 fois le montant annuel du contrat. Pour un LLM, cela ne suffit pas. Si un modèle génère un rapport financier erroné qui conduit à une perte de 10 millions de dollars, une clause de limitation de responsabilité de 50 000 dollars est inacceptable. Les contrats les plus solides prévoient des responsabilités échelonnées : jusqu’à 3 fois le montant annuel pour les erreurs de biais, et responsabilité illimitée en cas de violation de données ou de non-conformité aux lois comme le RGPD ou l’AI Act européen.

Le quatrième point, c’est la transparence des modèles. Les fournisseurs doivent fournir des cartes de modèle : données d’entraînement, sources, tests de biais, métriques de performance. L’Office of Management and Budget (OMB) des États-Unis l’a rendu obligatoire pour les agences fédérales depuis mars 2025. Ce n’est plus un luxe. C’est une exigence légale. Sans ces documents, vous ne pouvez pas évaluer les risques. Vous ne savez pas si le modèle a été entraîné sur des données juridiques obsolètes, ou sur des textes biaisés.

Le cinquième point, c’est la sortie sécurisée. Vous ne voulez pas être coincé. Si le fournisseur disparaît, augmente ses prix ou change sa politique, vous devez pouvoir passer à un autre système. Les contrats doivent inclure un plan de sortie clair : comment récupérer vos données, comment exporter vos ajustements personnalisés, et combien de temps le fournisseur doit vous aider à migrer. Sans cela, vous êtes en situation de dépendance totale.

Les erreurs courantes - et comment les éviter

La plupart des entreprises échouent dès le départ. Voici les erreurs les plus fréquentes, basées sur des études de cas réels.

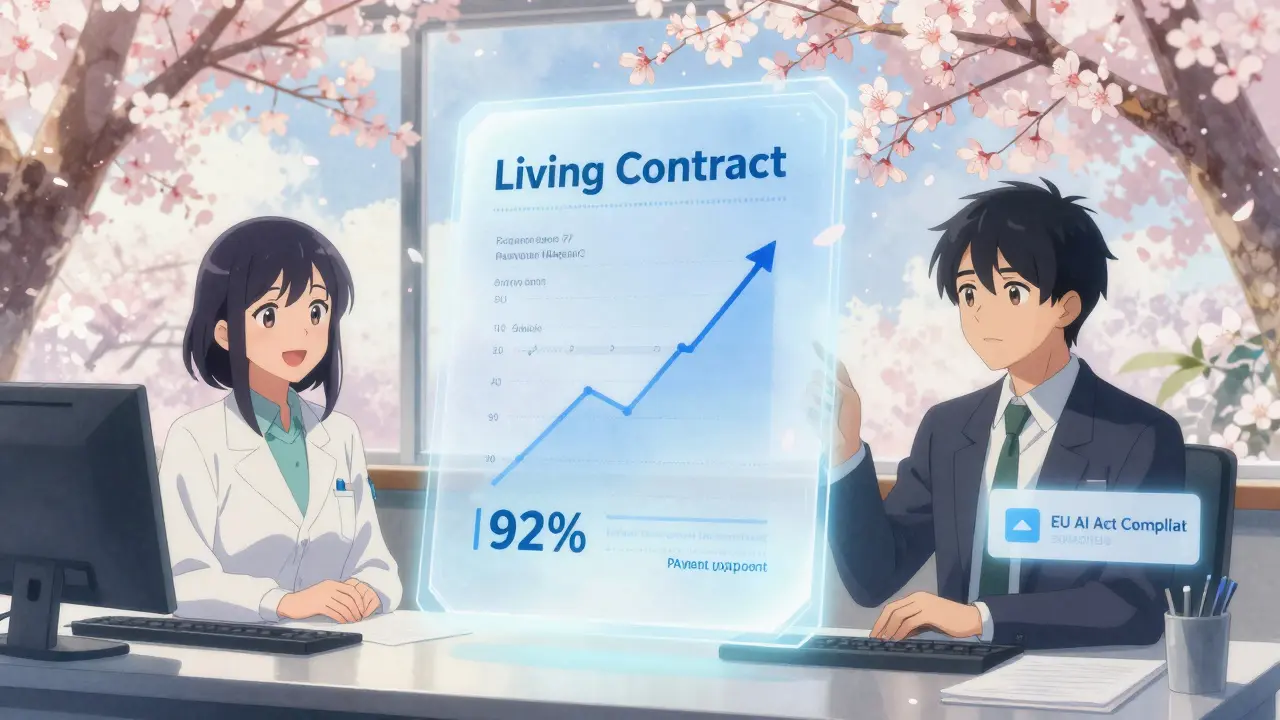

La première erreur, c’est de croire que « l’uptime » suffit. Une entreprise du secteur immobilier en Moyen-Orient a signé un contrat avec un fournisseur de LLM pour automatiser la lecture de contrats locaux. Le modèle avait un uptime de 99,8 %. Mais après 10 mois, sa précision est tombée de 92 % à 78 %. Pourquoi ? Parce que les lois locales avaient changé, et le modèle n’avait pas été mis à jour. Le contrat ne prévoyait pas de seuil de dégradation. L’entreprise a perdu des mois de travail, et le fournisseur a refusé toute compensation. Leçon : un SLA sans métrique de performance est une arnaque.

La deuxième erreur, c’est de ne pas impliquer les juristes spécialisés en IA. Une étude de Baker McKenzie montre que 68 % des entreprises n’ont pas de juriste formé à l’IA dans leur équipe de négociation. Résultat ? Des clauses vagues comme « le fournisseur garantit un usage éthique » - sans définition, sans audit, sans conséquence. Les contrats efficaces citent des normes précises : EU AI Act, NIST AI Risk Management Framework, ISO/IEC 23053:2022.

La troisième erreur, c’est l’absence de plan de mise à jour. Les modèles changent constamment. Un fournisseur peut publier une nouvelle version chaque semaine. Sans clause de « déploiement en canari » (canary deployment), vous risquez d’être victime d’une mise à jour défectueuse. Les bons contrats exigent que toute mise à jour soit testée sur 5 % des utilisateurs avant d’être déployée à tous. Et qu’un plan de retrait soit activé en cas de baisse de performance.

La quatrième erreur, c’est de sous-estimer le coût de la surveillance. Une entreprise a investi 300 000 $ dans un LLM. Mais elle n’a pas alloué de budget pour les data scientists qui doivent vérifier quotidiennement les erreurs, les biais, les dérives. Au bout d’un an, elle a dû dépenser 66 000 $ en plus - soit 22 % du coût initial - pour réparer les dégâts. Le coût de la surveillance n’est pas un coût optionnel. C’est un coût opérationnel.

Qui doit être impliqué dans la négociation ?

Un contrat LLM ne peut pas être négocié par le service achats seul. Il faut une équipe interdisciplinaire.

- Deux à trois juristes spécialisés en IA : ils doivent connaître les lois sur la protection des données, la responsabilité algorithmique, et les exigences de l’EU AI Act.

- Trois à cinq data scientists : ils définissent les métriques de performance, testent les modèles, identifient les biais, et évaluent les cartes de modèle.

- Deux à trois responsables achats : ils gèrent la structure financière, les clauses de sortie, les délais, et les obligations contractuelles.

- Un représentant de la conformité : pour s’assurer que le contrat respecte les réglementations locales, nationales et internationales.

Le processus de négociation prend 6 à 9 mois. Il faut 120 à 160 heures de formation pour les équipes achats. Il n’y a pas de raccourci. Ce n’est pas un achat. C’est une transformation organisationnelle.

Les fournisseurs et les modèles du marché

Le marché est divisé en trois niveaux.

Les hyperscalers - AWS, Google Cloud, Microsoft Azure - contrôlent 58 % des contrats. Ils offrent des modèles standardisés, des outils de gestion, et des playbooks de 200 pages. Leur force ? La stabilité, la transparence, et l’intégration avec les systèmes existants. Leur faiblesse ? Des contrats rigides, peu négociables. Vous payez pour la sécurité, pas pour la flexibilité.

Les plateformes spécialisées - Icertis, Sirion AI - capturent 29 % du marché. Elles ne fournissent pas de modèle. Elles fournissent des outils pour gérer les contrats LLM. Elles intègrent des métriques de performance, des alertes de dérive, des contrôles de conformité. Leur force ? La personnalisation. Leur faiblesse ? Elles nécessitent une intégration complexe avec vos systèmes ERP, et prennent 3 à 6 mois à déployer.

Les startups - Procurable AI, Kanerika - représentent 13 % du marché. Elles ciblent des niches : gestion de contrats juridiques, analyse de documents médicaux, ou vérification de conformité. Leur force ? La précision. Elles combinent les LLM avec des petits modèles spécialisés (Small Data Models) pour des tâches précises. Leur faiblesse ? Le manque de ressources pour soutenir de grands clients.

Le meilleur choix dépend de votre besoin. Si vous avez besoin de stabilité et d’intégration, allez vers un hyperscalateur. Si vous avez besoin de flexibilité et de contrôle, choisissez une plateforme spécialisée. Si vous avez un besoin très spécifique, testez une startup.

Le futur : des contrats qui s’adaptent seuls

Le futur n’est pas dans les contrats statiques. Il est dans les contrats vivants.

Des experts prévoient que d’ici 2027, 81 % des contrats LLM seront auto-adaptatifs. Cela signifie que les termes changent automatiquement en fonction des performances du modèle. Si la précision tombe en dessous de 85 %, le contrat déclenche automatiquement une alerte, un ralentissement de service, ou une réduction de paiement. Si le modèle est mis à jour et que les tests de biais sont passés, le contrat augmente automatiquement la limite de usage.

Cela semble futuriste. Mais c’est déjà en cours. Des plateformes comme Sirion AI ont mis en place des « contrats intelligents » qui se connectent aux API de monitoring des modèles. Les données de performance alimentent directement les clauses contractuelles. C’est la fin du « contrat papier » et le début du « contrat vivant ».

Que faire maintenant ?

Si vous utilisez déjà un LLM, ou si vous envisagez de le faire, voici les 5 étapes immédiates à suivre.

- Identifiez tous les LLM en usage dans votre entreprise - même ceux utilisés par des équipes sans autorisation.

- Exigez de chaque fournisseur une carte de modèle complète : données d’entraînement, tests de biais, métriques de performance.

- Revoyez vos contrats actuels : vérifiez les clauses de responsabilité, de propriété des données, et de sortie.

- Formez votre équipe achats à la littératie IA : 40 heures minimum de formation sur les métriques de précision, rappel, F1, et dérive de modèle.

- Créez un comité de gouvernance IA avec juristes, data scientists et responsable conformité - et tenez des réunions trimestrielles pour réviser les contrats.

Les modèles de langage ne sont pas des outils. Ce sont des partenaires. Et comme tout bon partenaire, ils doivent être encadrés, surveillés, et tenus responsables. Sinon, vous risquez de payer le prix fort - en argent, en réputation, et en conformité.

Quels sont les éléments essentiels à inclure dans un contrat avec un fournisseur de LLM ?

Un contrat efficace avec un fournisseur de modèle de langage à grande échelle doit inclure : des SLA basés sur la précision et non sur l’uptime, des clauses claires sur la propriété des données et des sorties générées, une responsabilité échelonnée (jusqu’à 5 fois le montant annuel pour les dommages liés au biais), des exigences de transparence (cartes de modèle, évaluations de biais), un plan de sortie sécurisé avec récupération des données, et des mécanismes de mise à jour contrôlée (déploiement en canari). Ces éléments sont désormais exigés par l’OMB aux États-Unis et par l’EU AI Act en Europe.

Pourquoi les contrats traditionnels ne fonctionnent-ils pas avec les LLM ?

Les contrats traditionnels sont conçus pour des logiciels stables : ils mesurent la disponibilité, les correctifs, et les délais de support. Les LLM, eux, changent constamment, apprennent en temps réel, et produisent des contenus non prévisibles. Un contrat qui garantit 99,9 % d’uptime ne protège pas contre un modèle qui génère des réponses fausses, biaisées ou illégales. Les risques ne sont pas techniques - ils sont juridiques, éthiques et financiers. Les contrats classiques n’en tiennent pas compte.

Quelles sont les conséquences d’un contrat mal rédigé avec un fournisseur de LLM ?

Les conséquences peuvent être graves : sanctions réglementaires (amendes jusqu’à 4 % du chiffre d’affaires selon le RGPD), pertes financières (erreurs dans les rapports, litiges juridiques), dommages à la réputation (diffusion de désinformation), ou perte de confiance des clients. Une étude de Forrester montre que 58 % des entreprises ont eu au moins un échec majeur lors de leur premier contrat LLM, principalement à cause de clauses vagues sur la propriété des données ou l’absence de seuils de dérive.

Qui est responsable si un LLM génère une fausse information légale ?

La responsabilité est partagée, mais le contrat détermine qui paie. Si le contrat ne prévoit pas de responsabilité pour les sorties générées, l’entreprise cliente en assume la totalité. Les contrats modernes imposent une responsabilité partagée : le fournisseur est tenu pour responsable si la fausse information provient d’un biais connu non corrigé, d’une absence de mise à jour, ou d’un manque de transparence. L’entreprise est responsable si elle utilise le modèle hors de son usage prévu ou sans supervision humaine. Le contrat doit définir ces limites clairement.

Est-il possible de négocier un contrat avec un fournisseur comme OpenAI ou Anthropic ?

Oui, mais cela dépend de la taille de l’entreprise. Les grandes organisations peuvent négocier des clauses personnalisées, surtout pour les contrats annuels de plus de 500 000 $. OpenAI et Anthropic proposent désormais des cadres contractuels standardisés depuis fin 2024, avec des options pour la propriété des données, les seuils de performance, et les mécanismes de sortie. Les petites entreprises ont peu de pouvoir de négociation - elles acceptent souvent les termes par défaut. Il est donc crucial de bien lire les conditions générales avant de s’engager.