Imaginez un système d'intelligence artificielle qui recommande un traitement médical erroné ou rejette un prêt bancaire sur la base d'un préjugé invisible. Dans un environnement non régulé, c'est une erreur technique ; dans la santé ou la finance, c'est une catastrophe humaine et juridique. Le déploiement des Large Language Models (LLM) dans des secteurs critiques ne peut pas se contenter de quelques bonnes intentions. On parle ici de systèmes où une éthique IA mal gérée peut littéralement coûter des vies ou briser des carrières.

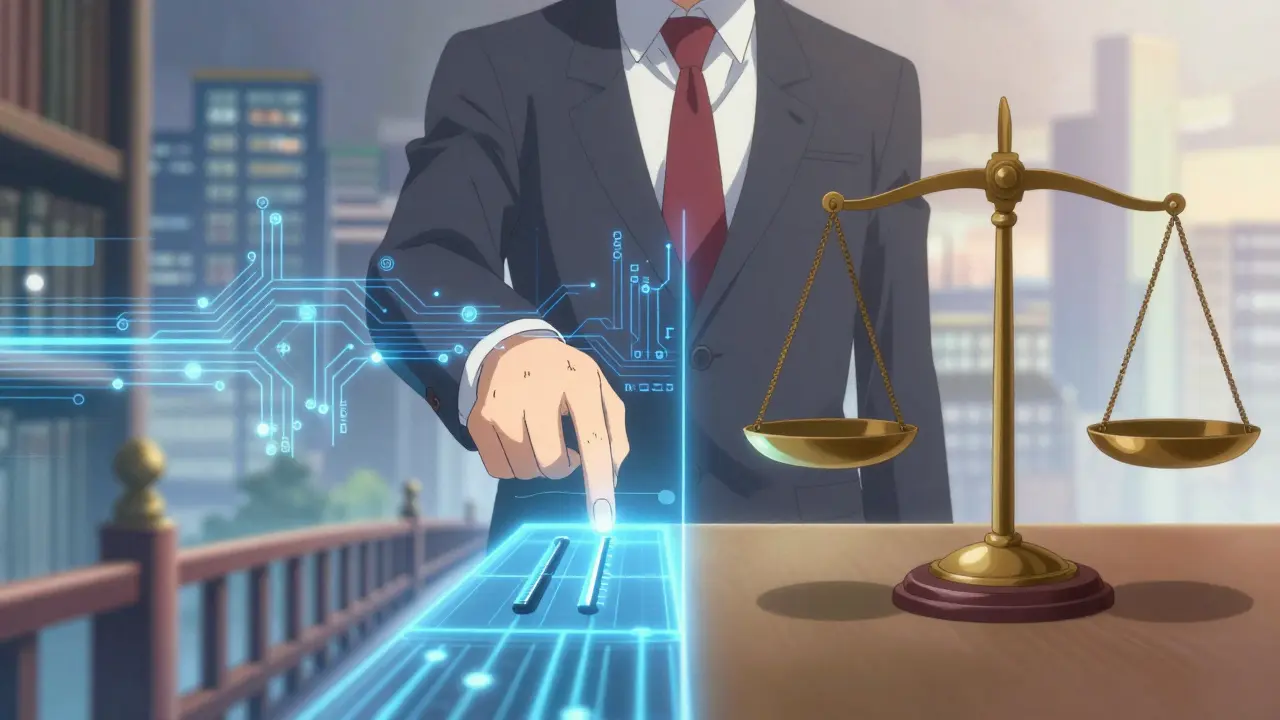

Le défi est immense car ces modèles, comme GPT-4, sont des « boîtes noires » complexes. Comment faire confiance à une machine quand on ne peut pas expliquer précisément pourquoi elle a pris telle décision ? Pour les entreprises opérant dans des secteurs régulés, l'enjeu n'est plus seulement la performance technique, mais la capacité à prouver que le modèle est juste, transparent et sécurisé. On ne demande plus si l'IA fonctionne, mais si elle est responsable.

Le risque réel : Pourquoi les règles générales ne suffisent plus

L'idée qu'une charte éthique globale suffirait pour tout type d'IA est un mythe. Un chatbot pour recommander des films n'a pas le même impact qu'un outil d'aide au diagnostic clinique. Dans les domaines régulés, les risques sont amplifiés par la complexité des modèles. Une analyse publiée dans Nature Communications a d'ailleurs souligné quatre caractéristiques critiques : le nombre massif de paramètres, la capacité d'adaptation en temps réel, l'impact sociétal profond et les risques majeurs pour la vie privée.

Dans le secteur de la santé, par exemple, l'Organisation mondiale de la santé (OMS) a dû instaurer des normes spécifiques dès janvier 2024. Pourquoi ? Parce que les erreurs de LLM peuvent mener à des diagnostics erronés. Le problème majeur reste l'attribution des responsabilités. Si un LLM induit un médecin en erreur, qui est responsable ? Le développeur du modèle, le fournisseur des données d'entraînement ou le praticien ? C'est ce vide juridique qui rend la mise en place de directives éthiques strictes indispensable.

Les piliers techniques d'un déploiement responsable

Pour passer de la théorie à la pratique, le déploiement doit s'appuyer sur des protocoles rigoureux. On ne peut pas simplement « lancer » un modèle et voir ce qui se passe. La première étape est la mise en place d'un système de détection des biais. Cela signifie tester le modèle sur des groupes démographiques variés pour s'assurer que les réponses ne varient pas injustement selon le genre ou l'origine.

Le Fine-tuning (ajustement précis) est une phase critique. Plutôt que de se fier à la performance globale, les équipes doivent utiliser des métriques précises comme le score F1 ou l'exactitude sur des tâches spécifiques. Selon les guides de Tonic.ai, un entraînement éthique demande un suivi transparent des sources de données et des ajustements effectués. Certes, cela rallonge le temps de documentation d'environ 25 %, mais c'est le seul moyen de réduire drastiquement les risques de non-conformité lors des audits.

Côté protection des données, le European Data Protection Board a proposé en 2025 une méthode en sept étapes pour aligner les LLM avec le RGPD. Cela implique des analyses d'impact sur la vie privée qui peuvent demander jusqu'à 120 heures de travail spécialisé pour un seul projet de santé. C'est un investissement lourd, mais nécessaire pour éviter des amendes record.

| Domaine | Priorité Éthique | Exigence Clé | Risque Majeur |

|---|---|---|---|

| Santé | Sécurité patiente | Explicabilité rapide (< 30s) | Hallucinations médicales |

| Justice | Équité et audit | Mécanismes de recours | Biais discriminatoires |

| Finance | Transparence | Traçabilité des décisions | Exclusion financière |

Gouvernance : Le rôle crucial des comités d'éthique

On ne peut pas laisser les ingénieurs décider seuls de ce qui est éthique. La création d'un comité d'éthique multidisciplinaire est devenue la norme. Ce groupe doit réunir des experts en technologie, des juristes, des spécialistes de la conformité et des experts métier (médecins, juges, banquiers). Gartner prévoit d'ailleurs que d'ici 2027, 85 % des entreprises dans les secteurs régulés auront un tel comité.

Le fonctionnement de ces comités ne doit pas être bureaucratique mais opérationnel. Cela implique des réunions mensuelles et une implication directe dans le cycle de développement. L'objectif est de briser les silos. Par exemple, un expert juridique peut identifier un risque de violation de copyright ou de protection des données là où un développeur ne verrait qu'une optimisation de performance. Cette collaboration réduit les incidents éthiques post-déploiement de près de 47 % selon certaines données de projets open-source.

Retours du terrain : Entre confiance et méfiance

Dans la réalité, l'adoption des LLM est contrastée. Une étude de 2025 a montré que 68 % des cliniciens se sentent plus confiants lorsque le LLM affiche un indicateur d'incertitude (ex: « Je ne suis sûr qu'à 60 % de cette réponse »). Cependant, 73 % s'inquiètent toujours du manque de clarté sur la responsabilité finale. On voit souvent sur des forums comme Reddit des témoignages de médecins ayant détecté des disparités de traitement touchant 12 % de leurs patientes à cause d'un biais de genre non corrigé dans le modèle.

C'est là que la documentation intervient. Les responsables de la conformité rapportent que si la documentation alourdit le lancement initial de 22 %, elle réduit les problèmes lors des audits de 63 %. Le gain de temps à long terme est donc évident : mieux vaut passer du temps en phase de conception que de subir un retrait de produit ou une sanction réglementaire.

Le paysage réglementaire : L'effet de l'AI Act

L'Europe mène la danse avec l' AI Act, finalisé en mars 2024. Ce texte classe la plupart des applications de LLM en santé comme « à haut risque ». Cela impose des évaluations de conformité strictes avant même la mise sur le marché. Aux États-Unis, l'approche est plus sectorielle, avec la FDA qui publie des guides spécifiques pour les logiciels médicaux basés sur l'IA.

Cette pression réglementaire crée un nouveau marché. Le secteur de la conformité éthique de l'IA, évalué à 1,2 milliard de dollars début 2025, devrait exploser pour atteindre 8,7 milliards d'ici 2028. Les entreprises qui investissent aujourd'hui dans des cadres éthiques mûrs voient leur confiance stakeholder augmenter de 33 % et subissent 58 % de sanctions en moins que leurs concurrents.

Vers une certification continue de l'éthique

L'avenir ne sera pas aux audits ponctuels. Parce que les LLM évoluent et s'adaptent en temps réel, l'éthique doit être monitorée en continu. On s'oriente vers des certifications dynamiques. La HIMSS a déjà commencé à piloter un programme de certification pour le déploiement éthique des LLM en santé.

Pour réussir ce virage, les équipes techniques doivent monter en compétence. Il ne suffit plus de savoir coder en Python ou d'utiliser PyTorch ; il faut comprendre les algorithmes de détection de biais et savoir traduire des contraintes juridiques complexes en spécifications techniques. C'est ce pont entre le code et la loi qui définira les gagnants de la prochaine décennie technologique.

Qu'est-ce qu'un LLM « à haut risque » selon l'AI Act ?

Un système est considéré comme à haut risque s'il est utilisé dans des domaines où une erreur peut gravement affecter la santé, la sécurité ou les droits fondamentaux des personnes. Cela inclut les diagnostics médicaux, le recrutement automatisé ou l'évaluation du crédit bancaire.

Comment détecter concrètement les biais dans un modèle ?

On utilise des jeux de données de test diversifiés et on compare les réponses du modèle pour des profils identiques où seule une variable (genre, origine, âge) change. Des outils de mesure comme le score F1 permettent d'évaluer si la performance chute pour certains groupes spécifiques.

L'explicabilité est-elle possible avec des modèles de milliards de paramètres ?

C'est le grand défi. On ne peut pas expliquer chaque neurone, mais on peut créer des « cadres d'explication » qui résument le raisonnement du modèle ou forcent l'IA à citer ses sources, permettant ainsi à un expert humain de valider la logique en quelques secondes.

Combien de temps faut-il pour mettre en place un comité d'éthique ?

En moyenne, il faut 6 à 8 semaines de coordination interdépartementale pour structurer le comité et définir ses pouvoirs. Une fois lancé, cela représente environ 12 à 15 heures de travail mensuel pour les cadres dirigeants.

Le RGPD est-il compatible avec l'entraînement des LLM ?

Oui, mais cela demande des efforts. Il faut mettre en œuvre des techniques de désidentification des données, garantir le droit à l'effacement et réaliser des analyses d'impact rigoureuses, comme le recommande le European Data Protection Board.