Pour bien comprendre, le GenMI fonctionne comme un traducteur universel entre le pixel et le mot. Contrairement aux anciens systèmes qui se contentaient de détecter un nodule, ces nouveaux modèles utilisent des architectures de transformeurs pour créer un récit cohérent. En pratique, cela signifie que l'IA analyse une radiographie du thorax, consulte les notes du médecin sur la fièvre du patient, et rédige : « On observe une opacité lobaire inférieure droite compatible avec une pneumonie, cohérente avec la présentation clinique ».

Comment ça marche techniquement ?

Sous le capot, ces systèmes s'appuient sur des architectures encodeur-décodeur massives, comptant souvent entre 1,2 et 2,4 milliards de paramètres. Le processus se divise généralement en deux voies : un Vision Transformer (ViT) qui traite l'image (souvent en résolution 512×512) et un encodeur de texte qui gère le contexte clinique.

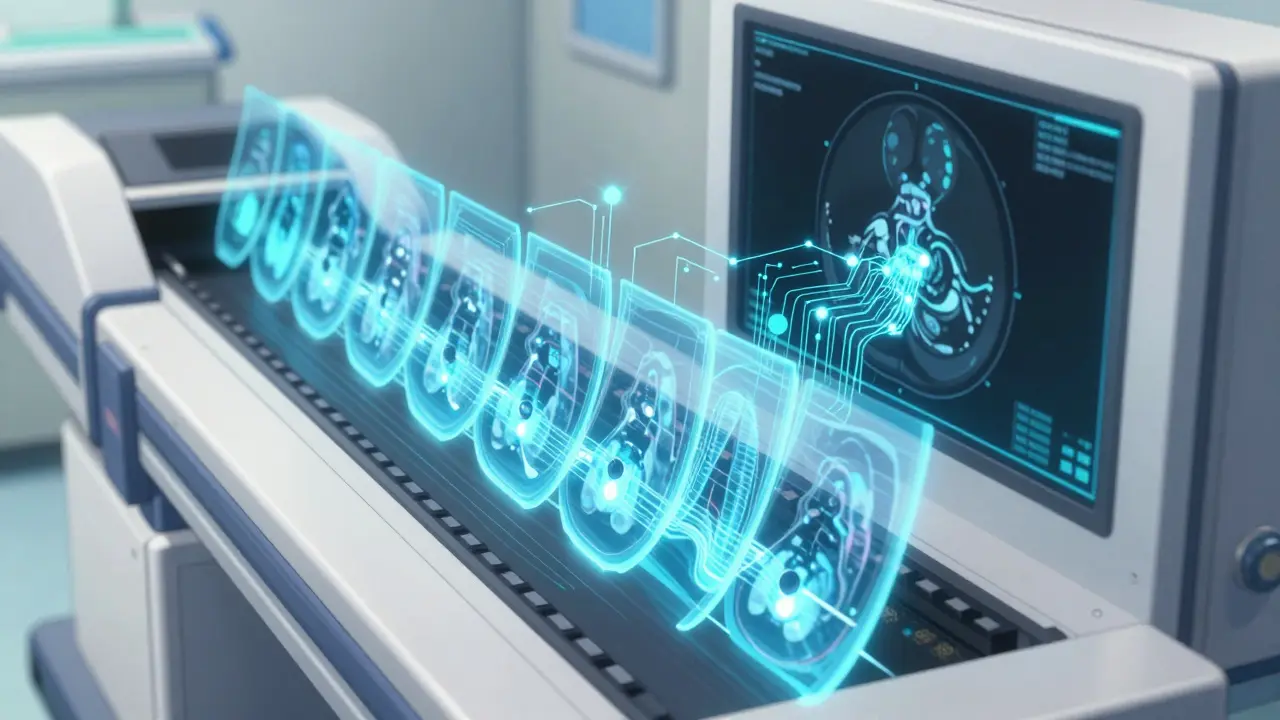

L'un des défis majeurs réside dans la gestion de la 3D. Comment analyser un scanner CT ou une IRM composé de 500 coupes ? Une approche innovante consiste à traiter ces images comme des séquences vidéo. En transformant un volume 3D en une vidéo de 15 à 25 images clés, les modèles peuvent mieux saisir la continuité anatomique. Les résultats sont probants : les modèles adaptés à la vidéo atteignent une précision de 89,3 % dans l'interprétation 3D, contre 82,7 % pour les modèles vision-langage classiques, même s'ils consomment environ 37 % de ressources informatiques supplémentaires.

Pour faire tourner ces monstres, il faut du lourd. On parle généralement de serveurs équipés de GPU NVIDIA A100 avec 80 Go de VRAM et des pipelines de prétraitement strictement conformes aux standards DICOM (Digital Imaging and Communications in Medicine), le langage universel de l'imagerie médicale.

Les solutions leaders sur le marché

Le paysage est actuellement dominé par trois géants : Microsoft, NVIDIA et Google Health AI, qui contrôlent près de 69 % du marché. Microsoft, avec son modèle CXRReportGen, s'est imposé en atteignant 94,7 % de précision dans l'identification des signes critiques pour les radios du thorax.

| Modèle | Précision (Signes Critiques) | Coût Estimé / An | Points Forts |

|---|---|---|---|

| CXRReportGen Premium (Microsoft) | 94,7 % | 185 000 $ | Haute précision, intégration écosystème |

| RadFM (Stanford / Open Source) | 83,5 % | 42 000 $ | Accessibilité, transparence |

| CLARA GenMI 2.0 (NVIDIA) | Variable | Sur devis | Guidage procédural en temps réel |

Gain de temps réel ou risque diagnostic ?

Le bénéfice le plus concret est la productivité. Une étude publiée dans le JAMA Network Open a montré que le temps de génération d'un rapport passait de 14,7 minutes à 8,2 minutes par étude. Pour un radiologue, c'est une réduction massive de la fatigue liée à la documentation. Cependant, tout n'est pas rose. Si l'IA excelle dans les cas de routine (92,4 % de précision pour des radios thoraciques simples), elle s'effondre dès que la complexité augmente. Pour le staging oncologique nécessitant de croiser un PET-scan, un CT et une IRM, la précision chute à 76,3 %.

Le danger principal reste les « zones d'ombre ». Certains modèles échouent à détecter des détails subtils, comme des nodules pulmonaires de moins de 5 mm, ou peinent à corréler des évolutions sur plusieurs examens chronologiques. C'est pourquoi le paradigme « l'humain dans la boucle » est indispensable. Lorsqu'un radiologue corrige le brouillon de l'IA, le taux d'erreur critique tombe de 4,7 % à seulement 0,9 %.

Les défis de l'implémentation en milieu hospitalier

Installer un système de GenMI n'est pas comme installer un nouveau logiciel de bureau. C'est un chantier infrastructurel qui prend en moyenne 6 mois. Les principaux points de friction sont :

- L'interopérabilité : Connecter l'IA au dossier patient informatisé via les interfaces HL7/FHIR ajoute souvent deux mois de travail technique.

- La courbe d'apprentissage : Un radiologue a besoin de 8 à 12 semaines d'utilisation supervisée pour devenir réellement efficace avec l'outil.

- Le biais des données : C'est le point noir. Seulement 32,7 % de la diversité mondiale de la population est représentée dans les jeux de données d'entraînement, ce qui peut mener à des erreurs de diagnostic sur certaines populations.

L'avenir : vers une imagerie interactive

D'ici 2027, on prévoit que plus de 73 % des systèmes intégreront nativement les dossiers médicaux électroniques pour un contexte encore plus riche. Microsoft teste déjà des rapports interactifs où le patient peut cliquer sur une conclusion textuelle pour voir instantanément la zone précise de l'image concernée. On s'oriente vers une médecine où l'image ne sera plus un document statique, mais une base de connaissances dynamique.

L'IA va-t-elle remplacer les radiologues ?

Non. Le consensus actuel, soutenu par des experts comme le Dr Curtis Langlotz de Stanford, est que l'IA est un assistant de rédaction et de détection. L'incapacité des modèles à gérer les cas complexes et les maladies rares rend la supervision humaine indispensable pour garantir la sécurité du patient.

Quelle est la différence entre un modèle Vision-Language et un modèle adapté à la vidéo ?

Un modèle Vision-Language traite généralement des images 2D isolées. Un modèle adapté à la vidéo traite les coupes d'un scanner 3D comme des images séquentielles (frames), ce qui permet une bien meilleure analyse spatiale et volumétrique des organes.

Le GenMI est-il réglementé par la FDA ?

Oui, la FDA a publié des directives spécifiques en août 2025 (Guidance #2025-087). Elles imposent une sensibilité de 95 % pour les signes critiques et une validation prospective sur plus de 10 000 études avant toute mise sur le marché.

Quels sont les risques juridiques liés à l'utilisation de l'IA ?

La responsabilité diagnostique reste un sujet brûlant. Actuellement, 78 % des assureurs en responsabilité civile médicale exigent que les institutions ajoutent des clauses de non-responsabilité précisant que le rapport a été généré avec l'aide de l'IA mais validé par un médecin.

Combien coûte l'implémentation d'un système comme CXRReportGen ?

Le coût logiciel peut atteindre 185 000 $ par an pour les versions premium, mais il faut ajouter les coûts d'infrastructure (GPU NVIDIA A100) et le temps humain pour l'intégration DICOM et HL7, mobilisant souvent 3 à 5 ingénieurs pendant plusieurs mois.