Imaginez un tuteur privé disponible 24h/24 pour chaque élève de votre classe. Pas un humain épuisé par la correction de copies, mais une intelligence artificielle capable d'adapter instantanément ses explications au style d'apprentissage unique de l'élève. C'est exactement ce que promettent les Modèles de Langage de Grande Taille (LLM) dans le secteur de l'éducation. En 2026, cette technologie n'est plus une simple curiosité technologique ; elle est devenue une infrastructure standard pour environ 42 % des écoles américaines K-12, selon le rapport du Département de l'Éducation des États-Unis publié en octobre 2025.

Pourtant, derrière cette adoption rapide se cache une réalité complexe. Les LLM ne sont pas des oracles infaillibles. Ils commettent des erreurs, manquent d'intelligence émotionnelle et posent des questions éthiques cruciales sur la vie privée des données étudiantes. Comment les enseignants peuvent-ils exploiter ces outils puissants sans sacrifier la qualité pédagogique ni la sécurité des élèves ? Voici comment naviguer dans cet paysage en mutation rapide.

Le problème fondamental : L'impossibilité de la différenciation humaine à grande échelle

Dans une salle de classe traditionnelle, un enseignant fait face à un dilemme mathématique impossible : comment fournir une instruction différenciée à 30 élèves aux niveaux de compétence variés avec seulement une heure de cours ? La réponse historique a souvent été « personne » ou « tout le monde suit le même rythme ». C'est là que les LLM changent la donne.

Ces systèmes d'intelligence artificielle, entraînés sur des ensembles de données textuelles massifs, analysent les interactions des étudiants en temps réel. Ils identifient les lacunes de connaissances et adaptent la livraison du contenu pour correspondre au niveau de maîtrise et aux intérêts individuels. Prenons l'exemple frappant du professeur Thomas Thesen de l'École de médecine Geisel de Dartmouth. Dans son étude publiée en novembre 2025 dans le Journal of Medical Education, il a démontré qu'un système de tutorat alimenté par LLM pouvait fournir un soutien individualisé simultané à 190 étudiants en médecine suivant un cours de neurosciences. Une tâche physiquement impossible pour un être humain, mais réalisable grâce à l'évolutivité de l'IA.

La proposition de valeur centrale réside dans la résolution de la contrainte de charge de travail des enseignants. Les modèles comme NeuroBot TA utilisent une architecture appelée génération augmentée par récupération (RAG). Cette technique réduit considérablement les taux d'hallucination - ces réponses inventées mais plausibles - passant de 91 % lors de la synthèse de littérature scientifique à environ 12-18 %, selon l'étude de Dartmouth. Pour les enseignants, cela signifie moins de temps passé à vérifier les faits et plus de temps consacré à l'interaction humaine significative.

Performances techniques et limites critiques des LLM éducatifs

Toute discussion sur les LLM doit commencer par leurs spécifications techniques et, surtout, leurs limites. Ces modèles contiennent généralement entre 7 milliards et plus de 100 milliards de paramètres. Cependant, la taille ne garantit pas la précision dans tous les contextes éducatifs.

L'analyse de Katie Ellis datant du 6 janvier 2026 sur SchoolAI.com révèle des écarts significatifs dans les performances. Pour la mémorisation factuelle dans des sujets bien définis, la précision varie entre 85 % et 95 %. Mais dès qu'il s'agit de résolution de problèmes complexes, cette précision chute à 62-78 %. Les taux d'erreur s'étendent de 5 % pour des exercices de vocabulaire de base à 79 % pour les problèmes avancés de mathématiques.

| Type de Tâche | Précision / Efficacité | Taux d'Erreur Estimé | Nécessite Vérification Humaine ? |

|---|---|---|---|

| Vocabulaire de base | Très élevé | ~5% | Non (supervision légère) |

| Rappel factuel (Histoire/Géo) | Élevé (85-95%) | 5-15% | Oui (ponctuelle) |

| Résolution de problèmes complexes | Moyen (62-78%) | 22-38% | Oui (systématique) |

| Mathématiques avancées | Faible à Moyen | Jusqu'à 79% | Oui (obligatoire) |

| Soutien émotionnel | Très Faible (43% détection frustration) | N/A | Oui (humain requis) |

Il est crucial de comprendre que les LLM prédisent des schémas de texte ; ils ne « comprennent » pas le sens profond comme un humain. Comme le souligne Katie Ellis : « Les grands modèles de langage prédisent des schémas de texte à partir d'ensembles de données massifs, mais manquent de compréhension appropriée, rendant la supervision humaine essentielle. » Cette distinction est vitale pour éviter la désinformation académique.

L'avantage concurrentiel : Évolutivité contre Intelligence Émotionnelle

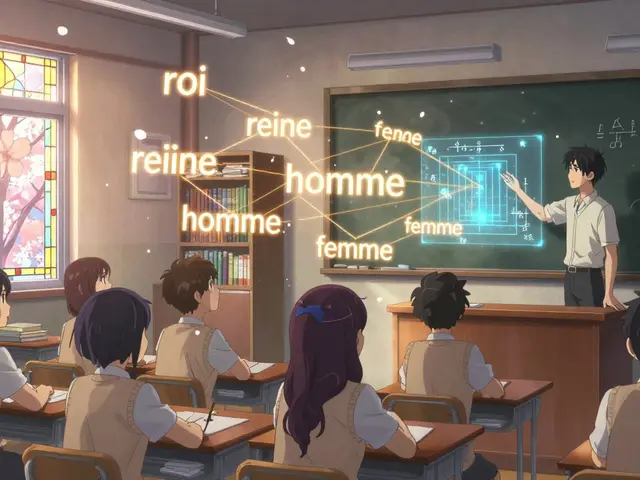

Si vous comparez les systèmes de tutorat basés sur les LLM aux méthodes traditionnelles, un contraste net apparaît. Les plateformes d'apprentissage adaptatif classiques, telles que DreamBox ou Khan Academy, offrent des chemins structurés mais manquent de flexibilité conversationnelle. Le tutorat humain offre un soutien émotionnel supérieur mais ne peut pas évoluer pour couvrir des groupes de la taille d'une classe.

Les LLM occupent une niche unique : ils fournissent un feedback immédiat et individualisé, 24 heures sur 24, à un coût marginal quasi nul par étudiant. Selon une étude de la Fondation Gates citée par Sapien.io en novembre 2025, les étudiants dans des environnements d'apprentissage personnalisé alimentés par LLM sont 1,5 fois plus susceptibles d'être engagés et motivés. Dans les salles de classe surpeuplées, les outils IA peuvent augmenter l'accès à l'instruction individualisée de 300 %.

Cependant, ils échouent lamentablement dans les domaines nécessitant une expérimentation pratique ou un apprentissage socio-émotionnel complexe. Une enquête arXiv d'avril 2024 a montré que les simulations de laboratoire de chimie via IA atteignaient seulement 68 % de précision, contre 92 % pour les démonstrations en personne. De plus, une étude de janvier 2026 dans le Journal of Educational Psychology a révélé que les tuteurs humains identifiaient correctement la frustration des étudiants 89 % du temps, contre seulement 43 % pour les systèmes basés sur les LLM.

Sécurité, Vie Privée et Conformité Réglementaire

L'adoption des LLM dans l'éducation soulève des inquiétudes majeures concernant la vie privée des données étudiantes. Les exigences système incluent généralement des navigateurs web standards, mais les implémentations d'entreprise nécessitent une infrastructure cloud sécurisée conforme aux réglementations FERPA et COPPA.

Au quatrième trimestre 2025, 87 % des plateformes d'IA éducative supportaient les API de systèmes de gestion de l'apprentissage (LMS) populaires comme Canvas, Google Classroom et Schoology, selon le Rapport d'Intégration EdTech. Des plateformes comme SchoolAI mettent en œuvre un chiffrement de bout en bout et des pratiques strictes d'anonymisation des données pour se conformer aux Normes Nationales de Protection des Données Éducatives de 2024.

Le risque algorithmique reste préoccupant. Dr Susan Chen, chercheuse en éthique de l'IA au MIT, a averti dans son article de décembre 2025 pour EduTech Review que « le biais dans les données d'entraînement peut désavantager les apprenants diversifiés ». Elle a noté que les LLM montraient une précision inférieure de 23 % pour les locuteurs non natifs de l'anglais dans les scénarios de tests standardisés. Avec 76 % des chercheurs citant le biais algorithmique comme une préoccupation majeure, la vérification continue des plateformes est indispensable.

Retour d'expérience Utilisateur : Enseignants vs Étudiants

Les retours terrain montrent un soutien fort parmi les éducateurs, mais des expériences mitigées chez les étudiants. Selon l'enquête Gallup-Walton Foundation de septembre 2025, 65 % des enseignants spécialisés estiment que l'IA rend les matériaux plus accessibles pour les étudiants handicapés. Un enseignant de 8e année des écoles publiques de Denver a partagé sur Reddit en janvier 2026 : « La fonction de simplification de texte de SchoolAI a permis à mes élèves dyslexiques de s'engager avec du contenu de niveau scolaire pour la première fois - ce n'est pas juste utile, c'est transformateur. »

Cependant, les étudiants rapportent de la frustration face aux limitations de l'IA. Un étudiant en médecine utilisant NeuroBot TA à Dartmouth a témoigné : « Quand j'ai posé des questions sur des conditions neurologiques rares, il a fourni des informations incorrectes mais plausibles qui ont gaspillé mon temps d'étude. » Sur G2 Crowd, SchoolAI maintient une note de 4,2/5 basée sur 317 avis vérifiés d'enseignants en janvier 2026. Si 78 % louent ses capacités d'économie de temps, 63 % notent la nécessité absolue de vérifier tout contenu généré par l'IA.

Guide de Mise en Œuvre : Stratégies pour les Enseignants

Une mise en œuvre réussie nécessite une planification minutieuse et une formation des enseignants. SchoolAI, gratuit pour les enseignants depuis janvier 2026, nécessite typiquement 3 à 5 heures d'intégration initiale. Les défis courants incluent la gestion de la dépendance excessive des étudiants à l'IA (signalée par 71 % des enseignants) et l'adressage du contenu halluciné.

Katie Ellis recommande une approche en trois phases :

- Phase Administrative : Utilisez l'IA pour les tâches administratives comme la rédaction de communications parents-école. Cela permet d'économiser 2 à 3 heures par semaine par enseignant, selon les données Gallup.

- Différenciation du Contenu : Adaptez les supports pédagogiques aux différents besoins des élèves avant le cours.

- Tutorat Temps Réel : Intégrez progressivement le tutorat interactif pendant les séances d'apprentissage, toujours sous supervision.

Les compétences requises incluent la littératie numérique, l'évaluation critique des sorties IA et une compréhension de base de l'ingénierie d'invite (prompt engineering). Actuellement, 28 États américains exigent des modules de développement professionnel de 12 heures pour la certification des outils IA.

Perspectives de Marché et Futur de l'IA Éducative

Le marché mondial de l'IA dans l'éducation a atteint 12,8 milliards de dollars en 2025, avec un taux de croissance annuel composé de 26,3 % (Rapport IDC Technology, décembre 2025), projeté pour atteindre 41,7 milliards de dollars d'ici 2028. L'adoption est la plus élevée dans l'enseignement supérieur (68 % des institutions) et l'éducation spécialisée (61 %).

Le paysage concurrentiel comprend des plateformes dédiées comme SchoolAI et Khanmigo, des fonctionnalités intégrées aux LMS (Canvas Studio), et des modèles généralistes adaptés à l'éducation comme Claude for Education d'Anthropic. Le contexte réglementaire s'est intensifié suite à la Loi Fédérale sur l'IA dans l'Éducation de 2024, exigeant que toute IA面向学生 subisse des audits de biais et maintienne des pratiques de données transparentes.

Les développements futurs pointent vers des systèmes de tutorat plus sophistiqués et conscients du contexte. Thesen et Park suggèrent que les chatbots devraient « guider les étudiants vers la découverte de solutions par des questions ciblées » plutôt que de donner des réponses directes. Les priorités de recherche incluent l'intégration multimodale (texte, visuel, audio), la modélisation étudiante à long terme et le tutorat conscient des émotions.

Quels sont les principaux risques d'utiliser les LLM dans l'éducation ?

Les risques majeurs incluent les hallucinations (informations fausses présentées comme vraies), les biais algorithmiques qui désavantagent certains groupes d'élèves, et les problèmes de confidentialité des données. Une étude arXiv de 2024 a identifié 14 catégories de risques, la vie privée des données étant citée par 89 % des chercheurs comme la principale préoccupation.

Les LLM peuvent-ils remplacer complètement les enseignants ?

Non. Bien que les LLM excellent dans l'évolutivité et la différenciation du contenu, ils manquent d'intelligence émotionnelle. Ils identifient la frustration des étudiants seulement 43 % du temps, comparé à 89 % pour les humains. Les enseignants restent indispensables pour le soutien socio-émotionnel, la pensée critique et la supervision des outputs de l'IA.

Comment vérifier la fiabilité des réponses générées par un LLM éducatif ?

Selon les directives de SchoolAI, 100 % des contenus générés par l'IA doivent être vérifiés. Les enseignants doivent croiser les informations avec des sources primaires, utiliser des modèles avec architecture RAG (comme NeuroBot TA) qui réduisent les hallucinations, et former les étudiants à l'esprit critique envers les outputs numériques.

Quelles plateformes LLM sont recommandées pour l'éducation en 2026 ?

Les plateformes leaders incluent SchoolAI (gratuit pour les enseignants, fort soutien pour l'éducation spécialisée), NeuroBot TA (spécialisé en sciences médicales avec architecture RAG), et Khanmigo. Pour l'intégration LMS, Canvas Studio et les adaptations éducatives d'Anthropic's Claude sont également des options solides.

Comment les LLM aident-ils les élèves en situation de handicap ?

Les LLM permettent une différenciation massive. Par exemple, SchoolAI offre des fonctions de simplification de texte qui aident les élèves dyslexiques à accéder au contenu de leur niveau scolaire. Selon le sondage Walton-Gallup, 82 % des enseignants spécialisés rapportent que les outils IA les aident à fournir plusieurs formats de représentation conformément aux principes de Conception Universelle de l'Apprentissage (UDL).