Vous avez déjà demandé à un modèle de langage une information factuelle simple pour recevoir une réponse confiante mais totalement inventée ? Ce phénomène, connu sous le nom d'hallucination, reste l'obstacle numéro un à l'adoption massive de l'intelligence artificelle dans les secteurs critiques. En mai 2026, nous ne cherchons plus seulement à rendre les modèles plus « intelligents », mais à les rendre fiables. C'est ici qu'intervient le prompting contraste, une technique d'inférence qui permet de filtrer les erreurs en temps réel, sans nécessiter de coûteux entraînements supplémentaires.

L'idée est simple mais puissante : au lieu de demander au modèle de générer une réponse unique, on lui demande de comparer plusieurs représentations ou couches de raisonnement. Si une partie de la sortie semble incertaine ou contradictoire par rapport aux autres, elle est rejetée. Résultat ? Des réponses bien plus ancrées dans la réalité, avec une réduction des hallucinations allant jusqu'à 37 % selon certaines analyses récentes.

Pourquoi le Prompting Contraste Change la Donne

Jusqu'en 2023, réduire les hallucinations signifiait souvent retrainer le modèle sur des données spécifiques (comme avec RLHF) ou utiliser des pipelines complexes de vérification post-génération. Ces méthodes sont lourdes, chères et peu adaptées aux mises à jour rapides. Le prompting contraste opère différemment. Il agit directement lors de la génération, au moment où chaque token est choisi.

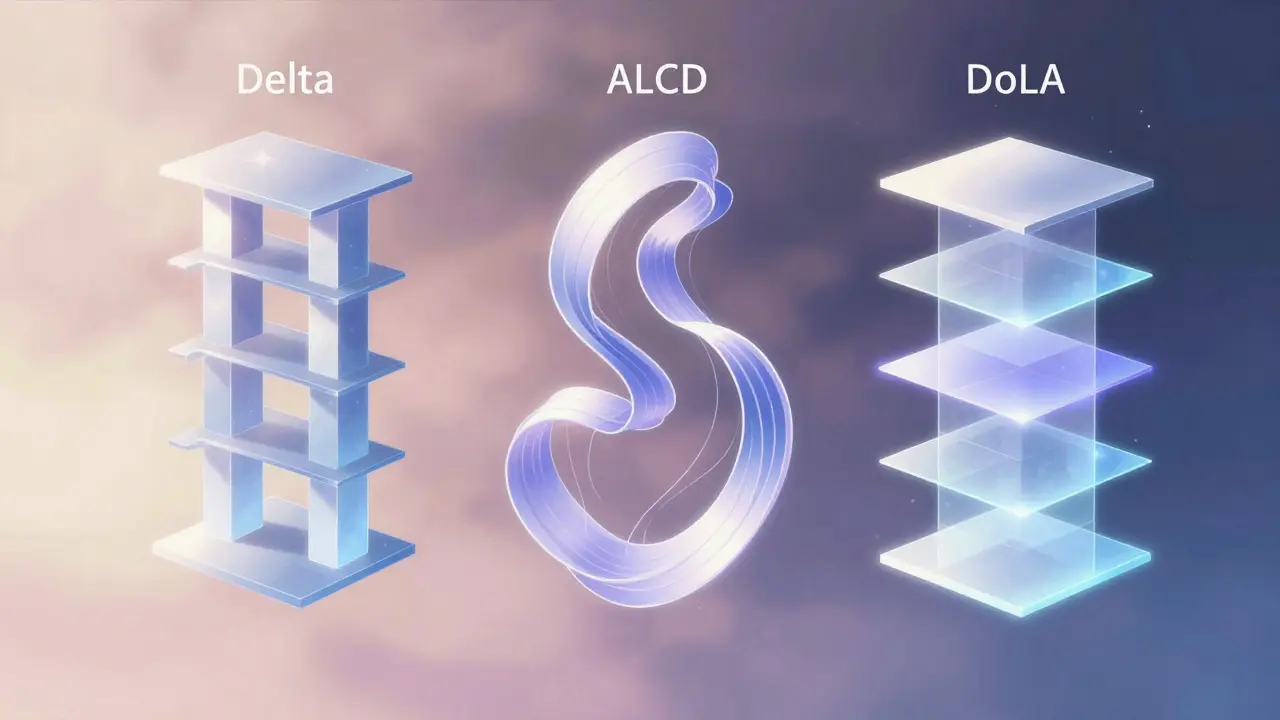

Delta, le premier cadre formel proposé en 2023, a montré que l'on pouvait obtenir des résultats significatifs simplement en comparant deux sorties parallèles : l'une issue du prompt original, l'autre d'une version modifiée. Le système sélectionne ensuite les tokens ayant une probabilité plus élevée dans la sortie originale. Pas besoin de toucher aux poids du modèle. Pas besoin de nouveaux datasets. Juste une astuce mathématique appliquée aux logits.

Cette approche s'inscrit dans une tendance plus large vers le contrôle de la factualité en inférence. Contrairement aux méthodes d'entraînement qui modifient le comportement global du modèle, le prompting contraste offre un levier précis et ajustable. Vous pouvez augmenter ou diminuer la « force » du contraste selon votre tolérance au risque. Pour une application médicale, vous pousserez le contraste à fond. Pour un assistant créatif, vous le laisserez plus souple.

Les Mécanismes Techniques : Delta, ALCD et DoLA

Le prompting contraste n'est pas une méthode unique, mais une famille de techniques. Chacune exploite un niveau différent de l'architecture du modèle pour détecter les incohérences.

| Méthode | Principe Clé | Réduction des Hallucinations | Surcharge Latence |

|---|---|---|---|

| Delta | Décodage contrastif entre prompts originaux et modifiés | 23-37 % | 15-22 % |

| ALCD | Contraintes adaptatives dynamiques sur les tokens contrastifs | 28.4 % vs décodage glouton | Variable (ajustement paramétrique) |

| DoLA | Comparaison des log-probabilités entre couche finale et intermédiaire | 18.7 % vs décodage glouton | Négligeable |

ALCD (Alternate Layer-wise Contrastive Decoding), mis à jour en octobre 2024 par l'université Tsinghua, introduit une contrainte adaptive. Au lieu d'appliquer un seuil fixe, le modèle ajuste dynamiquement l'échelle des tokens contrastifs pendant la génération. Cela a été particulièrement efficace dans six tâches médicales diverses, notamment l'extraction de relations conceptuelles et la détection d'événements indésirables liés aux médicaments. Les tests sur Llama-2-7b et Vicuna-7b ont confirmé sa supériorité face au beam search classique.

De son côté, DoLA (Depth of Language Analysis), documenté par Vectara en 2024, prend une autre route. Il compare les log-probabilités de la dernière couche du modèle avec celles d'une couche intermédiaire (souvent la couche 20 sur un modèle de 32 couches). L'idée est que les couches intermédiaires capturent mieux les connaissances factuelles brutes, tandis que les couches finales peuvent être influencées par des biais stylistiques ou contextuels. En favorisant les tokens dont la probabilité augmente entre ces deux niveaux, DoLA met en lumière les informations réellement informées.

Quand Utiliser le Prompting Contraste ?

Toutes les applications ne bénéficient pas equally du prompting contraste. Cette technique excelle dans les scénarios structurés où la précision factuelle est primordiale. Pensez aux assistants juridiques, aux outils d'aide au diagnostic médical, ou aux systèmes financiers automatisés. Dans ces domaines, une erreur peut avoir des conséquences graves. Le prompting contraste agit comme un filet de sécurité.

En revanche, il se montre moins pertinent pour l'écriture créative, la poésie ou la génération de scénarios fictifs. Ici, une certaine dose d'invention est non seulement acceptable, mais souhaitable. Appliquer un fort contraste risquerait de produire des textes secs, répétitifs ou manquant d'imagination. Comme le note Dr. Marcus Johnson du MIT, les méthodes contrastives peuvent parfois rendre les modèles trop conservateurs, omettant des informations pertinentes par peur de se tromper.

Une règle empirique utile : si votre métrique principale est la fidélité aux faits (fact-checking score, exactitude des citations), optez pour le prompting contraste. Si votre métrique est la fluidité narrative ou l'originalité, privilégiez d'autres approches comme le Chain of Thoughts ou le Tree of Thoughts.

Intégration Pratique et Défis de Mise en Œuvre

La bonne nouvelle ? Le prompting contraste s'intègre facilement dans les pipelines existants. Vous n'avez pas besoin de modifier l'architecture de votre modèle ni de reconstruire vos bases de données RAG (Retrieval-Augmented Generation). La plupart des implémentations ajoutent seulement 15 à 22 % de latence, ce qui reste acceptable pour la majorité des applications professionnelles.

Cependant, le réglage fin des paramètres demande de l'expertise. Trouver le bon seuil de contraste est un exercice d'équilibre. Trop faible, et les hallucinations persistent. Trop fort, et la cohérence des réponses chute de 18 à 22 %, selon les mesures automatiques. Les équipes Datadog ont rapporté que leurs ingénieurs ont nécessité en moyenne 11,3 heures pour intégrer correctement le prompting contraste avec leur framework LLM-as-a-judge, principalement pour configurer les questions de vérification et les seuils de confiance.

Voici quelques étapes clés pour une intégration réussie :

- Commencez par identifier les types d'erreurs les plus critiques dans votre domaine (ex: dates incorrectes, noms propres inventés).

- Choisissez la méthode adaptée : Delta pour une mise en œuvre rapide, ALCD pour des tâches spécialisées, DoLA pour une analyse fine des couches.

- Testez progressivement les seuils de contraste sur un ensemble de validation annoté.

- Combinez avec d'autres techniques de vérification, comme le CoVe (Chain of Verification) de Galileo AI, pour une réduction cumulée des hallucinations pouvant atteindre 42,7 %.

Limites et Perspectives Futures

Même s'il est prometteur, le prompting contraste n'est pas une solution magique. Il réduit les hallucinations, mais ne les élimine pas entièrement. Selon Dr. Lisa Torres de l'AI Ethics Institute, une dépendance excessive à ces méthodes peut créer un faux sentiment de sécurité. Les utilisateurs pourraient croire que les sorties sont infaillibles, alors qu'elles restent sujettes à des biais résiduels.

Par ailleurs, les performances varient selon le contexte. Dans des environnements chaotiques avec des données irrélèventes récupérées, des méthodes comme ThoT (Tree of Thoughts) ou CoN (Chain of Notes) surpassent le prompting contraste de 12 à 15 %. Ces approches structurent explicitement le raisonnement avant la génération, offrant une robustesse supplémentaire là où le contraste seul peine.

Les développements récents pointent vers des hybridations intelligentes. Meta AI a lancé Visual Contrastive Decoding (VCD) en octobre 2025 pour adresser les hallucinations visuelles dans les modèles multimodaux, améliorant les performances de 31,2 %. Google DeepMind prévoit d'intégrer le prompting contraste multi-modèle dans Gemini dès le deuxième trimestre 2026, visant une réduction supplémentaire de 15 à 20 % des erreurs.

Gartner prédit que d'ici 2027, 78 % des déploiements enterprise de LLM incluront某种形式 de décodage contrastif. Avec l'entrée en vigueur des nouvelles exigences de l'UE AI Act en décembre 2025, exigeant des « mesures techniques appropriées » pour atténuer les hallucinations dans les systèmes à haut risque, cette adoption devrait accélérer.

Est-ce que le prompting contraste remplace le besoin de retrenement des modèles ?

Non, il ne le remplace pas entièrement, mais il offre une alternative beaucoup plus légère pour contrôler les hallucinations en temps réel. Le retrenement reste nécessaire pour aligner profondément le modèle sur des valeurs éthiques ou des connaissances très spécifiques. Le prompting contraste agit comme un filtre dynamique en inférence, complémentaire aux efforts d'entraînement.

Quelle méthode choisir entre Delta, ALCD et DoLA ?

Choisissez Delta pour une intégration rapide et générale. Optez pour ALCD si vous travaillez dans un domaine spécialisé comme la médecine, où l'adaptation dynamique des contraintes est cruciale. Utilisez DoLA si vous souhaitez analyser finement les contributions des différentes couches du modèle sans ajouter de latence significative.

Le prompting contraste fonctionne-t-il avec tous les grands modèles de langage ?

Oui, la plupart des architectures transformer modernes (comme Llama, Mistral, Qwen) supportent ces techniques car elles exposent les logits et les probabilités par couche. Cependant, l'efficacité varie selon la taille et l'architecture spécifique du modèle. Les tests sur Llama-2-7b et Vicuna-7b ont montré des résultats solides, mais des modèles plus petits peuvent manquer de profondeur pour exploiter pleinement DoLA.

Combien de latence ajoute le prompting contraste ?

En moyenne, entre 15 et 22 % de latence supplémentaire par rapport à la génération standard. Pour des applications temps réel exigeantes (moins de 300 ms), cela peut être prohibitif. Dans ce cas, envisagez des optimisations matérielles ou des versions quantifiées du modèle pour compenser.

Comment combiner le prompting contraste avec RAG ?

Le prompting contraste s'intègre naturellement après l'étape de récupération dans un pipeline RAG. Une fois que le contexte pertinent est injecté dans le prompt, le mécanisme contrastif aide le modèle à privilégier les tokens soutenus par ce contexte plutôt que ceux issus de ses connaissances internes potentiellement obsolètes. C'est une combinaison gagnante pour maximiser la factualité.