Le versioning LLM est une pratique systématique consistant à suivre et gérer les différentes itérations des modèles de machine learning et de leurs poids, tout en conservant la capacité de revenir instantanément à une version précédente. Contrairement au versioning logiciel classique avec Git, gérer des modèles d'IA demande de synchroniser des artefacts lourds avec le code qui les a générés.

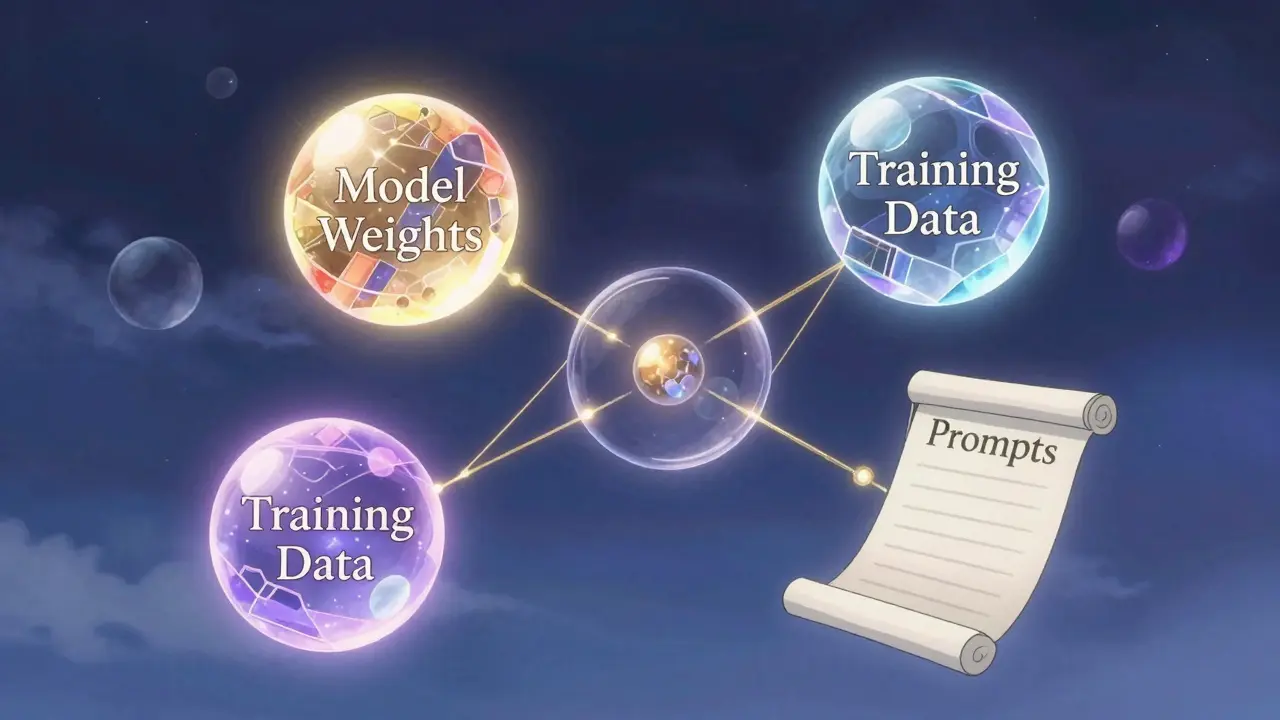

Ce qu'il faut réellement versionner pour un LLM

Si vous vous contentez de sauvegarder le fichier final du modèle, vous faites une erreur critique. Pour garantir une reproductibilité totale et un rollback efficace, vous devez traiter plusieurs entités comme un tout indissociable.

- Les poids du modèle : Ce sont les artefacts sérialisés. C'est le « cerveau » du modèle. Sans versioning précis des poids, impossible de comparer deux performances.

- Le code d'entraînement et la configuration : Le script Python et les fichiers YAML. Vous devez pouvoir relancer exactement le même entraînement pour obtenir le même résultat.

- Les snapshots de données : Le Dataset est l'ensemble des données utilisées pour l'entraînement ou le fine-tuning. Un changement mineur dans vos données d'entraînement peut modifier radicalement le comportement du modèle (le fameux "data drift").

- Les hyperparamètres : Le taux d'apprentissage (learning rate), la taille des batchs ou l'architecture. Un changement de 0,001 dans un paramètre peut être la différence entre un succès et un crash.

- L'environnement technique : Les versions de PyTorch ou TensorFlow, ainsi que les spécifications du GPU. Une mise à jour de bibliothèque peut rendre un ancien poids incompatible.

- Les prompts et templates : Dans le monde des LLM, le prompt fait partie du modèle. Si vous changez le template de prompt sans versionner, vos tests de performance deviennent inutiles.

Distinction entre versions, artefacts et modèles enregistrés

En MLOps, on mélange souvent les termes. Pour éviter toute confusion lors d'un rollback, il faut distinguer trois niveaux de granularité :

| Concept | Définition | Exemple concret |

|---|---|---|

| Version du modèle | Un instantané unique après un cycle d'entraînement. | Poids après le fold 3 d'une validation croisée. |

| Artefact de modèle | Une séquence de versions logguées. | Tous les checkpoints sauvegardés toutes les 100 étapes. |

| Modèle enregistré | Une sélection de versions validées pour la production. | Le candidat "v2.1-stable" prêt pour le déploiement. |

Stratégies de Rollback : Comment revenir en arrière sans tout casser

Un rollback n'est pas juste un bouton "Undo". C'est une opération qui doit être automatisée pour réduire le temps d'indisponibilité. L'idée est de basculer le trafic d'une version problématique vers une version connue comme stable.

La méthode la plus efficace consiste à utiliser un Model Registry. Au lieu que votre application pointe vers un fichier spécifique (ex: model_v2.bin), elle pointe vers un alias (ex: model-production). En cas de problème, vous changez simplement l'alias pour qu'il pointe vers model_v1.bin. Le changement est quasi instantané et ne nécessite pas de redéployer tout le code.

C'est ici que des outils comme Weights & Biases (W&B) est une plateforme de MLOps permettant de suivre les expériences, de versionner les artefacts et de gérer le lignage des données deviennent indispensables. Ils permettent de voir d'un coup d'œil quel dataset a produit quel poids, et quelle métrique de performance était associée.

Automatisation via CI/CD et DVC

Gérer des fichiers de 100 Go dans Git est impossible. C'est pourquoi on utilise DVC (Data Version Control), un outil open-source qui gère le versioning de données et de modèles en liant Git à un stockage distant .

Voici comment un flux de travail automatisé se structure généralement :

- Déclenchement : Un pipeline CI (comme CircleCI ou GitHub Actions) lance un nouvel entraînement.

- Tracking : Le modèle est entraîné, et les poids sont sauvegardés. DVC crée un petit fichier texte (pointeur) qui contient le hash du fichier lourd.

- Stockage : Le fichier lourd est poussé vers un stockage distant (Google Drive, AWS S3, Azure Blob Storage) via la commande

dvc push. - Commit : Le petit fichier `.dvc` est commité dans Git. Ainsi, Git sait exactement quelle version des poids correspond à quelle version du code.

- Déploiement : Le serveur de production utilise

dvc pullpour récupérer les poids exacts correspondant au commit Git actuel.

Les risques d'une mauvaise gestion du versioning

Négliger ces infrastructures, c'est accepter un risque opérationnel majeur. Dans les secteurs régulés comme la finance ou la santé, l'incapacité de prouver quelle version d'un modèle a pris une décision spécifique peut mener à des sanctions juridiques. On parle ici de traçabilité.

Sans rollback rapide, une erreur de modèle peut entraîner des heures de downtime. Pire encore, si vous ne versionnez pas vos données, vous pouvez subir une dégradation silencieuse des performances. Vous pensez utiliser le même modèle, mais vos données d'entrée ont dérivé, et vous n'avez aucun moyen de revenir à l'état initial car vous n'avez pas de snapshot du dataset d'origine.

Compétences clés pour le praticien moderne

Maîtriser le déploiement de LLM demande un mélange hybride de compétences. Il ne suffit plus d'être un bon Data Scientist ; il faut devenir un ingénieur MLOps. Cela implique de savoir configurer des environnements reproductibles (via Docker), de comprendre la gestion des caches de modèles et de savoir orchestrer des pipelines de déploiement continu.

La discipline opérationnelle est tout aussi importante que la technique. Il faut définir des déclencheurs de rollback clairs : par exemple, si le taux d'erreur grimpe de 5% sur une fenêtre de 10 minutes, le système doit automatiquement revenir à la version précédente sans intervention humaine.

Pourquoi ne pas utiliser Git pour versionner les poids des LLM ?

Git est conçu pour des fichiers texte légers. Les poids des LLM sont des fichiers binaires massifs (souvent plusieurs gigaoctets). Stocker ces fichiers dans Git ralentirait drastiquement le dépôt et rendrait les clones presque impossibles. C'est pourquoi on utilise des outils comme DVC qui ne stockent dans Git que des pointeurs vers un stockage externe.

Quelle est la différence entre un rollback et un redéploiement ?

Un redéploiement consiste à pousser une nouvelle version du code ou du modèle, ce qui peut prendre du temps (build, tests, déploiement). Un rollback, dans une architecture optimisée avec un Model Registry, consiste simplement à rediriger un pointeur ou un alias vers une version stable déjà existante et chargée, rendant la récupération quasi instantanée.

Le versioning des prompts est-il vraiment nécessaire ?

Absolument. Pour un LLM, le prompt agit comme une couche de configuration. Un changement d'un seul mot dans un prompt peut modifier la structure de sortie ou la précision du modèle. Si vous versionnez vos poids mais pas vos prompts, vous ne pourrez jamais reproduire fidèlement un comportement observé en production.

Qu'est-ce que le "data drift" dans le contexte du versioning ?

Le data drift se produit lorsque la distribution des données d'entrée change au fil du temps, rendant le modèle moins performant. En versionnant vos snapshots de données, vous pouvez comparer les données d'entraînement initiales avec les données actuelles pour identifier précisément quand et pourquoi le modèle a commencé à dériver.

Comment choisir entre W&B et DVC ?

Ce ne sont pas des concurrents directs mais des outils complémentaires. DVC se concentre sur le versioning des fichiers et l'intégration avec Git. Weights & Biases se concentre sur le suivi des expériences (métriques, courbes d'apprentissage) et la gestion des artefacts. Beaucoup d'équipes utilisent DVC pour le stockage et W&B pour la visualisation et le choix de la meilleure version.