Quand une application web générée par l'IA met 4 secondes à répondre à une simple question, les utilisateurs partent. Et si cette même question est posée 10 000 fois par jour ? Vous allez dépenser des milliers de dollars en calcul inutile. Le caching, loin d'être une technique obsolète, est devenu la clé pour rendre les applications d'IA rapides, abordables et fiables. Ce n'est pas une option pour les experts : c'est une nécessité pour tout projet sérieux.

Pourquoi le caching est vital pour l'IA générative

Les modèles d'IA comme GPT-3.5 ou Claude coûtent environ 0,0001 $ par token traité. À grande échelle, ça fait des millions de dollars par an. Imaginez un chatbot client qui répond à des questions répétitives : « Quelle est la politique de retour ? », « Où est mon colis ? ». Chaque fois qu'il relance le modèle complet, vous payez le prix fort. Le caching permet de stocker les réponses déjà calculées et de les réutiliser. Pas besoin de tout recalculer. C'est comme avoir une mémoire pour votre IA.

Les chiffres parlent d'eux-mêmes. Selon IBM, une architecture avec caching (CAG) réduit la latence de 3,8 secondes à 0,9 seconde. InnovationM a vu ses coûts d'API baisser de 70 %, et le temps de réponse moyen est passé de 4,7 secondes à 287 millisecondes. Ce n'est pas une amélioration marginale : c'est une transformation.

Les trois types de caching qui fonctionnent vraiment

Il ne s'agit pas de choisir un outil au hasard. Trois approches dominent, chacune avec ses forces.

- Caching d'objets : Stockez les résultats de requêtes à la base de données ou d'API. Utilisez Redis ou Memcached. Parfait pour les réponses fixes comme les descriptions de produits ou les prix.

- Caching de page : Pour les sections statiques de votre application, comme un footer ou une FAQ. Un CDN ou un reverse proxy comme Varnish les sert en moins de 100 ms.

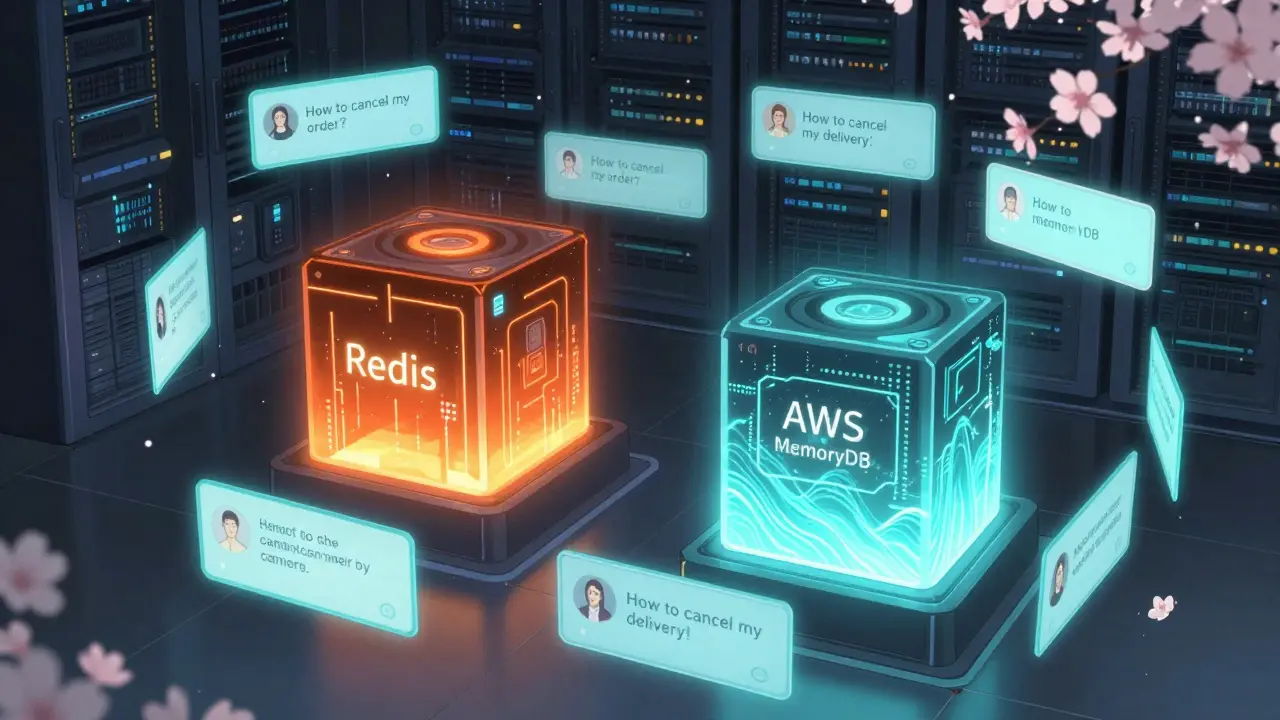

- Caching sémantique : La révolution. Au lieu de chercher une phrase exacte, vous stockez un vecteur - une représentation numérique du sens de la question. Si un utilisateur demande « Comment annuler ma commande ? » et qu'une autre personne demande « Comment annuler ma livraison ? », le système les reconnaît comme équivalents. AWS MemoryDB, avec son moteur de recherche vectoriel intégré, fait ça en temps réel.

Le caching sémantique réduit la latence de 3,2 secondes à 0,5 seconde pour les requêtes répétées. Et il résout un problème majeur : les variations de langage. Les chercheurs du MIT ont montré que le caching exact échoue dans 35 à 40 % des cas parce que les gens reformulent toujours leurs questions.

Comment choisir entre Redis et AWS MemoryDB

Vous avez deux options principales pour démarrer. Voici ce que vous devez savoir.

| Critère | Redis | AWS MemoryDB |

|---|---|---|

| Support des vecteurs | Non natif (nécessite RedisAI ou extensions) | Natif et optimisé |

| Latence moyenne | 150-300 ms | 100-200 ms |

| Durabilité | RDB/AOF snapshots | Multi-AZ, réplication automatique |

| Coût d'exploitation | Modéré | Plus élevé (mais intégré à AWS) |

| Apprentissage | Facile pour les débutants | Exige des connaissances en embeddings |

Si vous débutez et que vos requêtes sont simples, commencez avec Redis. C'est l'outil le plus utilisé, bien documenté, et il gère les données de toutes sortes. Si vous avez un chatbot, un assistant ou un système de recommandations où les formulations varient beaucoup, MemoryDB est plus puissant. Il est conçu pour l'IA. Amazon l'a construit avec Bedrock et Titan en tête.

Les pièges à éviter absolument

Le caching, mal géré, peut rendre votre IA moins précise.

- Les données périmées : Si vous mettez en cache une réponse sur les prix d'un produit pendant 24 heures, et que le prix change, vos utilisateurs voient une fausse information. Google Cloud souligne que cela peut dégrader la précision de 15 à 20 % dans les applications sensibles.

- Le décalage sémantique : Les utilisateurs changent de langage. Si votre cache stocke des réponses anciennes, il peut répondre de manière obsolète à des intentions nouvelles. Le MIT a observé ce phénomène, qu'ils appellent « drift sémantique ».

- Le TTL mal choisi : InnovationM a testé des TTL de 15 minutes, 1 heure, 24 heures. Pour les données de stock, 15 minutes. Pour les FAQs, 24 heures. Pour les actualités, 5 minutes. Il n'y a pas de règle unique.

Une solution éprouvée ? Un mélange de TTL et de « staleness awareness ». Stockez la réponse, mais vérifiez en arrière-plan si la source a changé. Si oui, mettez à jour le cache silencieusement. C'est plus complexe, mais ça évite les erreurs grossières.

Comment commencer - 4 étapes simples

Vous n'avez pas besoin de tout refaire. Voici un plan concret pour démarrer en 2 semaines.

- Identifiez ce qui peut être mis en cache : Analysez vos logs. Gartner montre que 60 à 70 % des requêtes dans les applications IA sont répétées. Cherchez les questions fréquentes, les réponses identiques, les requêtes similaires.

- Choisissez votre outil : Pour la plupart des cas, commencez avec Redis. Installez-le sur un serveur dédié (minimum 4 Go RAM, 2 cœurs CPU). Si vous êtes sur AWS, testez MemoryDB avec un cluster de test.

- Implémentez le cache hit/miss : Quand une requête arrive, vérifiez d'abord le cache. Si trouvé, renvoyez-la directement. Si pas trouvée, appelez le modèle, stockez la réponse, puis envoyez-la.

- Définissez une stratégie d'invalidation : Utilisez un TTL de 24 heures pour les contenus stables. Pour les données dynamiques, combinez avec une vérification périodique. Ajoutez un « cache stampede protection » : si 100 requêtes arrivent en même temps pour une donnée manquante, ne laissez qu'une seule requête générer la réponse - les autres attendent le cache.

Vous n'avez pas besoin de tout automatiser dès le début. Commencez par un seul endpoint. Mesurez la différence. Ensuite, étendez.

Le futur : vers des caches intelligents

Le caching ne s'arrête pas là. AWS a lancé en novembre 2024 une fonctionnalité appelée « Adaptive Cache » qui utilise l'IA pour prédire quelles entrées seront supprimées. Résultat ? Une hausse de 18 % du taux de réussite du cache. InnovationM travaille sur un système « fédéré » qui synchronise les caches entre plusieurs centres de données, réduisant le trafic réseau de 35 %.

Le consensus est clair : d'ici 2026, 85 % des applications IA en entreprise utiliseront des stratégies de caching multicouche. Cela ne signifie pas que l'IA deviendra plus rapide par magie. Cela signifie que nous apprenons à la rendre efficace. Le caching n'est pas un luxe - c'est l'architecture même de la scalabilité.

Quel est le taux de cache idéal pour une application IA ?

Un taux de cache de 60 à 70 % est considéré comme excellent pour les applications d'IA. En dessous de 50 %, vous n'obtenez pas assez de gain pour justifier la complexité. Au-delà de 80 %, vous avez probablement bien optimisé vos requêtes. Les meilleurs systèmes, comme ceux d'AWS ou d'InnovationM, atteignent 70-75 % avec des stratégies sémantiques.

Le caching peut-il rendre mon IA moins précise ?

Oui, si vous ne gérez pas l'invalidation. Une réponse obsolète dans le cache peut être renvoyée comme vérité. Cela arrive surtout avec les données dynamiques : prix, disponibilité, informations en temps réel. Le risque est de 15 à 20 % de dégradation de précision selon Google Cloud. La solution : associer un TTL court avec une vérification en arrière-plan ou utiliser un caching sémantique qui reconnaît les changements de contexte.

Dois-je mettre en cache les réponses personnalisées ?

Généralement, non. Si la réponse dépend d'informations uniques à un utilisateur (historique, profil, session), le caching n'aide pas. Mais si la structure est similaire - par exemple, « mon dernier achat » - vous pouvez mettre en cache la structure de réponse et injecter les données personnalisées à la sortie. C'est ce qu'on appelle le « partial caching ».

Quelle est la différence entre RAG et CAG ?

RAG (Retrieval-Augmented Generation) combine une recherche externe avec la génération d'IA. CAG (Cache-Augmented Generation) ajoute un cache à ce processus. Le CAG vérifie d'abord si la réponse a déjà été générée et stockée, avant de chercher dans la base de connaissances. Cela évite de relancer la recherche et la génération pour les requêtes répétées. CAG est plus rapide et moins coûteux que RAG pur.

Le caching sémantique est-il plus lent à cause des vecteurs ?

Oui, mais le gain l'emporte largement. Le calcul du vecteur prend environ 150 ms, ce qui semble beaucoup. Mais il remplace une génération d'IA complète qui prend 3 à 5 secondes. Donc, même avec ce surcoût, la réponse finale est 6 à 10 fois plus rapide. Le coût total est plus bas, et l'expérience utilisateur est nettement meilleure.