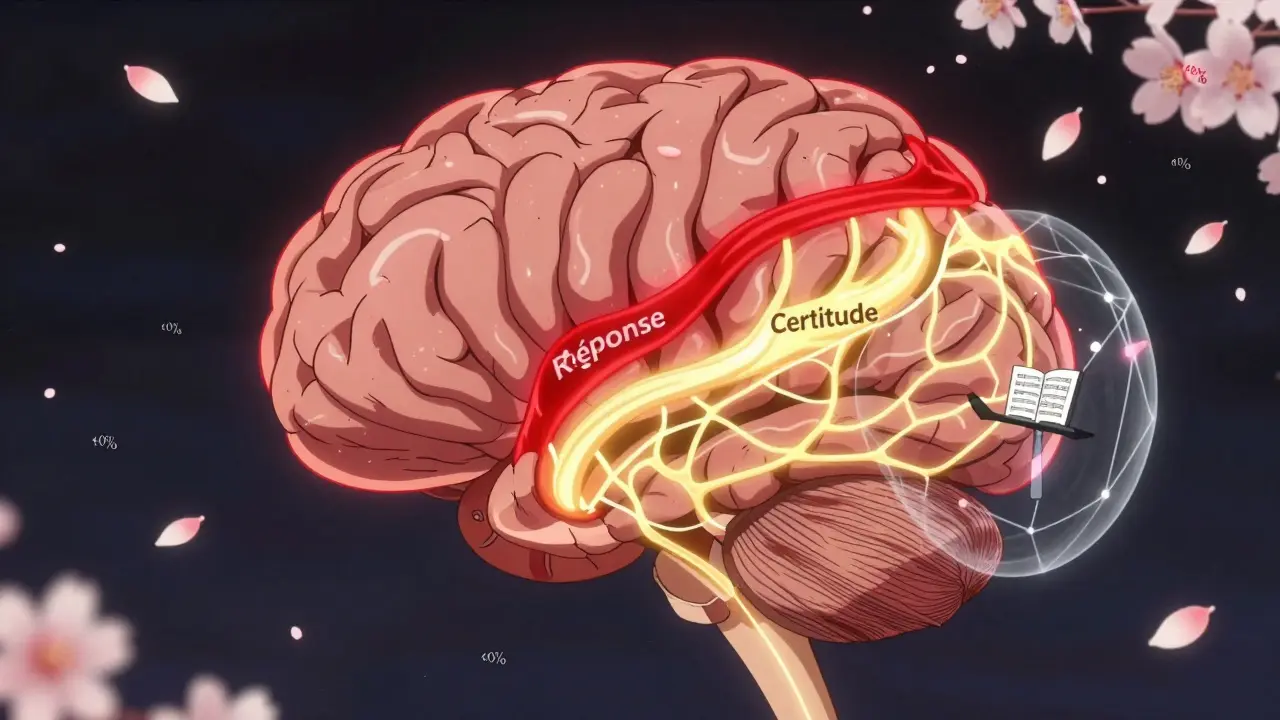

Quand un modèle de langage large (LLM) répond à une question, il ne se contente pas de donner une réponse. Il évalue aussi sa propre certitude. Mais cette certitude est souvent fausse. Un modèle peut être à 95 % « confiant » dans une réponse… et pourtant se tromper. C’est là que la calibration post-entraînement entre en jeu. Ce n’est pas une simple optimisation technique : c’est une réforme fondamentale de la façon dont les modèles communiquent leur incertitude.

Pourquoi la confiance d’un LLM est souvent trompeuse ?

Pendant l’entraînement initial, les modèles apprennent à prédire le mot suivant. Leur objectif est de maximiser la précision statistique, pas la fiabilité. Résultat ? Ils deviennent excellents à générer des réponses fluides… mais pas à dire « je ne sais pas ». Un modèle peut répondre avec une confiance excessive à une question hors de son domaine, ou au contraire, hésiter sur une réponse simple et correcte. Ce décalage entre confiance réelle et confiance affichée est un problème majeur pour les applications critiques : diagnostic médical, conseil juridique, ou même assistance à la prise de décision.Deux approches pour mesurer la confiance

Deux méthodes principales ont émergé pour corriger cela. La première utilise un modèle externe. On entraîne un petit réseau neuronal, séparé du LLM principal, pour prédire la probabilité que la réponse du modèle soit correcte. Ce modèle externe analyse à la fois l’entrée, la sortie générée, et les activations internes du LLM - comme si on examinait les signaux neurologiques d’un cerveau pour juger de sa certitude. Cette approche a montré de bons résultats dans les laboratoires de l’Institut d’ingénierie logicielle de Carnegie Mellon. La seconde méthode est plus étonnante : on demande directement au modèle de s’évaluer. En ajoutant une instruction comme « Sur une échelle de 0 à 100, à quel point es-tu sûr de cette réponse ? », les chercheurs ont découvert que certains LLMs peuvent fournir des estimations de confiance relativement fiables. Ce n’est pas parfait - les modèles peuvent encore mentir ou être biaisés - mais cela fonctionne mieux que prévu. C’est une forme d’auto-évaluation, presque introspective.La réorganisation cachée des paramètres

Ce qui est fascinant, c’est que la calibration post-entraînement ne modifie pas simplement les poids du modèle. Des analyses récentes utilisant la décomposition en valeurs singulières (SVD) montrent que l’entraînement postérieur provoque deux changements structurels profonds. D’abord, une mise à l’échelle uniforme des valeurs singulières à travers les couches - comme si on ajustait le volume d’un système audio. Ensuite, une rotation cohérente des vecteurs singuliers. Cette rotation est cruciale : si on la perturbe, le modèle s’effondre. Cela signifie que la calibration ne rajoute pas de nouvelles connaissances. Elle réorganise les existantes, comme un musicien qui réarrange les cordes d’un instrument pour produire un son plus juste.

Calibration et quantification : un lien souvent ignoré

Quand on veut rendre un LLM plus rapide et moins gourmand en mémoire, on le quantifie : on passe de nombres flottants 32-bit à des entiers 8-bit. Mais cette réduction de précision casse la calibration. Un modèle quantifié peut perdre sa capacité à estimer sa confiance. Pour éviter cela, on utilise des techniques de calibration spécifiques à la quantification. La méthode min-max, par exemple, analyse un petit jeu de données (128 à 512 exemples) pour trouver les valeurs minimales et maximales des activations. Mais elle est fragile : un seul cas extrême peut fausser tout le processus. Des méthodes plus avancées comme SmoothQuant et AWQ (Activation-aware Weight Quantization) changent la donne. AWQ, introduite en 2023, ajuste les poids en fonction des motifs typiques d’activation. Plutôt que de réduire uniformément la précision, elle protège les poids les plus sensibles. Résultat : une perte de précision réduite de 40 % par rapport aux méthodes classiques, sans augmenter la taille du modèle. Cela montre que la calibration n’est pas un après-thought : elle est intégrée à la conception même de l’efficacité.Calibration vs. alignement : deux étapes distinctes

Beaucoup confondent calibration et alignement. Ce n’est pas la même chose. L’alignement, comme dans RLHF (Reinforcement Learning from Human Feedback), vise à rendre les réponses plus utiles, plus sûres, plus humaines. On utilise des annotations humaines pour apprendre ce qui est « bon » ou « mauvais ». Le modèle apprend à éviter les réponses toxiques ou incorrectes. La calibration, elle, ne juge pas le contenu. Elle mesure simplement la correspondance entre la confiance affichée et la vraie précision. Un modèle peut être parfaitement aligné - poli, éthique, bien formulé - mais totalement mal calibré : trop confiant sur les erreurs, trop hésitant sur les vérités. Des alternatives comme ORPO (Odds Ratio Preference Optimization) combinent alignement et calibration dans une seule étape. Au lieu d’entraîner un modèle de récompense séparé, ORPO calcule directement une perte qui pénalise à la fois les réponses incorrectes et les confiances mal estimées. Cela réduit le temps d’entraînement de 30 % et améliore la cohérence entre performance et confiance.Le défi humain : comment présenter l’incertitude ?

Une calibration parfaite est inutile si l’utilisateur ne comprend pas ce qu’il voit. Une étude en psychologie cognitive montre que les gens ignorent les probabilités, préfèrent les certitudes absolues, et confondent confiance avec compétence. Un modèle qui affiche « 78 % de confiance » est souvent perçu comme « presque certain ». Or, 78 % signifie une chance sur 5 de se tromper. C’est trop pour une décision médicale, trop peu pour un chatbot. C’est pourquoi la calibration doit s’accompagner d’une interface humaine réfléchie. Plutôt que de donner un nombre, certains systèmes utilisent des couleurs, des icônes, ou des phrases naturelles : « Je suis très sûr », « Je ne suis pas certain », « Cela dépend du contexte ». Ce n’est pas une question de technologie, mais de conception cognitive. Un modèle bien calibré, mal présenté, est aussi dangereux qu’un modèle mal calibré.Les pièges à éviter

Trois risques majeurs menacent les systèmes de calibration.- Oubli catastrophique : en ajustant la confiance, on peut effacer des connaissances anciennes. Un modèle qui apprend à dire « je ne sais pas » sur une question peut oublier comment répondre à une autre.

- Triche de récompense : un modèle peut apprendre à afficher une confiance élevée même quand il se trompe, si c’est ce qu’on récompense.

- Équilibre inférence : ajouter un modèle externe de calibration augmente la latence. Pour un chatbot en temps réel, 200 ms de plus, c’est trop.

Quel avenir pour la calibration ?

La calibration post-entraînement n’est plus une option. Elle devient une exigence pour toute application sérieuse. Les progrès récents montrent que les modèles ne sont pas des boîtes noires. Leur comportement suit des règles géométriques et statistiques stables. On peut les comprendre, les analyser, les ajuster. La prochaine étape ? Des calibrateurs autonomes : des modules intégrés qui s’auto-ajustent en temps réel, en fonction du contexte, du risque, et de l’utilisateur. Ce n’est plus de la science-fiction. C’est déjà en test dans des laboratoires de recherche.Le vrai défi n’est plus de faire parler les modèles. C’est de leur apprendre à dire « je ne sais pas »… et à le dire avec la bonne intensité.

Quelle est la différence entre calibration et fine-tuning ?

Le fine-tuning ajuste les paramètres du modèle pour améliorer sa précision sur une tâche spécifique - par exemple, répondre à des questions médicales. La calibration, elle, ne change pas ce que le modèle sait, mais comment il exprime sa certitude. Un modèle peut être parfaitement fine-tuné et pourtant mal calibré : il donne de bonnes réponses… mais croit à tort être sûr à 99 %.

La calibration augmente-t-elle la latence des réponses ?

Cela dépend de la méthode. Si on utilise un modèle externe pour prédire la confiance, oui, cela ajoute un temps de calcul. Mais les méthodes introspectives - où le modèle s’évalue lui-même - n’ajoutent presque pas de latence. De plus, la calibration peut réduire la latence globale en permettant au système d’abstenir plus tôt, évitant des calculs inutiles.

Peut-on calibrer un modèle sans données d’étiquetage ?

Oui, mais avec des limites. Les méthodes introspectives n’ont pas besoin de données étiquetées. Elles utilisent uniquement les sorties du modèle. Pour les méthodes externes, un petit jeu de données (50 à 200 exemples) suffit. Il n’est pas nécessaire d’avoir des milliers d’étiquettes : il faut juste des exemples représentatifs de ce que le modèle rencontrera en production.

Pourquoi la calibration est-elle plus importante pour les LLM que pour les modèles classiques ?

Les LLM génèrent des réponses libres, non limitées à des catégories fixes. Ils peuvent inventer des faits, reformuler des idées, ou répondre à des questions hors domaine. Sans calibration, ils semblent convaincants… même quand ils se trompent. Les modèles classiques, comme les classificateurs d’images, ont des sorties binaires ou multi-classes. Leur incertitude est plus facile à mesurer. Avec un LLM, la confiance est un signal critique, pas un détail.

Quels sont les meilleurs outils pour calibrer un LLM aujourd’hui ?

Aucun outil n’est universel, mais les approches les plus efficaces combinent deux éléments : une méthode introspective (comme demander au modèle de noter sa confiance) et une calibration par échelle de température ajustée. Des bibliothèques comme Hugging Face et vLLM intègrent maintenant des options de calibration. Pour les cas critiques, les équipes de recherche utilisent des pipelines personnalisés avec AWQ pour la quantification et des réseaux de confiance externes entraînés sur des jeux de données spécifiques.