Quand vous posez une question complexe à une IA, comme "Combien de temps faut-il pour qu’un investissement de 15 000 $ double à 7 % d’intérêt composé annuel ?", elle ne pense pas comme vous. Elle ne calcule pas. Elle ne raisonne pas. Elle prédit des mots. Mais il existe une façon de la forcer à raisonner - et ça change tout.

Comment une IA peut-elle "penser" sans réellement penser ?

Avant 2022, les modèles linguistiques comme GPT ou Claude répondaient directement. Vous demandiez : "Quelle est la racine carrée de 144 ?" - ils répondaient : "12". Pas de détails. Pas de logique. Juste une réponse. Et quand la question devenait plus complexe - par exemple, "Si un train part de Paris à 14h à 180 km/h et un autre de Lyon à 15h à 160 km/h, à quelle heure et où se croisent-ils ?" - ils se trompaient souvent. Pas parce qu’ils étaient stupides, mais parce qu’ils n’étaient pas invités à montrer leur travail.

En janvier 2022, une équipe de Google Research a publié un papier qui a changé la donne. Ils ont demandé aux modèles de dire "Pensons étape par étape" avant de répondre. Résultat ? Sur des tests de mathématiques, les erreurs ont chuté de jusqu’à 58 %. Ce n’était pas un nouveau modèle. C’était une nouvelle façon de poser les questions.

Cette technique s’appelle Chain-of-Thought Prompting (CoT). Elle oblige l’IA à générer une chaîne de raisonnements intermédiaires avant de livrer la réponse finale. C’est comme demander à un étudiant de noter chaque étape de son calcul, pas juste la réponse finale. Et ça marche.

Comment fonctionne le Chain-of-Thought en pratique ?

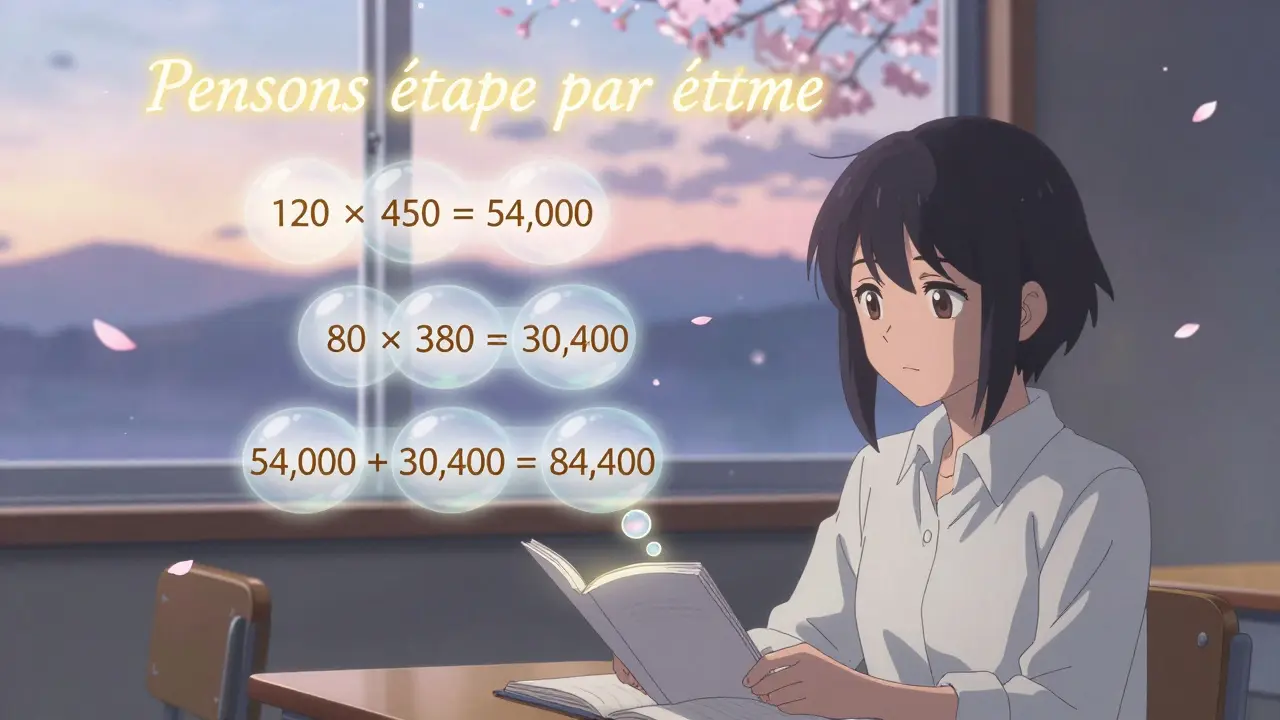

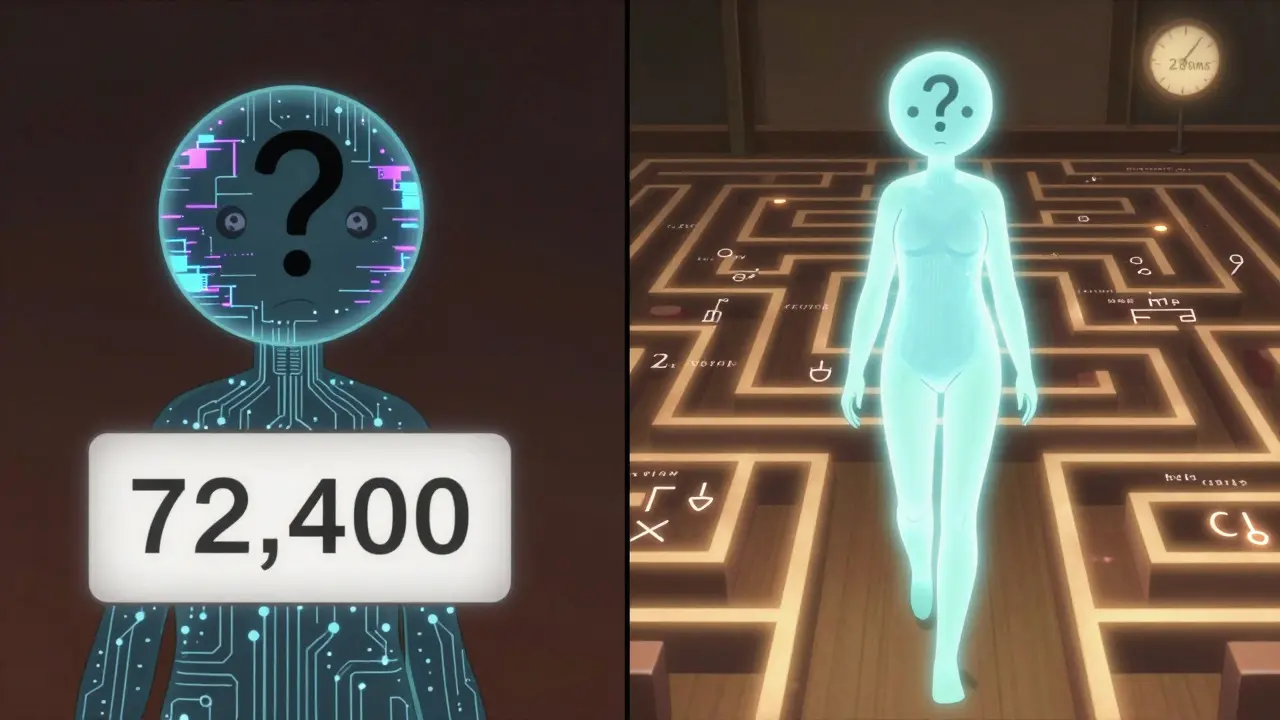

Voici un exemple simple. Sans CoT :

Votre question : "Un magasin vend 120 téléphones à 450 $ chacun. Il en vend 80 à 380 $. Quel est le chiffre d’affaires total ?"

Réponse classique : "72 400 $"

Mais avec CoT, vous obtenez :

Réponse avec CoT : "D’abord, calculons les ventes des 120 téléphones : 120 × 450 = 54 000 $. Ensuite, les 80 téléphones à 380 $ : 80 × 380 = 30 400 $. Enfin, additionnons les deux montants : 54 000 + 30 400 = 84 400 $. Le chiffre d’affaires total est donc de 84 400 $."

Remarquez la différence ? L’IA a montré son raisonnement. Et cette transparence améliore non seulement la précision, mais aussi la confiance. Les utilisateurs peuvent vérifier les étapes. Ils voient où l’IA s’est trompée - ou pas.

Les chercheurs de Stanford et du MIT ont testé cette méthode sur 12 modèles différents. Sur des problèmes de logique et de mathématiques, les performances ont augmenté de 39,7 % en moyenne. Pour les tâches simples comme "Quelle est la capitale de la France ?", CoT n’apporte rien. Mais pour les tâches à plusieurs étapes ? C’est un révélateur.

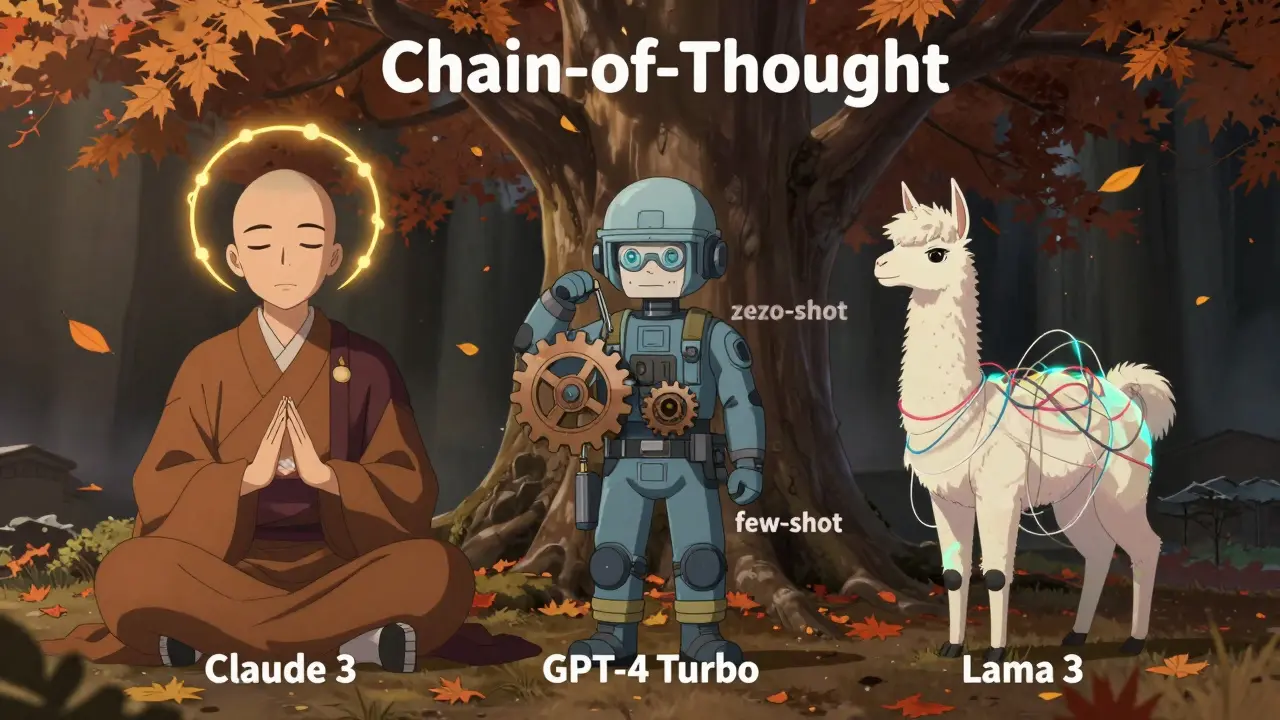

Les trois formes principales de Chain-of-Thought

Il n’y a pas une seule façon d’appliquer CoT. Trois variantes dominent aujourd’hui :

- Zero-shot CoT : Vous ajoutez simplement "Pensons étape par étape" à la fin de votre question. Aucun exemple fourni. Fonctionne bien avec les grands modèles (plus de 50 milliards de paramètres). C’est la version la plus simple à utiliser.

- Few-shot CoT : Vous donnez 2 à 5 exemples complets de raisonnement avant de poser la question réelle. Très efficace pour des tâches spécifiques comme la résolution de problèmes juridiques ou financiers. Mais ça demande du temps pour préparer les exemples.

- Auto-CoT : Le modèle génère automatiquement ses propres exemples de raisonnement avant de répondre. Pas besoin que vous fournissiez des exemples. C’est comme si l’IA se mettait à l’école d’elle-même. Selon Google Research, elle garde 89 % de l’efficacité de few-shot CoT sans qu’on ait à écrire un seul exemple.

En 2025, la plupart des outils d’IA (comme Claude 3, GPT-4 Turbo ou Llama 3) intègrent déjà CoT automatiquement. Mais savoir le déclencher manuellement vous donne un contrôle total.

Les avantages réels - et les pièges

CoT n’est pas une solution magique. Voici ce que vous gagnez :

- Précision accrue : Sur des tests de mathématiques (GSM8K, MATH), les erreurs diminuent de 40 % en moyenne.

- Transparence : Vous voyez comment l’IA arrive à sa réponse. C’est essentiel dans la finance, la santé ou le droit.

- Fiabilité accrue : Anthropic affirme que CoT a réduit les erreurs de raisonnement de 41 % chez Claude, tout en augmentant la confiance des utilisateurs de 33 %.

Mais voici les coûts :

- Plus de tokens : Chaque étape de raisonnement utilise des tokens. CoT augmente la longueur des réponses de 35 à 60 %. Sur OpenAI ou AWS, ça peut faire monter vos coûts de 40 %.

- Plus de temps : Une réponse avec CoT prend en moyenne 220 à 350 millisecondes de plus. Pour une application en temps réel, ça peut être un problème.

- Hallucinations de raisonnement : L’IA peut construire une chaîne logique qui semble parfaite… mais qui est fausse. Une étude de l’Université de Washington a montré que 18,7 % des réponses CoT contenaient des erreurs logiques invisibles. C’est un piège : l’IA est plus convaincante, donc plus dangereuse.

Dr. Emily M. Bender, professeure à l’Université de Washington, le dit clairement : "CoT crée une illusion de raisonnement. L’IA ne comprend pas - elle imite des structures de raisonnement qu’elle a vues dans ses données."

Comment l’implémenter efficacement ?

Voici un guide concret pour l’appliquer dans vos projets :

- Commencez par zero-shot CoT : Ajoutez "Pensons étape par étape" à vos prompts. Testez sur 10 questions complexes. Comparez les réponses avec et sans CoT.

- Si les résultats sont bons, passez à few-shot CoT : Préparez 3 exemples complets de raisonnement. Utilisez des cas réels de votre domaine (ex : "Un patient a une tension de 145/90, un IMC de 29, et un taux de cholestérol de 240. Quel est le risque cardiovasculaire ?" - puis montrez la chaîne de raisonnement).

- Utilisez la vérification à chaque étape : Pour éviter les hallucinations, demandez : "Vérifie chaque étape. Est-ce que 145/90 est vraiment hypertension ?"

- Limitez le nombre d’étapes : 3 à 7 étapes maximum. Au-delà, l’IA se perd. Les chercheurs de Stanford recommandent 5 étapes comme seuil optimal.

- Surveillez les coûts : Sur des applications internes, utilisez CoT seulement pour les décisions critiques. Sur des applications clients, le coût supplémentaire peut être justifié par la confiance.

Sur Reddit, un développeur a partagé qu’il a réduit ses erreurs de 23 % à 8 % sur des analyses financières en utilisant CoT - mais ses coûts API ont doublé. Il l’a gardé pour ses clients, pas pour ses outils internes. C’est un bon exemple de compromis réaliste.

Quels modèles fonctionnent le mieux ?

Tous les grands modèles supportent CoT maintenant, mais certains le font mieux :

- Claude 3 (Anthropic) : Intégré nativement. Appelé "giving Claude space to think". Très cohérent, très peu de dérives.

- GPT-4 Turbo (OpenAI) : Très bon avec zero-shot CoT. Moins fiable avec few-shot si les exemples ne sont pas parfaitement structurés.

- Llama 3 (Meta) : Nécessite plus de réglages. Même prompt que sur Claude donne souvent des réponses fragmentées. Il faut 5 à 7 heures d’expérimentation pour obtenir des résultats stables.

Un développeur sur Stack Overflow l’a résumé en novembre 2024 : "La même phrase que je donne à Claude 3 Opus donne un raisonnement parfait. Avec Llama 3 70B, je reçois trois phrases incohérentes. C’est frustrant."

Les nouvelles directions : au-delà du Chain-of-Thought

CoT n’est pas la fin. Il en est le début. En 2025, trois variantes émergent :

- Tree-of-Thought (TOT) : L’IA explore plusieurs chaînes de raisonnement en parallèle, comme un arbre. Elle choisit la meilleure. 28 % plus précise que CoT sur les tâches de planification.

- Graph-of-Thought (GOT) : Les raisonnements ne sont plus linéaires, mais connectés en réseau. Parfait pour les tâches avec beaucoup de connaissances (ex : diagnostic médical).

- Self-Refine CoT : L’IA révise sa propre chaîne de raisonnement après l’avoir produite. Réduit les erreurs de 42 % selon DeepMind.

Google a même lancé "Chain-of-Symbol" en décembre 2024, qui combine CoT avec des symboles mathématiques pour réduire les hallucinations de 31 %. Anthropic a ajouté "Verifiable CoT" en janvier 2025, qui vérifie chaque étape avec des sources fiables.

Et maintenant ?

CoT n’est plus une technique expérimentale. C’est une norme. 78 % des entreprises qui utilisent l’IA pour des tâches complexes - en finance, en santé, en droit - l’appliquent déjà. Les outils comme LangChain ou PromptLayer l’intègrent directement dans leurs pipelines.

Si vous travaillez avec des modèles d’IA pour résoudre des problèmes à plusieurs étapes, vous ne pouvez plus ignorer CoT. Mais vous devez aussi comprendre ses limites. Ne le traitez pas comme une boîte noire. Exigez la transparence. Vérifiez les étapes. Limitez les coûts. Et n’oubliez pas : l’IA ne raisonne pas. Elle simule le raisonnement. Et c’est déjà suffisant… pourvu que vous restiez vigilant.

Qu’est-ce que le Chain-of-Thought Prompting exactement ?

C’est une technique de prompt engineering qui oblige un modèle d’IA à générer une série d’étapes de raisonnement avant de fournir une réponse finale. Au lieu de répondre directement, l’IA "montre son travail", comme un étudiant en mathématiques. Cela améliore la précision sur les tâches complexes, notamment en logique, mathématiques et raisonnement commun.

Quelle est la différence entre CoT et le prompt chaining ?

Le prompt chaining implique plusieurs échanges entre l’utilisateur et l’IA, où chaque réponse sert de base à la question suivante. Le Chain-of-Thought, lui, génère toute la chaîne de raisonnement en une seule réponse. Cela réduit les interactions et le temps de traitement, tout en gardant une logique structurée.

Pourquoi CoT augmente-t-il les coûts d’API ?

Parce que chaque étape de raisonnement est un mot (token) supplémentaire. Une réponse avec CoT peut être 35 à 60 % plus longue qu’une réponse directe. Sur des plateformes comme OpenAI ou AWS, où vous payez par token, cela se traduit par une augmentation de 40 % environ des coûts par requête.

CoT fonctionne-t-il sur tous les modèles d’IA ?

Oui, mais pas de la même manière. Claude 3 le fait très bien avec peu de réglages. GPT-4 Turbo est bon, mais nécessite des prompts bien formulés. Llama 3, en revanche, demande souvent 5 à 7 heures d’expérimentation pour obtenir des résultats stables. Les modèles plus grands (plus de 50 milliards de paramètres) répondent mieux à CoT.

Est-ce que CoT rend l’IA plus intelligente ?

Non. L’IA ne devient pas plus intelligente. Elle devient plus convaincante. CoT lui permet de simuler un raisonnement logique en se basant sur des motifs qu’elle a appris. Mais elle ne comprend pas les concepts. C’est une simulation, pas une compréhension. C’est pourquoi il faut toujours vérifier ses étapes.

Quels sont les meilleurs outils pour implémenter CoT ?

Pour les développeurs, LangChain et PromptLayer offrent des bibliothèques pour intégrer CoT dans les pipelines. Pour les utilisateurs finaux, Claude 3 (d’Anthropic) est le plus fiable sans configuration. Les modèles de Google (Gemini) et OpenAI (GPT-4 Turbo) l’intègrent aussi, mais nécessitent plus de réglages manuels.

Comment éviter les "hallucinations de raisonnement" ?

Trois méthodes : 1) Limitez le nombre d’étapes à 3-7 ; 2) Ajoutez des vérifications à chaque étape (ex : "Vérifie que cette hypothèse est correcte") ; 3) Utilisez Auto-CoT ou Verifiable CoT, où l’IA vérifie ses propres étapes avec des sources fiables. Les études montrent que ces méthodes réduisent les erreurs de 20 à 30 %.