Vous déployez des modèles de langage (LLM) dans votre entreprise ? Attention. Ce n'est plus seulement une question d'innovation technique, c'est un champ miné juridique. En mai 2026, la conformité au traitement des données par les LLM est devenue aussi critique que la sécurité financière. Une simple fuite de données via un prompt non surveillé peut coûter jusqu'à 4 % du chiffre d'affaires mondial sous le RGPD, ou déclencher des amendes massives aux États-Unis avec les nouvelles lois étatiques.

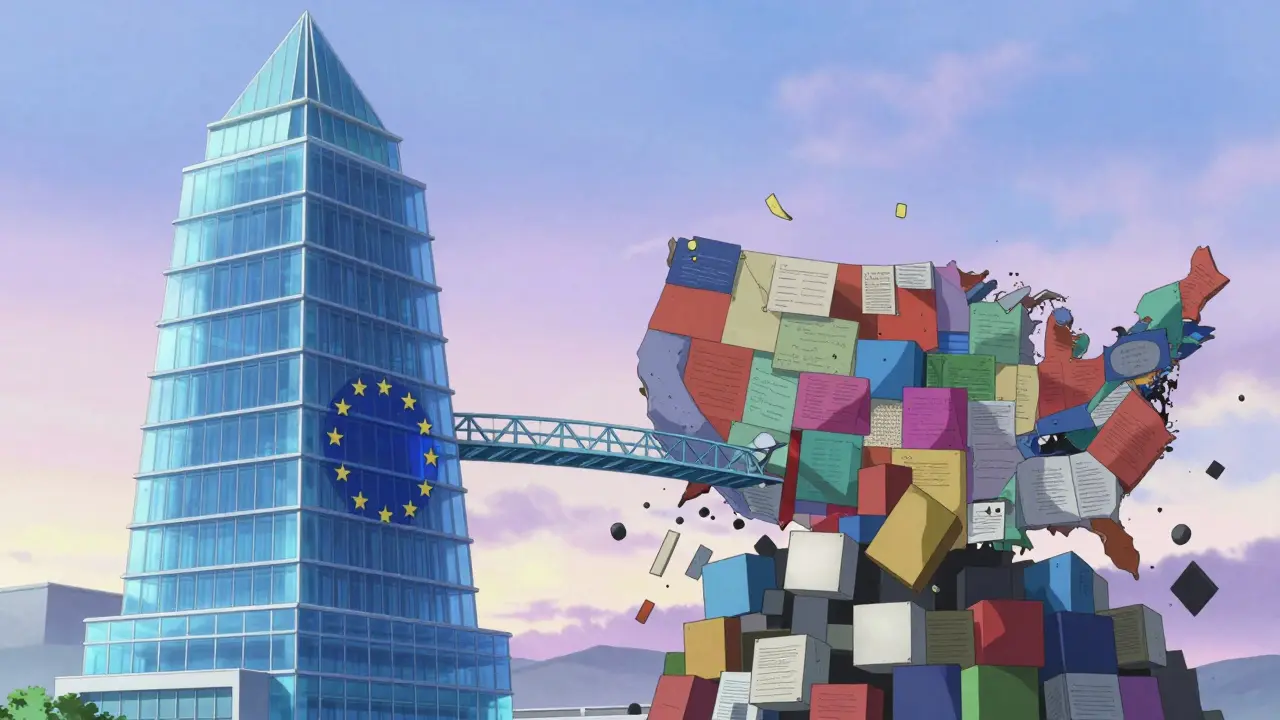

Le paysage réglementaire a radicalement changé depuis 2023. L'Loi IA européenne, entrée en vigueur en août 2024, impose des obligations strictes pour les systèmes à haut risque, avec une application complète prévue pour mai 2026. Aux États-Unis, 20 États appliquent désormais des lois sur la vie privée avec des dispositions spécifiques à l'IA, créant un casse-tête juridique complexe pour les entreprises multinationales.

Pourquoi la conformité LLM est différente de la gouvernance classique

Les modèles de langage ne fonctionnent pas comme les logiciels traditionnels. Ils ingèrent des masses de données, génèrent des réponses imprévisibles et peuvent mémoriser involontairement des informations sensibles. Selon une analyse de Lasso Security en décembre 2024, 83 % des échecs de conformité surviennent après le déploiement, car les entreprises traitent la conformité comme un projet ponctuel plutôt qu'une surveillance continue.

Les risques principaux incluent :

- Le partage excessif d'informations sensibles via des prompts malveillants ou accidentels

- La récupération non autorisée de données personnelles lors des requêtes

- Les sorties « hallucinées » ou trompeuses qui violent les lois sur la protection des consommateurs

- L'entraînement de modèles sur des données utilisateur sans consentement explicite

L'Conseil européen de la protection des données (CEPD), dans ses lignes directrices d'avril 2025, précise que les évaluations d'impact sur la protection des données (EIPD) standard sont insuffisantes pour les LLM. Des mesures techniques supplémentaires sont nécessaires pour adresser les risques spécifiques comme la mémorisation des données d'entraînement et les attaques par inférence.

Carte réglementaire : UE vs États-Unis en 2026

| Critère | Union Européenne (Loi IA + RGPD) | États-Unis (Lois étatiques) |

|---|---|---|

| Approche principale | Protection des droits fondamentaux, approche basée sur le risque | Protection du consommateur, innovation sectorielle |

| Système à haut risque | Obligatoire : santé, éducation, emploi. Évaluations d'impact obligatoires. | Définitions variables selon les États. Pas de cadre fédéral unifié. |

| Transparence des données | Exigence de documentation des sources d'entraînement pour les systèmes génératifs. | Californie (janv. 2026) : divulgation des sources de données. Colorado (fév. 2026) : droit à l'explication. |

| Sanctions | Jusqu'à 4 % du CA mondial ou 20 millions d'euros (RGPD). | Variable : amendes quotidiennes (ex: Californie $200/jour), actions des procureurs généraux. |

| Complexité | Harmonisé mais strict. Coûts de mise en conformité élevés. | Fragmenté. 20 États différents = matrices de conformité complexes. |

En Europe, la Loi IA classe les applications LLM selon leur niveau de risque. Les systèmes affectant l'emploi, l'éducation ou la santé sont considérés comme « à haut risque » et nécessitent une gestion rigoureuse des risques. Aux États-Unis, la situation est plus fragmentée. La Californie exige des résumés de jeux de données, le Colorado met l'accent sur la prévention de la discrimination algorithmique, et le Maryland applique sa propre loi sur la protection des données en ligne depuis octobre 2025.

Cette fragmentation crée des coûts de conformité plus élevés pour les opérations américaines. Selon Hinshaw Law Firm, 67 % des organisations multinationales rapportent des coûts plus élevés pour se conformer aux régulations US en raison de cette complexité.

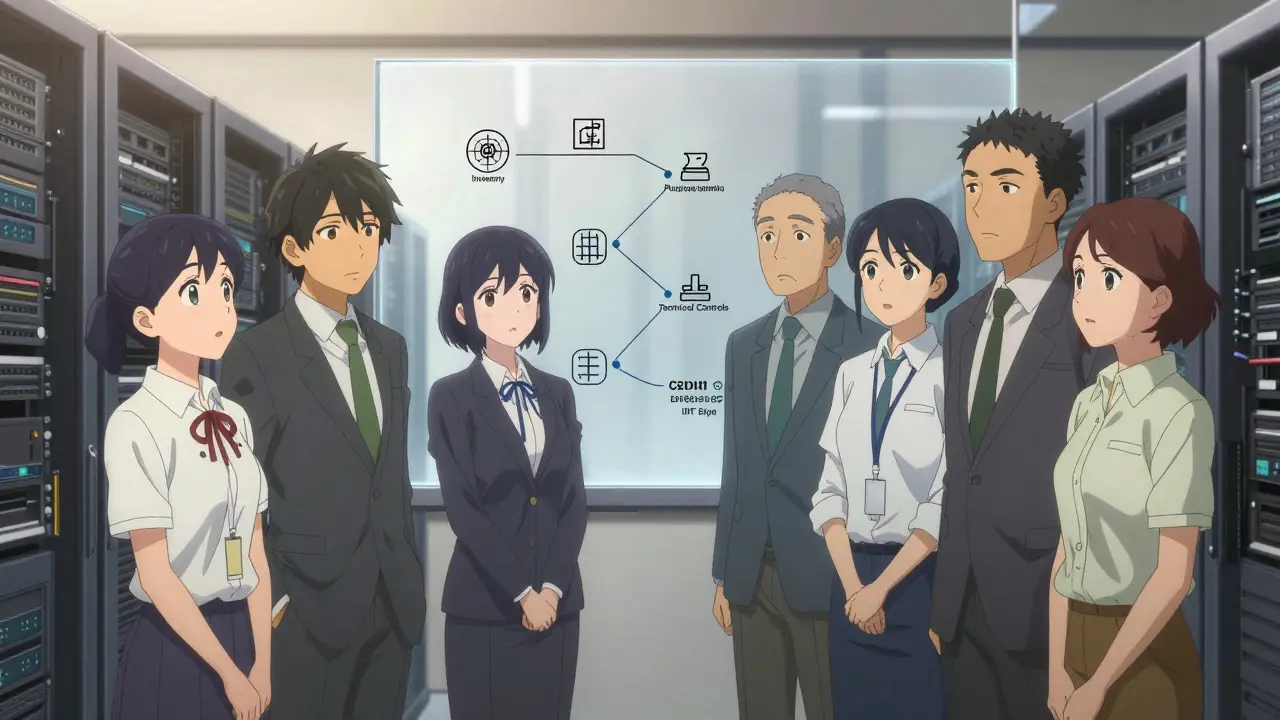

Architecture technique : Les piliers de la conformité

La conformité ne se décrète pas, elle s'implémente techniquement. Voici les composants essentiels que vous devez intégrer dès maintenant :

Gestion des accès et authentification

Votre système doit utiliser une gestion des accès basée sur l'identité (RBAC) combinée à une authentification multi-facteurs (MFA). Mais attention, cela ne suffit plus. Le contrôle d'accès basé sur le contexte (CBAC) devient la norme. Cela signifie que l'accès aux données dépend non seulement du rôle de l'utilisateur, mais aussi du contexte de la requête, de l'appareil utilisé et même du type de prompt envoyé.

Minimisation des données

Chaque champ de données traité par votre LLM doit avoir un but spécifique et une base légale claire. L'utilisation de données utilisateur pour entraîner des modèles nécessite presque toujours un consentement explicite. Ne supposez jamais que l'utilité opérationnelle couvre tout. Protégez-vous en documentant explicitement pourquoi chaque donnée est nécessaire.

Surveillance en temps réel

Les outils de conformité doivent analyser 100 % des interactions LLM avec une latence inférieure à 500 millisecondes. Pourquoi ? Parce qu'un prompt contenant des données sensibles peut être envoyé et traité en quelques secondes. Une surveillance post-mortem est inutile si la violation a déjà eu lieu. Les solutions leaders du marché, comme celles analysées par Oligo Security en 2025, garantissent cette rapidité pour bloquer les violations avant qu'elles ne se produisent.

Chiffrement et architecture Zero Trust

92 % des organisations régulées ont adopté des architectures Zero Trust pour les flux de données LLM en 2025. Cela signifie chiffrer les données en transit et au repos, et ne faire confiance à aucune entité par défaut, même à l'intérieur du réseau d'entreprise.

Feuille de route : Déployer la conformité en 5 phases

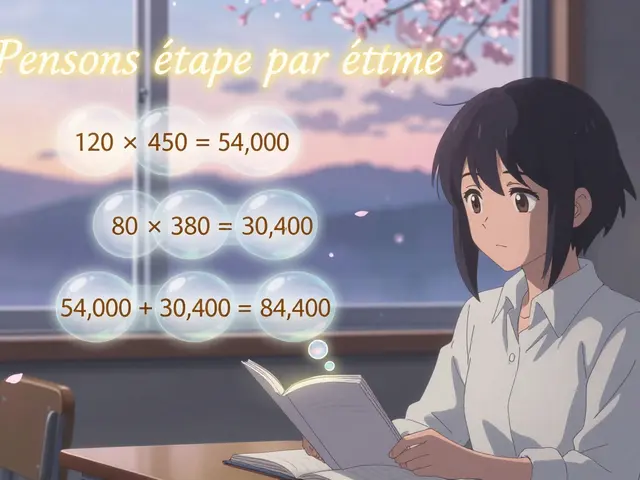

Ne tentez pas de tout faire d'un coup. Suivez cette structure éprouvée, documentée par Protecto AI :

- Inventorier tous les déploiements LLM (14 jours) : Cartographiez chaque instance, plugin et API utilisant un modèle de langage. Beaucoup d'entreprises découvrent des « IA fantômes » déployées par des départements isolés sans supervision centrale.

- Mapper les flux de données (21 jours) : Tracez comment les données circulent à travers les prompts, le fine-tuning et les systèmes de récupération (RAG). Identifiez où les données sensibles entrent et sortent.

- Établir la limitation de finalité (18 jours) : Pour chaque champ de données, définissez clairement son usage et sa base légale. C'est ici que vous éviterez les amendes pour usage abusif.

- Implémenter les contrôles techniques (35 jours) : Mettez en place les filtres d'accès, la surveillance en temps réel et les mécanismes de blocage des prompts à risque.

- Créer les traces d'audit (12 jours) : Assurez-vous que chaque interaction est enregistrée de manière immuable pour répondre aux inspections réglementaires futures.

Comptez 6 à 9 mois pour former vos équipes à ces exigences spécifiques. 82 % des responsables de conformité rapportent avoir besoin d'une formation croisée entre le droit de la protection des données et les concepts techniques de l'IA.

Piéges à éviter et bonnes pratiques

Le piège numéro un ? Penser que la conformité est terminée après le déploiement initial. Les modèles évoluent, les prompts changent, et les régulations se durcissent. La conformité LLM est un processus continu.

Un autre danger majeur est l'« injection de prompt ». Aucune défense unique n'est suffisante. Vous devez combiner la sanitization des entrées, la validation des sorties et une surveillance continue. Même avec ces couches, certains contournements restent possibles, d'où l'importance des limites contextuelles strictes.

Enfin, méfiez-vous des définitions floues. Dans 17 des 20 États américains ayant des lois sur la vie privée, la notion de « normes de sécurité raisonnables » reste vague. Cela crée une incertitude juridique. Documentez toutes vos décisions techniques pour justifier votre démarche face aux autorités.

Quelles sont les sanctions principales pour non-conformité LLM en 2026 ?

En Europe, le RGPD permet des amendes jusqu'à 4 % du chiffre d'affaires mondial annuel ou 20 millions d'euros. La Loi IA ajoute des restrictions commerciales pour les systèmes à haut risque non conformes. Aux États-Unis, les amendes varient selon les États, avec des pénalités quotidiennes (comme les 200 $/jour en Californie) et des actions potentielles des procureurs généraux pour pratiques trompeuses.

Dois-je obtenir un consentement explicite pour entraîner un LLM sur mes données clients ?

Oui, dans la plupart des cas. Le RGPD et les nouvelles lois étatiques exigent généralement un consentement explicite pour l'entraînement de modèles sur des données personnelles. L'utilité opérationnelle ne suffit pas pour couvrir l'usage des données à des fins d'entraînement ou de fine-tuning public.

Comment gérer la conformité LLM avec des systèmes legacy existants ?

74 % des organisations rencontrent des problèmes de compatibilité. La solution consiste souvent à créer des middleware personnalisés qui isolent les données sensibles avant qu'elles n'atteignent les pipelines LLM modernes. Priorisez la segmentation des données et l'anonymisation côté source.

Quelle est la différence entre une EIPD standard et une évaluation pour LLM ?

Une EIPD standard évalue les risques généraux de traitement. Pour les LLM, le CEPD recommande des mesures techniques additionnelles ciblant les risques spécifiques comme la mémorisation involontaire de données, les fuites via les prompts et les biais algorithmiques difficiles à détecter post-hoc.

Combien de temps faut-il pour mettre en place un programme de conformité LLM complet ?

Comptez environ 6 à 9 mois pour atteindre une maturité opérationnelle. Cela inclut l'inventaire des actifs, le mapping des données, la mise en place des contrôles techniques et la formation des équipes. Les entreprises qui négligent la phase de surveillance continue voient leurs efforts compromis rapidement.