Imaginez un algorithme qui décide si vous obtenez un prêt immobilier ou si un candidat est retenu pour un poste de direction, simplement en analysant des motifs statistiques. C'est la réalité actuelle avec les grands modèles de langage. Le problème ? Ces systèmes ne "comprennent" rien du tout. Ils prédisent le mot suivant le plus probable, sans aucune notion de morale ou de vérité. Confier des décisions critiques à une machine sans contrôle, c'est accepter que des erreurs probabilistes deviennent des injustices sociales.

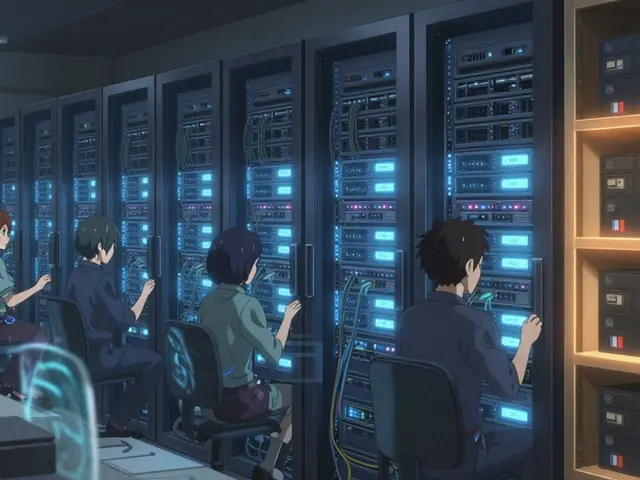

Pour éviter que l'IA ne devienne une "boîte noire" décisionnelle, la surveillance humaine est un processus continu et multicouche visant à superviser le cycle de vie des modèles d'IA pour garantir la sécurité, l'éthique et la conformité réglementaire . Ce n'est pas une simple option de sécurité, mais une nécessité absolue pour pallier l'absence de raisonnement moral des machines.

Pourquoi les LLM ne peuvent pas décider seuls

Un LLM (Large Language Model) fonctionne sur des probabilités, pas sur des faits vérifiés. Cela crée un risque majeur : les hallucinations. C'est le moment où l'IA invente une information avec une assurance totale. Dans le journalisme ou le diagnostic médical, une telle erreur peut être catastrophique.

Pour qu'un système soit acceptable dans un contexte à enjeux élevés, il doit répondre à cinq critères stricts :

- La responsabilité : Ne pas fournir d'informations dangereuses.

- L'équité : Ne pas propager de préjugés discriminatoires.

- La traçabilité : Pouvoir justifier une réponse par des faits concrets.

- La fiabilité : Donner la même réponse pour des requêtes similaires.

- La gouvernabilité : Avoir un comportement prévisible.

Le combat contre les biais dès la source

L'IA apprend sur le web, et le web est rempli de clichés et de préjugés. Si on laisse un modèle apprendre sans filtre, il ne fera pas que répéter les biais sociétaux, il les amplifiera. C'est là qu'intervient la curation des données. Des humains doivent trier et annoter les jeux de données pour supprimer les contenus offensants ou équilibrer les perspectives.

L'utilisation de techniques comme l'augmentation de données contrefactuelles (modifier un genre ou une origine dans un texte pour voir si l'IA change sa décision) permet de tester la robustesse du modèle. Les outils automatisés aident, mais seul un humain peut saisir la nuance entre une représentation juste et un stéréotype harmful.

L'apprentissage par le feedback humain (RLHF)

L'une des méthodes les plus efficaces pour aligner l'IA sur nos valeurs est le RLHF (Reinforcement Learning from Human Feedback). Concrètement, des évaluateurs humains classent plusieurs réponses générées par l'IA, indiquant laquelle est la plus utile, la plus honnête et la moins toxique.

| Étape | Action Humaine | Objectif |

|---|---|---|

| Fine-tuning supervisé | Écriture de réponses idéales | Montrer au modèle le standard de qualité |

| Apprentissage par renforcement | Classement de plusieurs sorties IA | Ajuster le modèle de récompense selon les préférences humaines |

Ce cycle itératif permet de réduire la toxicité et d'orienter le modèle vers des comportements plus éthiques. Cependant, même avec le RLHF, le risque de biais persiste car les évaluateurs humains ont eux-mêmes leurs propres préjugés.

Surveillance en temps réel et architectures de contrôle

La surveillance ne s'arrête pas après l'entraînement. Une fois déployé, un modèle peut dériver ou être manipulé. On distingue généralement deux types d'intervention :

- Human-in-the-Loop (HITL) : L'humain valide chaque décision avant qu'elle ne soit appliquée. C'est indispensable pour les décisions critiques (ex: diagnostic médical).

- Human-on-the-Loop (HOTL) : L'humain surveille le système global et n'intervient que si un signal d'alerte est déclenché.

L'idée est de créer une architecture d'escalade. Si l'IA est très confiante et que le risque est faible, elle procède. Mais si le score de confiance chute ou si des mots-clés sensibles apparaissent, le système bloque la décision et l'envoie automatiquement vers un expert humain. Cette approche évite l'épuisement des équipes tout en maintenant la sécurité.

Les limites des mesures automatisées

On utilise souvent des scores comme le BERTScore pour mesurer la similarité sémantique ou FactCC pour la cohérence factuelle. C'est utile pour le tri rapide, mais c'est insuffisant. Un texte peut être sémantiquement proche de la vérité tout en étant factuellement faux ou subtilement malveillant.

C'est particulièrement vrai pour les utilisateurs vulnérables qui pourraient croire aveuglément une IA. L'expertise humaine reste la seule méthode capable de détecter le manque de logique ou l'absence de contexte social. On peut utiliser des modèles comme Llama ou Mistral pour aider à la vérification, mais le juge final doit être un humain.

Responsabilité juridique et éthique

Un point fondamental : une IA peut prendre une décision, mais elle ne peut pas en être tenue responsable. On ne peut pas envoyer un algorithme au tribunal ou lui demander des dommages et intérêts. La surveillance humaine est donc le seul pont possible vers la responsabilité juridique.

Les réglementations commencent à s'imposer, mais la loi seule ne suffit pas. Il faut des mécanismes de gouvernance interne : des logs d'audit transparents, des justifications écrites pour chaque décision assistée par IA et une possibilité pour l'utilisateur final de contester la décision auprès d'un humain.

Qu'est-ce qu'une hallucination dans un LLM ?

Une hallucination se produit lorsque le modèle génère une information factuellement fausse mais la présente avec un ton convaincant. Cela arrive car le modèle prédit des séquences de mots probables plutôt que de consulter une base de données de faits vérifiés.

Le RLHF élimine-t-il complètement les biais ?

Non, le RLHF réduit les biais visibles et toxiques, mais il peut introduire de nouveaux biais basés sur les préférences des annotateurs humains. C'est pour cela que la surveillance doit être continue et diversifiée.

Quelle est la différence entre HITL et HOTL ?

Le Human-in-the-Loop (HITL) implique que l'humain est une étape obligatoire du processus de décision. Le Human-on-the-Loop (HOTL) signifie que l'humain supervise le système et intervient seulement pour corriger des erreurs ou ajuster les paramètres.

Pourquoi les métriques comme BERTScore ne suffisent-elles pas ?

Ces métriques mesurent la proximité mathématique entre des vecteurs de mots, pas la vérité ou la logique. Un texte peut être statistiquement correct tout en étant dangereux ou faux dans le monde réel.

L'IA peut-elle être responsable juridiquement ?

Non. La responsabilité légale requiert une intention et une personnalité juridique. Seuls les concepteurs, les opérateurs ou les superviseurs humains peuvent être tenus responsables des dommages causés par un système d'IA.

Prochaines étapes pour les organisations

Si vous déployez des LLM pour des processus critiques, ne vous contentez pas d'un filtre de mots interdits. Commencez par cartographier vos points de risque : où une erreur de l'IA pourrait-elle causer un préjudice réel ? Mettez en place un système de signalement simple pour que vos utilisateurs puissent flagger les réponses suspectes.

L'objectif n'est pas de ralentir l'innovation, mais de construire une confiance durable. En intégrant l'humain non pas comme un frein, mais comme un guide, on transforme un outil probabiliste en un partenaire décisionnel fiable.