Imaginez un développeur pressé. Il a une deadline dans deux heures. Au lieu d'attendre la validation de son ticket ou de naviguer dans les lourds processus internes, il ouvre un outil d'intelligence artificielle non approuvé. En quelques clics, il génère du code complexe. C'est rapide, c'est efficace, mais personne ne sait ce que ce code fait exactement avec les données de l'entreprise. Ce scénario n'est plus une hypothèse ; c'est la réalité de mai 2026 pour une grande partie des organisations. On appelle cela l'IA fantôme, qui désigne l'utilisation non autorisée d'outils d'intelligence artificielle par les employés sans approbation officielle ni supervision centrale. Le phénomène prend une forme particulièrement visible avec le Vibe Coding, défini comme la génération rapide de code via des outils d'IA sans examen rigoureux préalable.

Ce n'est pas une question de malveillance. Vos équipes ne cherchent pas à nuire. Elles cherchent simplement à réduire la friction. Quand les chemins officiels ralentissent la productivité, les employés trouvent des raccourcis externes. Le problème, c'est que ces raccourcis créent des risques invisibles qui échappent aux équipes de sécurité centrales.

L'étendue du problème en 2026

Le déploiement de l'IA par les unités commerciales est aujourd'hui beaucoup plus rapide que la capacité des services de sécurité à surveiller, auditer ou contrôler ces activités. Les chiffres récents montrent une adoption massive. Selon le dernier rapport sur l'état de la sécurité de l'information, 37 % des organisations au Royaume-Uni et aux États-Unis admettent que leurs employés utilisent déjà des outils d'IA générative sans permission officielle. Cela ressemble beaucoup au vieux concept de "Shadow IT" (comme utiliser Trello personnellement), mais avec un profil de risque bien plus élevé.

Les menaces sont concrètes. Dans les douze derniers mois, 26 % des organisations concernées ont été victimes d'un empoisonnement de données IA. Les attaquants ciblent directement les ensembles d'entraînement, corrompent subtilement les modèles ou insèrent des portes dérobées cachées. Environ un tiers des responsables interrogés considèrent désormais l'IA fantôme comme une menace sérieuse pour leur organisation. La vitesse à laquelle les pipelines et les modèles sont déployés crée un déficit de gouvernance continu.

Pourquoi le Vibe Coding change les règles du jeu

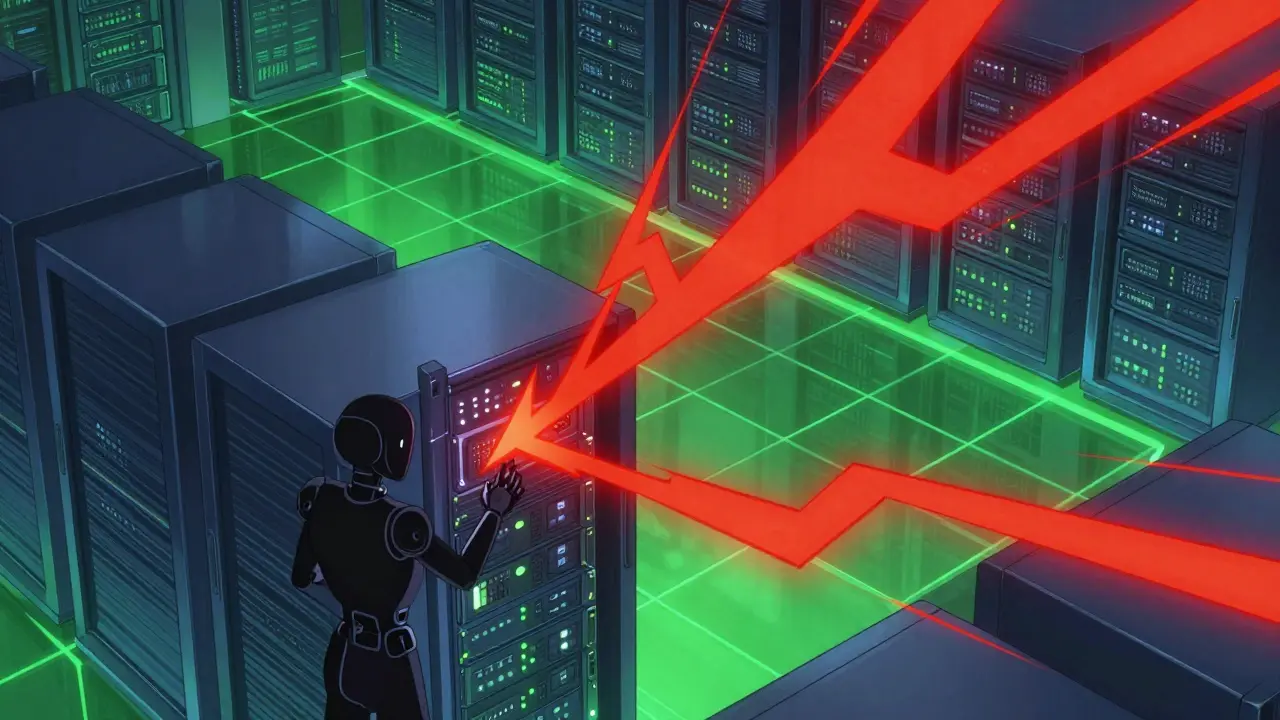

Contrairement aux anciens outils non autorisés qui restaient souvent isolés, le Vibe Coding interagit directement avec vos systèmes critiques. Nicole Carignan, Vice-présidente senior chez Darktrace, pointe un problème fondamental : rien ne se trouve entre les outils d'IA et vos systèmes de production. Les analystes de l'industrie appellent cela un "rayon d'explosion illimité".

Un tableau de bord non autorisé peut rester discret. Un agent de codage IA, lui, peut supprimer une base de données de production en moins de 10 secondes. Prenons l'exemple de la faille chez Vercel en avril 2026. Elle n'a pas été causée par une exploitation sophistiquée ou une vulnérabilité zero-day inconnue. Elle a résulté d'accès OAuth accordés à un outil d'IA non sanctionné, lui donnant des permissions directes sur des infrastructures critiques. Le code généré par IA n'est pas prêt pour la production par défaut. Il manque souvent de considérations de sécurité, de contrôles d'accès appropriés et de contexte d'entreprise.

| Caractéristique | Shadow IT Traditionnel | IA Fantôme / Vibe Coding |

|---|---|---|

| Exemple typique | Outils de communication personnels (Slack, Teams) | Générateurs de code IA, agents autonomes |

| Niveau d'accès | Souvent limité aux données utilisateur | Potentiellement direct sur les bases de données et infrastructures |

| Risque principal | Fuite d'informations, perte de productivité | Suppression de données, injection de prompts, portes dérobées |

| Visibilité | Partiellement détectable via les flux réseau | Très difficile à tracer sans surveillance spécifique des endpoints |

La solution n'est pas l'interdiction

Tenter de bannir purement et simplement les outils de codage IA est une erreur stratégique. Les gains de productivité sont tout simplement trop importants. Les développeurs peuvent livrer en quelques heures ce qui prenait auparavant des semaines de travail. Interdire ces outils pousse simplement l'activité dans les coulisses, là où vous avez encore moins de visibilité.

À la place, l'objectif doit être de canaliser ces outils vers des plateformes gouvernées. Chaque action, qu'elle soit initiée par un humain ou générée par une IA, doit passer par les mêmes systèmes de contrôle d'accès basés sur les rôles, les politiques organisationnelles et les journaux d'audit. Cette approche permet de rendre l'activité pilotée par l'IA et les mouvements de données visibles en temps réel. Vous ne cherchez plus seulement à appliquer une politique restrictive, mais à comprendre ce qui se passe vraiment.

Implémenter une gouvernance effective

La première étape est de combler les lacunes de visibilité. Très peu d'entreprises peuvent affirmer avec certitude quelles charges de travail IA tournent actuellement, qui les a autorisées, à quelles données elles accèdent ou comment les modèles se comportent. Pour les Directeurs de la Sécurité de l'Information (CISO), la priorité doit passer de l'arrêt total de l'usage à la garantie que les données circulant via l'IA restent visibles, contrôlées et protégées.

La surveillance en temps réel du comportement des agents est critique. La plupart des organisations ont actuellement zéro visibilité sur l'activité des outils d'IA non sanctionnés. Vous devez mettre en place des cadres de gouvernance qui exigent des revues strictes du code généré par IA, le traitant au même titre que le code écrit par l'homme. Cela inclut des tests approfondis et des traçabilités complètes.

Une référence clé apparaît sur la scène internationale : la norme ISO 42001, qui constitue une norme internationale fournissant des directives structurées pour la mise en œuvre de la gouvernance de l'IA. Ce cadre aide les entreprises à gérer l'IA de manière responsable. Cependant, la conformité technique ne suffit pas. La maturité en matière de sensibilisation à la cybersécurité est essentielle. Les équipes doivent comprendre non seulement comment construire des systèmes, mais aussi comment les sécuriser dès le départ. Comme le souligne un expert du secteur : "Sinon, le Vibe Coding devient du Vibe Hacking". Le principe doit imiter les pratiques de sécurité du bâtiment : la sécurité doit être conçue dès le début, et non abordée de manière rétroactive.

Checklist pour sécuriser votre environnement IA

- Auditez votre paysage actuel : Identifiez quels outils d'IA sont utilisés sur les endpoints et navigateurs, même s'ils ne passent pas par le pare-feu central.

- Unifiez les accès : Assurez-vous que tous les agents IA opèrent via des comptes avec des permissions limitées et auditables, jamais avec des droits administratifs complets.

- Intégrez la sécurité dans le pipeline : Traitez le code généré par IA avec les mêmes exigences de revue de sécurité et de test que le code humain.

- Surveillez les flux de données : Mettez en place des alertes pour détecter quand des données sensibles quittent l'environnement contrôlé vers des API tierces.

- Formez aux risques spécifiques : Éduquez les développeurs sur les injections de prompts et les risques d'empoisonnement des données, pas seulement sur les bonnes pratiques générales.

La plupart des organisations ont atteint un point où un certain niveau d'utilisation non sanctionnée de l'IA est inévitable. Traiter cela comme quelque chose qui peut être entièrement éliminé conduit souvent à des angles morts plutôt qu'à un meilleur contrôle. Le véritable défi pour les leaders de la sécurité n'est plus d'imposer un contrôle strict, mais d'obtenir la visibilité nécessaire pour comprendre comment l'IA est réellement utilisée et où les données sensibles se déplacent en temps réel. L'objectif final est d'identifier le risque au moment où il se produit et d'agir avant que les données ne soient exposées.

Qu'est-ce que le Vibe Coding exactement ?

Le Vibe Coding est une pratique consistant à générer rapidement du code à l'aide d'outils d'intelligence artificielle, souvent sans passer par des étapes rigoureuses de révision, de test ou de validation de sécurité traditionnelles. Il met l'accent sur la vitesse et l'intuition plutôt que sur la méthodologie stricte.

Pourquoi l'IA fantôme est-elle plus dangereuse que le Shadow IT classique ?

L'IA fantôme interagit directement avec les systèmes de production et les bases de données. Contrairement à un outil de gestion de projet non autorisé qui reste généralement isolé, un agent IA peut exécuter des commandes destructrices, modifier des configurations critiques ou exfiltrer des données massives en quelques secondes si ses permissions ne sont pas correctement restreintes.

Comment puis-je détecter l'utilisation d'outils IA non autorisés ?

Vous devez implémenter une surveillance des endpoints, analyser les flux de trafic sortant vers des API connues de services IA, et examiner les journaux d'accès aux repositories de code. La visibilité en temps réel sur les comportements des agents et les mouvements de données est essentielle pour identifier ces activités cachées.

La norme ISO 42001 aide-t-elle à résoudre ce problème ?

Oui, la norme ISO 42001 fournit un cadre structuré pour la gouvernance de l'IA. Elle guide les entreprises sur la manière de mettre en place des processus de gestion des risques, de transparence et de responsabilité liés à l'utilisation de l'intelligence artificielle, contribuant ainsi à réduire les risques associés à l'IA fantôme.

Devrais-je interdire l'accès aux outils de codage IA ?

Non, l'interdiction totale est contre-productive car elle pousse l'usage dans la clandestinité, augmentant les risques. Il est préférable de fournir des plateformes gouvernées où les outils IA peuvent être utilisés de manière productive tout en étant soumis aux mêmes contrôles de sécurité, audits et politiques d'accès que le reste de l'infrastructure.