Déploiement sécurisé : Comment livrer de l'IA sans risques

Quand vous déployez une déploiement sécurisé, le processus qui permet de mettre en production un modèle d'intelligence artificielle tout en garantissant sa fiabilité, sa conformité et sa résistance aux attaques. Also known as mise en production sécurisée, it is not just about code working—it’s about making sure it won’t break, leak data, or make dangerous decisions when it’s live. Beaucoup pensent que si le modèle fonctionne en test, il est prêt. C’est une erreur coûteuse. Le vrai déploiement sécurisé, c’est ce qui sépare les projets qui réussissent de ceux qui finissent en incident de sécurité ou en perte de confiance des utilisateurs.

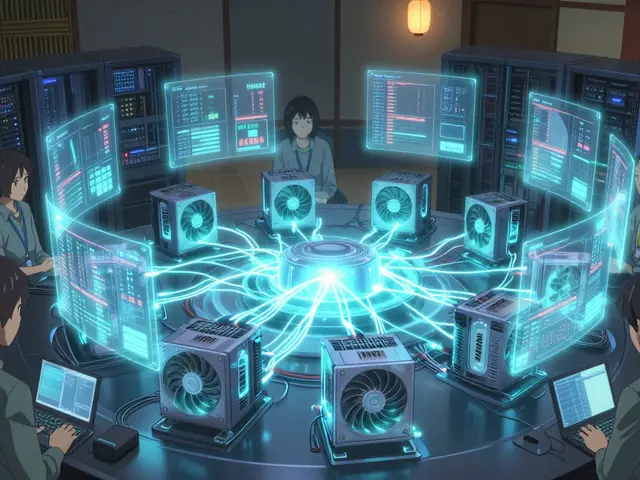

Vous ne déployez pas juste un modèle. Vous déployez un système d’IA générative, un ensemble de composants logiciels, de données, d’interfaces et de processus humains qui prennent des décisions autonomes. Also known as agent IA, it can write emails, approve loans, or even suggest medical treatments. Et chaque fois que vous le mettez en production, vous introduisez un nouveau point de rupture. Les vérifications AI, des tests formels et automatisés qui valident que le modèle respecte des contraintes de sécurité, de précision et d’éthique. Also known as audits AI, it ensures the model doesn’t hallucinate, leak secrets, or discriminate. Et les audits AI, des évaluations indépendantes, souvent externes, qui vérifient la conformité aux normes et aux réglementations. Also known as évaluation de risque IA, they’re not optional anymore—especially if you’re in finance, health, or public services. Ces deux éléments sont les piliers du déploiement sécurisé. Sans eux, vous livrez du code qui marche… mais qui pourrait vous ruiner.

Le déploiement sécurisé ne se limite pas à la technologie. Il inclut aussi la DevSecOps, la pratique qui intègre la sécurité dès la phase de développement, en automatisant les contrôles dans les pipelines CI/CD. Also known as sécurité intégrée, it means running security tests every time someone pushes code—even if that code was generated by an AI. C’est ce que font les meilleures équipes : elles ne laissent pas l’IA écrire du code et l’envoyer en production sans vérifier s’il contient des clés API exposées, des validations manquantes, ou des biais cachés. Et elles le font sans ralentir la vitesse. Parce que le déploiement sécurisé, ce n’est pas un frein. C’est une assurance. Une assurance que votre IA ne va pas faire de dégâts quand elle sera utilisée par des milliers de personnes.

Dans cette collection, vous trouverez des guides concrets sur comment vérifier vos agents IA, comment réagir après une refactorisation par l’IA, comment éviter les modules orphelins, et comment construire des checklists de sécurité pour le code généré. Vous verrez comment des entreprises réelles ont évité des fuites de données, comment elles ont mis en place des revues humaines pour les décisions critiques, et comment elles ont équilibré vitesse et sécurité. Ce n’est pas de la théorie. C’est ce que vous devez faire demain matin.