Gouvernance logicielle : Comment encadrer le code généré par l'IA sans ralentir les équipes

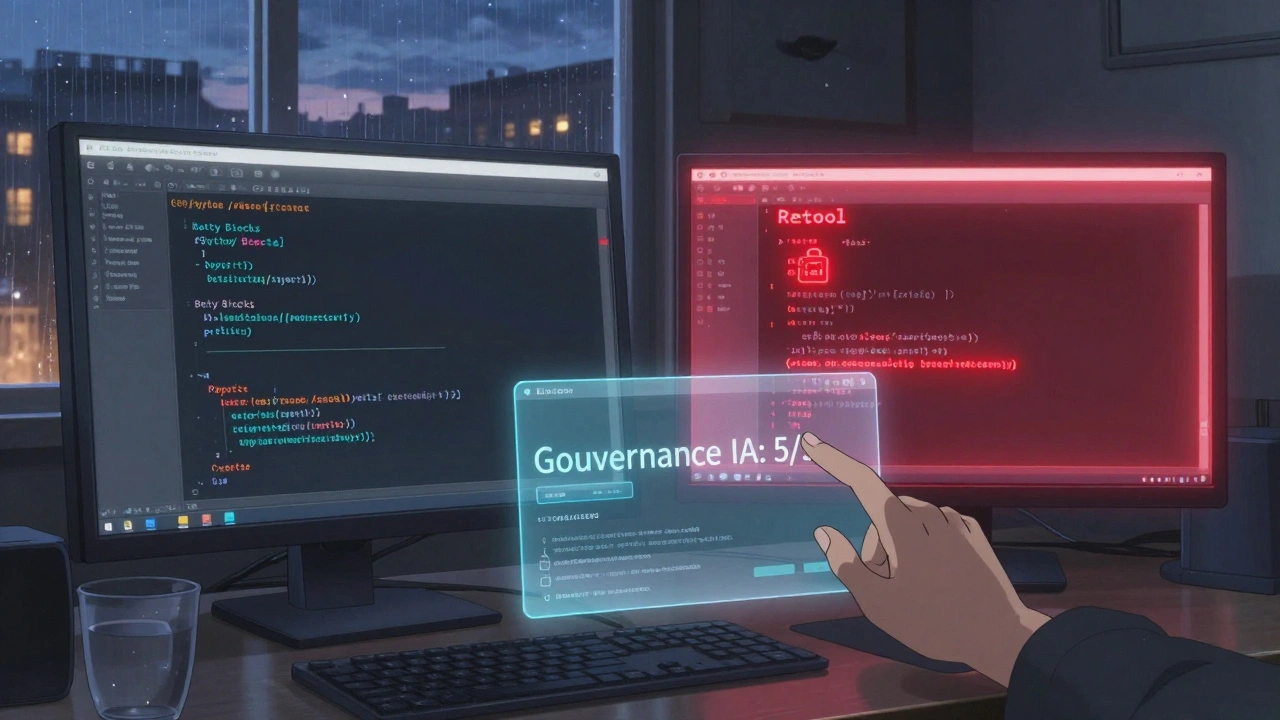

Quand l'IA écrit du code, qui en est responsable ? La gouvernance logicielle, l'ensemble des règles, rôles et processus qui assurent la qualité, la sécurité et la traçabilité du code dans une organisation. Also known as gestion du code IA, it n'est plus une option pour les équipes qui utilisent l'IA pour développer. Ce n'est plus juste une question de normes ou de politiques internes — c'est une question de survie. Un module orphelin, une clé API exposée, un modèle déprécié sans plan de sortie : ces failles ne viennent pas toujours des développeurs. Elles viennent de l'IA. Et si personne n'est désigné pour les surveiller, elles passent inaperçues jusqu'à ce qu'elles cassent tout.

La gestion du cycle de vie modèle, le processus qui suit un modèle d'IA depuis son déploiement jusqu'à sa retraite, en passant par les mises à jour et les audits est directement liée à la gouvernance logicielle. Quand vous déployez un modèle de langage, vous ne lancez pas juste un outil — vous lancez une dépendance. Et si OpenAI ou Meta retirent une version, votre application tombe en panne. La LLMOps, l'ensemble des pratiques pour opérer les modèles de langage en production, comme le monitoring, le rollback et la gestion des versions n'est pas un mot à la mode. C'est la colonne vertébrale de toute gouvernance sérieuse. Sans elle, le vibe coding devient une bombe à retardement. Et pourtant, beaucoup pensent encore que la gouvernance, c'est ralentir. C’est l’inverse. C’est ce qui permet de courir sans se casser la jambe.

Vous ne pouvez pas contrôler chaque ligne de code générée par l'IA. Mais vous pouvez contrôler qui est responsable, quand une modification est validée, et comment on détecte les risques avant qu’ils ne deviennent des incidents. Les checklists de sécurité, les SLA avec les fournisseurs d’IA, les tests de régression après une refactorisation — ce ne sont pas des étapes de bureaucratie. Ce sont des pare-feux. Et ils doivent être intégrés dans le flux de travail, pas ajoutés en fin de course. La bonne gouvernance ne tue pas la vitesse. Elle la rend durable.

Dans cette collection, vous trouverez des guides concrets pour mettre en place cette gouvernance sans sacrifier la productivité. Des stratégies pour éviter les modules orphelins, des modèles de propriété du code, des checklists pour vérifier le code généré par l'IA, des méthodes pour communiquer la gouvernance sans frustrer vos développeurs. Vous verrez comment des équipes réelles ont réussi à équilibrer innovation et contrôle. Pas de théorie. Pas de jargon. Juste ce qui marche.