Modèles ouverts : Ce qu'il faut savoir sur les IA accessibles, auditables et éthiques

Quand on parle de modèles ouverts, des systèmes d'intelligence artificielle dont le code, les poids et les données d'entraînement sont publiquement disponibles pour inspection et réutilisation. Also known as IA open-source, ils sont la contrepartie concrète de la transparence dans un monde où la plupart des IA sont des boîtes noires. Ce n'est pas juste un avantage technique — c'est une question de responsabilité. Sans eux, vous ne pouvez pas vérifier si un modèle est biaisé, s'il fuit des données sensibles, ou s'il a été entraîné avec du contenu volé. Les modèles ouverts permettent à n'importe qui — développeur, auditeur, chercheur — de regarder sous le capot.

Et ce n’est pas qu’une question d’éthique. Les benchmarks IA, des jeux de tests standardisés pour mesurer la performance des modèles sur des tâches réelles ne sont utiles que si vous pouvez les appliquer à des modèles que vous contrôlez. Si vous utilisez un modèle fermé, vous ne savez pas comment il a été évalué, ni si les résultats sont réplicables. Les évaluations des modèles, les méthodes pour mesurer la précision, la sécurité, la latence et la robustesse des IA ne fonctionnent pas en aveugle. Vous avez besoin de l’accès au modèle pour tester ses réponses dans des scénarios réels, pour détecter les hallucinations, les biais linguistiques ou les failles de sécurité. C’est pourquoi les équipes qui veulent déployer de l’IA en production — dans la santé, la finance ou la justice — choisissent de plus en plus des modèles ouverts. Ils ne veulent pas juste de la performance. Ils veulent de la confiance.

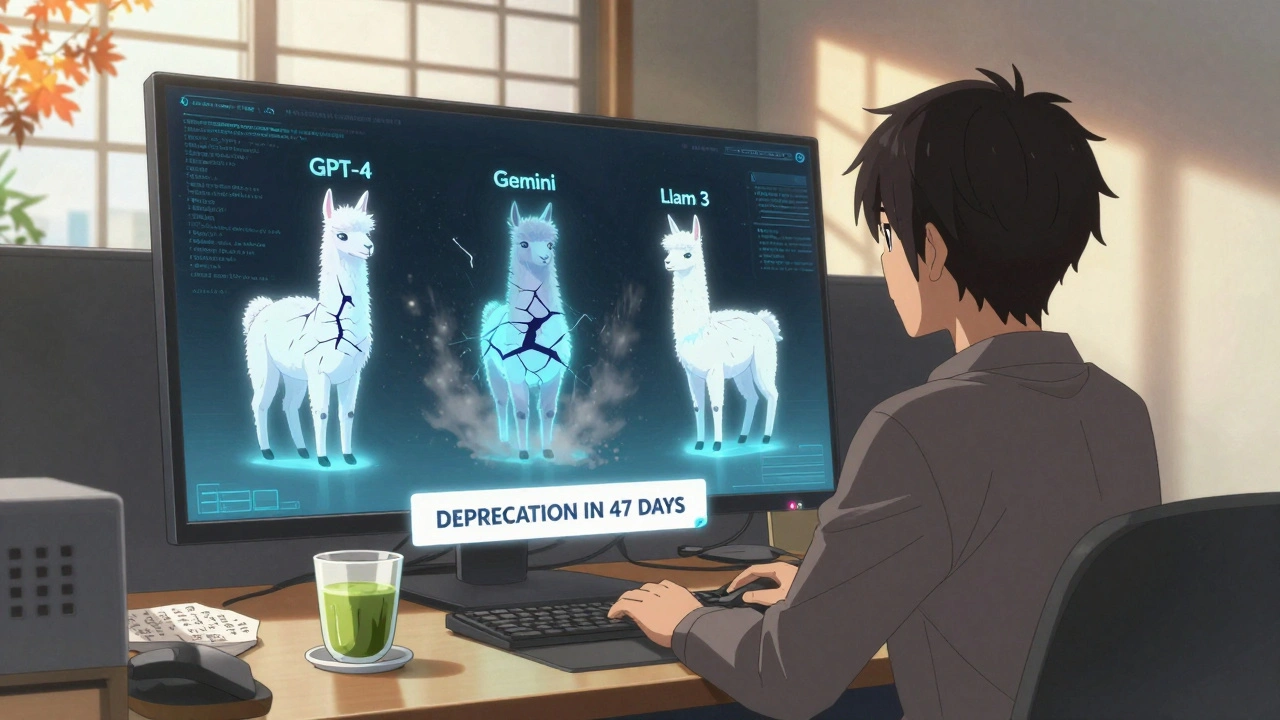

Les transparence IA, la capacité de comprendre et de vérifier comment une IA prend ses décisions n’est pas un luxe. C’est une exigence légale dans l’UE, et bientôt partout ailleurs. Les modèles ouverts sont la seule façon d’y répondre sans dépendre d’un fournisseur qui refuse de partager ses secrets. Et quand vous comprenez comment un modèle fonctionne, vous pouvez l’adapter, le compresser, le sécuriser, le faire tourner sur votre propre serveur. Vous n’êtes plus prisonnier d’un API payante qui peut disparaître demain.

La collection d’articles ci-dessous ne parle pas de théorie. Elle montre comment des équipes réelles utilisent les modèles ouverts pour éviter les pièges du vibe coding, auditer leurs agents IA, équilibrer les données multilingues, ou gérer les fournisseurs sans se faire piéger. Vous y trouverez des checklists, des benchmarks concrets, et des méthodes pour passer de la confiance aveugle à la confiance vérifiée. Ce n’est pas une mode. C’est la seule façon d’aller plus vite… sans vous brûler.