Sécurité des prompts : Protéger vos IA contre les attaques et les dérives

Quand vous tapez un prompt pour une IA générative, vous ne demandez pas juste une réponse — vous déclenchez une action. Et cette action peut être sécurité des prompts, l’ensemble des pratiques visant à empêcher les entrées malveillantes ou mal conçues de compromettre un modèle d’IA. Also known as ingénierie de prompts sécurisés, it is what separates a useful tool from a potential liability. Si votre prompt contient des données sensibles, des instructions ambiguës ou des pièges cachés, l’IA peut révéler des informations privées, générer du contenu toxique, ou même exécuter des actions non autorisées. Ce n’est pas de la science-fiction — c’est ce qui arrive chaque jour dans les entreprises qui négligent cette étape.

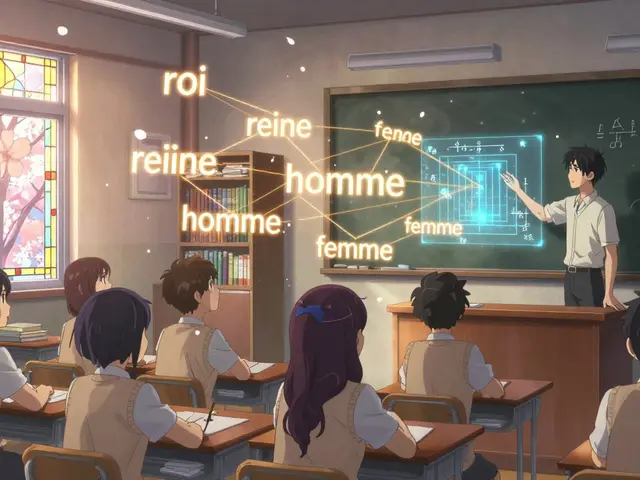

La ingénierie de prompts, la pratique de concevoir des instructions claires, précises et contrôlées pour guider le comportement d’une IA n’est pas qu’une question de formulation. C’est une discipline de sécurité. Un prompt mal conçu peut être exploité pour contourner les filtres, forcer une IA à imiter un utilisateur, ou extraire des données d’entraînement. C’est pourquoi les meilleures équipes utilisent des validations de prompts, des systèmes automatisés ou humains qui vérifient chaque entrée avant qu’elle n’atteigne le modèle. Ils testent les prompts contre des scénarios d’attaque connus, comme le jailbreaking, l’instruction hijacking ou la leakage de contexte. Ce n’est pas un bonus — c’est une exigence, surtout quand l’IA interagit avec des clients, des données personnelles ou des systèmes internes.

Vous ne pouvez pas faire confiance à l’IA pour se protéger toute seule. Les modèles sont conçus pour suivre les instructions, pas pour juger leur sécurité. C’est à vous de les encadrer. Les outils comme les sécurité des prompts checklists, les filtres d’entrée, les audits de réponses, et les boucles humaines sont les seuls boucliers fiables. Et ils ne sont pas réservés aux géants du tech — chaque équipe qui utilise l’IA générative doit les adopter. Que vous générerez du code, des emails, des scénarios ou des réponses client, un prompt non sécurisé est une porte ouverte. Les posts ci-dessous vous montrent exactement comment fermer ces portes : des checklists d’ingénieurs de vérification, des méthodes pour détecter les prompts malveillants, des cas réels où des failles ont été exploitées, et comment les équipes de production ont réagi. Vous ne trouverez pas ici des théories abstraites. Vous trouverez des actions concrètes, testées, et applicables dès aujourd’hui.