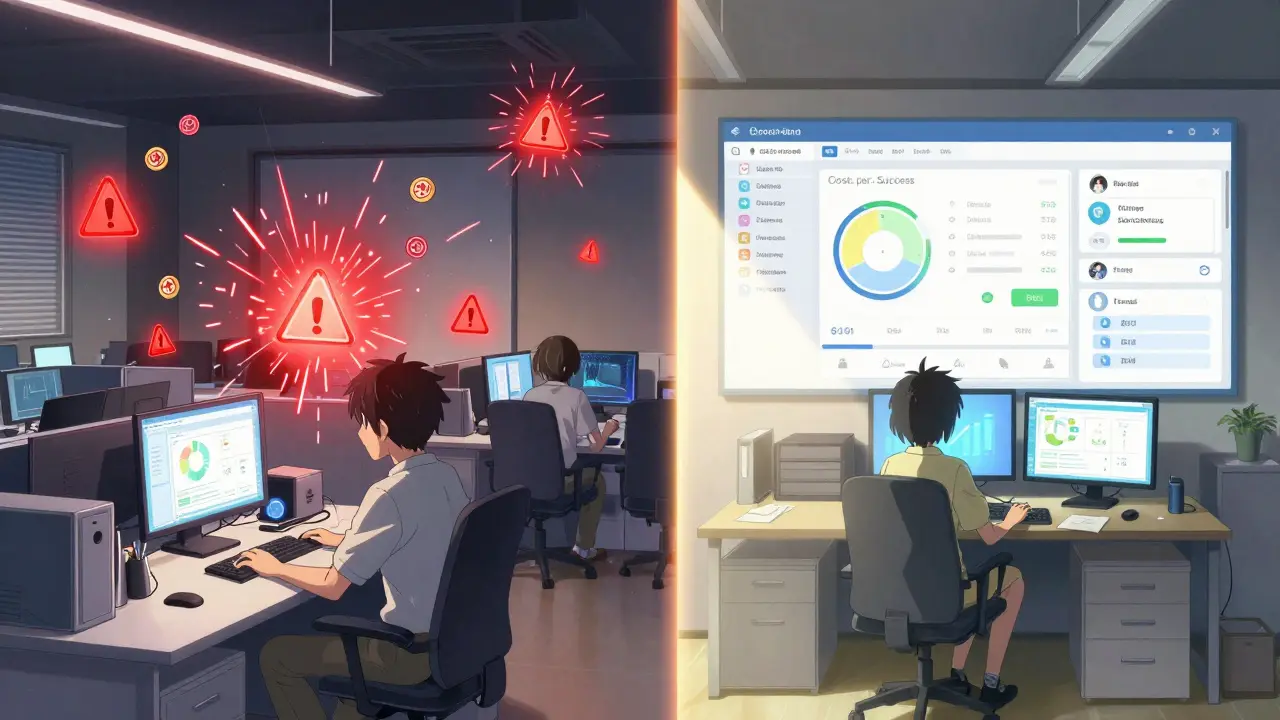

Les grandes entreprises dépensent des dizaines de milliers de dollars par mois en modèles de langage (LLM) sans savoir exactement où l’argent part. Un agent automatisé mal configuré peut faire exploser un budget en 24 heures. Une simple modification de prompt peut faire doubler la consommation de jetons sans améliorer la qualité. Sans un système de suivi clair, les coûts deviennent une bombe à retardement.

Les coûts des LLM ne sont pas un détail technique - c’est une question de survie financière

En 2026, mesurer les coûts des LLM n’est plus une option pour les équipes techniques. C’est une exigence fondamentale pour toute entreprise qui utilise ces modèles en production. Selon une analyse de Sentry publiée en avril 2025, 87 % des entreprises du Fortune 500 ont mis en place des outils d’observabilité des coûts. Pourquoi ? Parce que les chiffres parlent d’eux-mêmes : des cas documentés montrent des dépenses mensuelles dépassant 100 000 $ en quelques semaines, sans que personne ne s’en rende compte.

Le problème n’est pas le prix des API. C’est la complexité cachée. Un seul appel à GPT-4-Turbo coûte environ 0,0023 $ par requête - ça semble négligeable. Mais quand vous avez 50 000 requêtes par jour, ça fait 115 $ par jour. Et si chaque requête génère 3 000 jetons au lieu de 1 500 à cause d’un prompt mal optimisé ? Vous doublez votre facture. Sans suivi granulaire, vous ne voyez pas la fuite.

Cinq catégories de KPI qui comptent vraiment

Un bon tableau de bord ne montre pas juste combien vous avez dépensé ce mois-ci. Il vous dit pourquoi vous l’avez dépensé. Voici les cinq catégories de KPI essentiels, telles que définies par Portkey en janvier 2026 :

- Coûts par requête et par jeton : Le coût moyen par requête pour GPT-4-Turbo est de 0,0023 $. Pour Claude 3 Opus, c’est 2,7 fois plus cher par 1 000 jetons. Le coût par jeton pour GPT-3.5-Turbo est de 0,0000015 $. Ces chiffres ne sont pas des chiffres abstraits - ce sont vos lignes de défense.

- Coût par réussite : Combien coûte une requête qui aboutit à une réponse utile ? Pour les tâches de service client, la cible est de moins de 0,005 $ par réponse réussie. Si votre coût par succès dépasse ce seuil, vous payez pour des échecs.

- Attribution par équipe, produit et fournisseur : Votre service marketing utilise-t-il le même modèle que votre équipe d’ingénierie ? Qui consomme le plus ? Les données de Langfuse montrent que les 5 % d’utilisateurs les plus actifs consomment 68 % des ressources. Sans attribution, vous ne savez pas qui doit être tenu responsable.

- Détection d’anomalies : Une hausse de 30 % des coûts en une heure ? Un saut de 25 % dans le nombre de jetons sans changement fonctionnel ? Ces signaux doivent déclencher une alerte automatique. Portkey détecte les fuites de jetons causées par des modifications de prompts avec 94 % de précision.

- Taux de consommation du budget : Votre budget mensuel est de 50 000 $. À quel rythme le consommez-vous ? Une variation quotidienne supérieure à 3 % est un drapeau rouge. Les alertes à 85 % d’utilisation du budget sont les plus efficaces pour éviter les dépassements.

Les outils : plateformes commerciales, open source ou sur mesure ?

Vous avez trois choix pour mesurer vos coûts, et aucun n’est parfait.

- Plateformes commerciales (Portkey, Langfuse) : Elles coûtent 999 $ par mois ou plus, mais elles vous donnent des tableaux de bord prêts à l’emploi. Elles montrent où l’argent va - par équipe, par fonctionnalité, par fournisseur. 92 % des utilisateurs de Portkey disent qu’elles réduisent le temps d’attribution des coûts de 30 %. Leur force ? La détection d’anomalies intelligente et la corrélation entre coût et qualité.

- Open source (LangSmith, Phoenix) : Gratuit à démarrer, mais vous devez tout construire vous-même. Langfuse, en version open source, prend en moyenne 45 heures pour mettre en place un suivi basique. Si vous avez une équipe d’ingénierie solide, c’est une option. Mais vous risquez de manquer des indicateurs clés comme le coût par réussite.

- Solutions sur mesure : Beaucoup d’entreprises tentent de coder leur propre système. Selon une audit de Guru Startups en novembre 2025, 63 % de ces projets échouent à capturer le coût par réussite. Ils suivent les jetons, mais pas les résultats. C’est comme mesurer la consommation de carburant sans regarder si la voiture arrive à destination.

Les plateformes commerciales gagnent parce qu’elles comprennent un fait simple : le coût n’a de sens que s’il est lié à la performance. Si votre modèle coûte 0,01 $ par requête mais que 80 % des réponses sont inutiles, vous perdez de l’argent. Si un modèle à 0,003 $ par requête produit des réponses utiles dans 95 % des cas, vous gagnez.

Les erreurs les plus coûteuses que font les entreprises

Voici les trois erreurs qui font sauter les budgets :

- Suivre seulement les coûts au niveau du fournisseur : Si vous ne savez pas que c’est le service marketing qui utilise 70 % du budget de GPT-4-Turbo, vous ne pouvez pas agir. Meltwater a montré que 61 % des entreprises qui ne font pas d’attribution dépassent leur budget de 35 %.

- Ignorer les coûts de réessai : Un modèle qui échoue et recommence 3 fois ? Ça triple votre coût. Dans les systèmes mal optimisés, les réessais représentent 18 à 22 % des dépenses totales.

- Ne pas lier coût et qualité : Seuls 32 % des entreprises corrélient le coût avec la satisfaction utilisateur. Pourtant, les études montrent un retour sur investissement 5,7 fois plus élevé quand on le fait. Si votre chatbot coûte 0,004 $ par réponse, mais que 60 % des clients le quittent en colère, vous n’avez pas un bon outil - vous avez un gouffre financier.

Un cas réel : une entreprise de fintech a réduit ses coûts de 41 % en passant du suivi des jetons au suivi du coût par réussite. Une autre, dans le secteur de la santé, a coupé 28 % de ses dépenses en activant des alertes budgétaires par équipe. Ce n’est pas de la magie. C’est de la discipline.

Comment démarrer - pas à pas

Vous n’avez pas besoin d’un budget de 100 000 $ pour commencer. Voici comment faire en 2 à 4 semaines :

- Identifiez vos 3 applications LLM les plus critiques : Service client ? Génération de rapports ? Assistance interne ? Commencez par elles.

- Taggez chaque appel API : Ajoutez des métadonnées : équipe, fonctionnalité, type de requête. Sans cela, vous ne pouvez pas attribuer les coûts.

- Fixez des seuils d’alerte : Alertes à 85 % du budget mensuel. Alertes si le coût par requête augmente de plus de 15 % en 24 heures.

- Calculez le coût par réussite : Utilisez les feedbacks des utilisateurs ou les scores de qualité pour déterminer ce qui est une réponse utile. C’est le KPI le plus puissant.

- Partagez les données : Donnez accès au tableau de bord aux équipes finance, produit et ingénierie. La transparence crée la responsabilité.

Le futur : la mesure des coûts devient une compétence stratégique

En 2027, Gartner prévoit que le marché des outils de suivi des coûts LLM atteindra 1,2 milliard de dollars. Ce n’est pas une tendance - c’est une révolution. Les entreprises qui ne mesurent pas leurs coûts ne pourront pas justifier leurs investissements en IA. Elles seront exclues des décisions stratégiques.

Le MIT Sloan Review le dit clairement : les entreprises qui ne mesurent que les KPI marketing manquent 78 % des impacts financiers de l’IA. Le futur appartient aux équipes qui comprennent que l’efficacité ne se mesure pas seulement par la précision du modèle, mais par son rapport coût-résultat.

Les rôles comme "spécialiste de l’optimisation des coûts LLM" n’existaient pas en 2023. En 2028, 70 % des entreprises en auront un. Ce n’est pas une question de "est-ce qu’on doit le faire ?". C’est une question de "quand est-ce qu’on commence ?".

Quel est le coût moyen par requête pour GPT-4-Turbo en 2026 ?

En janvier 2026, le coût moyen par requête pour GPT-4-Turbo est de 0,0023 $. Ce chiffre varie légèrement selon la région et le volume d’utilisation, mais il sert de référence de base pour les entreprises. Pour comparer, Claude 3 Opus coûte environ 2,7 fois plus cher pour le même nombre de jetons.

Pourquoi le coût par jeton n’est-il pas suffisant ?

Parce que les jetons ne disent rien sur la qualité du résultat. Un modèle peut générer 10 000 jetons pour une réponse inutile, ou 500 jetons pour une réponse parfaite. Le coût par jeton vous dit combien vous avez dépensé. Le coût par réussite vous dit si vous avez obtenu de la valeur. C’est la différence entre compter les litres d’essence et compter les kilomètres parcourus.

Quelle est la meilleure façon de détecter une fuite de coûts ?

Regardez les anomalies : une hausse soudaine de 30 % des coûts en une heure, ou une augmentation de 25 % du nombre de jetons sans changement de fonctionnalité. Ces signaux indiquent souvent un boucle infinie, un prompt mal écrit, ou un agent qui redemande sans arrêt. Les outils comme Portkey utilisent l’apprentissage automatique pour détecter ces fuites avec 94 % de précision.

Les outils open source sont-ils une bonne alternative aux plateformes payantes ?

Ils peuvent l’être, mais seulement si vous avez une équipe technique expérimentée. LangSmith et Phoenix sont gratuits, mais vous devez construire vous-même les tableaux de bord, les alertes et la corrélation coût-résultat. La plupart des entreprises n’ont pas le temps ni les ressources pour cela. Les outils payants automatisent ces tâches critiques - ce qui en fait un meilleur investissement pour la plupart des équipes.

Comment savoir si mon équipe utilise les LLM de manière efficace ?

Regardez trois choses : le coût par réussite (doit être inférieur à 0,005 $ pour les tâches simples), le taux de réessai (doit être inférieur à 5 %), et le taux de consommation du budget (doit rester sous 3 % de variation quotidienne). Si ces trois indicateurs sont stables et dans la cible, votre équipe utilise les LLM de manière efficace. Sinon, il est temps d’investiguer.