Modèles de langage : Évaluer, optimiser et sécuriser les LLM en production

Les modèles de langage, des systèmes d’intelligence artificielle capables de comprendre et de générer du texte humain. Also known as LLM, they are the backbone of everything from chatbots to code generators. Mais un modèle qui parle bien n’est pas forcément un modèle qui fonctionne bien en production. Beaucoup croient que plus il a de paramètres, mieux c’est. Ce n’est pas vrai. Un modèle de 7 milliards de paramètres, bien ajusté et évalué, peut surpasser un modèle de 2 billions mal utilisé. Ce qui compte, c’est la qualité de l’évaluation, pas la taille du chiffre.

Les benchmarking LLM, des tests standardisés pour mesurer la performance des modèles sur des tâches réelles comme MMLU ou LiveBench ne sont pas des scores de prestige — ce sont des outils de décision. Si vous choisissez un modèle pour un service médical, vous ne testez pas sa capacité à écrire des poèmes. Vous vérifiez qu’il ne confond pas un symptôme avec un diagnostic. Les adaptation de domaine, l’ajustement précis d’un modèle pour un secteur spécifique comme le droit ou la santé sont souvent la clé. Un modèle généraliste, affiné sur des documents juridiques, devient plus fiable qu’un modèle plus gros mais non adapté.

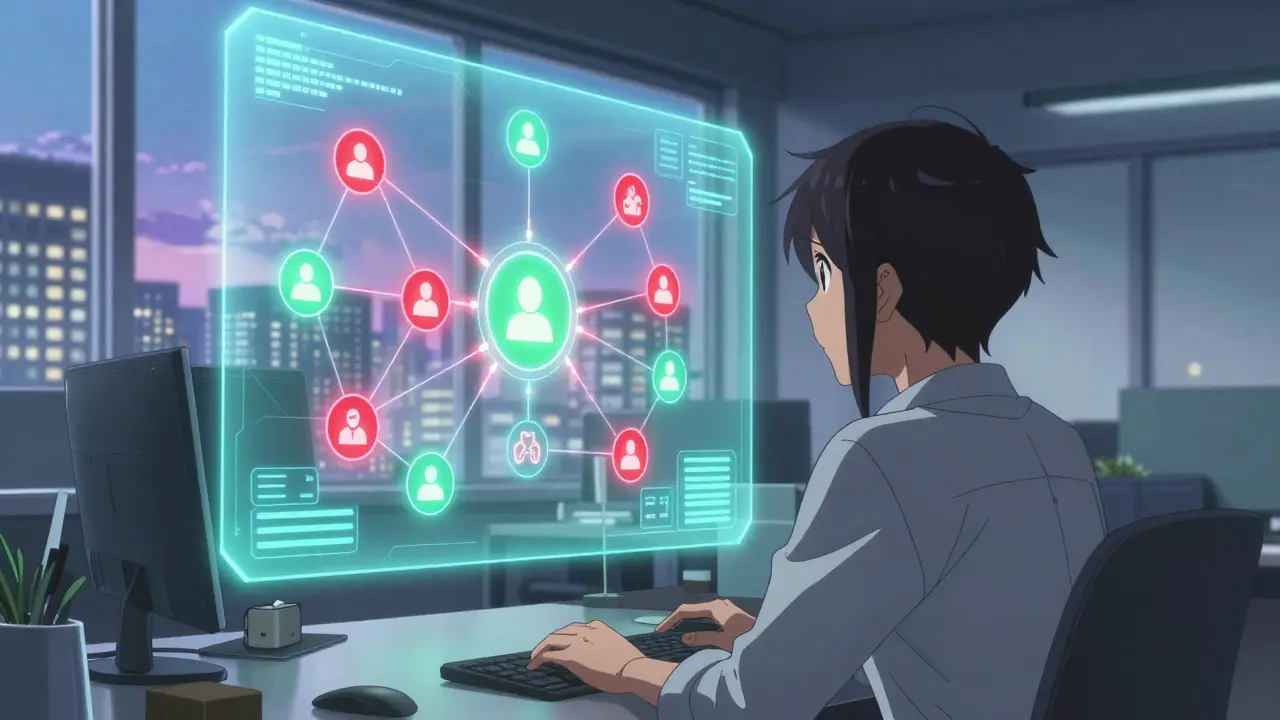

Et puis il y a la compression de modèle, la réduction de la taille d’un modèle sans perte majeure de performance. Beaucoup pensent que c’est une astuce pour économiser de la mémoire. C’est plus que ça. C’est une question de sécurité. Un modèle compressé peut être déployé localement, sans envoyer vos données à un serveur distant. Il peut aussi être mis à jour plus vite, sans couper le service. Et quand vous comprenez que la gestion du cycle de vie modèle, le processus de mise à jour, de dépréciation et de remplacement des modèles en production est aussi critique que son choix initial, vous réalisez que vous ne gérez pas un outil — vous gérez un actif vivant.

Vous ne pouvez pas ignorer non plus la hygiène des invites, la manière d’écrire les instructions données aux modèles pour éviter les erreurs et les hallucinations. Un bon modèle avec une mauvaise invite donne un mauvais résultat. Et dans les domaines sensibles — finance, santé, droit — ce n’est pas une erreur, c’est un risque légal. Les tests de régression de sécurité, les audits de conformité, les contrôles humains : tout cela s’empile pour protéger ce que les modèles de langage rendent vulnérable : la confiance.

Vous trouverez ici des guides concrets sur la façon de choisir entre compresser un modèle ou en adopter un autre, comment équilibrer les données pour les langues moins parlées, comment éviter les erreurs de sécurité dans le code généré par l’IA, et comment gérer les mises à jour sans casser vos applications. Ce n’est pas une liste de nouveautés. C’est un ensemble de règles éprouvées, tirées de l’expérience réelle de ceux qui déployent ces modèles tous les jours — et qui ont appris à la dure que la puissance ne suffit pas. La fiabilité, elle, se construit.