Stratégies de découpage qui améliorent la qualité de récupération dans les systèmes RAG pour grands modèles linguistiques

Renee Serda févr.. 28 9Les stratégies de découpage des documents dans les systèmes RAG déterminent la qualité des réponses des modèles linguistiques. Le découpage par page avec recouvrement est la méthode la plus efficace, selon des études récentes. Découvrez comment optimiser votre système pour éviter les hallucinations et améliorer la précision.

Plus d’infos

IA générative préservant la vie privée : chiffrement homomorphe et enclaves sécurisées

Renee Serda févr.. 27 5Le chiffrement homomorphe permet à l'IA générative de traiter des données sensibles sans jamais les déchiffrer. Une avancée majeure pour la santé, la finance et la protection de la vie privée, déjà en production en 2025.

Plus d’infos

Apprentissage Continuel dans l'IA Générative : S'Adapter Sans Oublis Catastrophiques

Renee Serda févr.. 26 8L'apprentissage continu dans l'IA générative permet aux modèles de s'adapter sans oublier ce qu'ils ont appris. Découvrez les méthodes les plus efficaces, les limites réelles et pourquoi Google Nested Learning change la donne en 2026.

Plus d’infos

Choix de conception des tokenizeurs et leur impact sur la qualité des grands modèles de langage

Renee Serda févr.. 25 9Le choix du tokenizer influence directement la précision, la vitesse et la capacité des grands modèles de langage. BPE, WordPiece et Unigram ont des impacts différents selon les données. Une mauvaise configuration peut réduire la performance de 15 %.

Plus d’infos

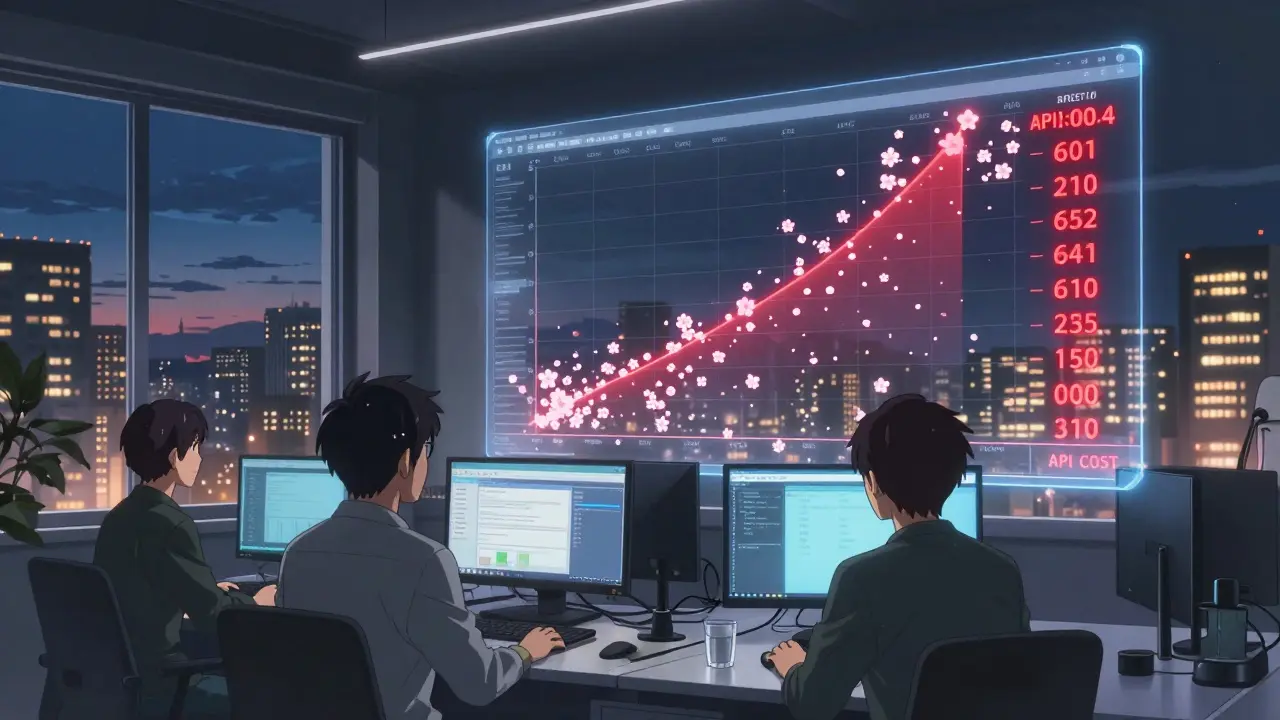

Comparer les modèles LLM open-source et les modèles gérés pour vos tâches

Renee Serda févr.. 24 7En 2026, les modèles LLM open-source rivalisent avec les API gérées en performance. Le vrai choix se fait sur le coût, la confidentialité et la complexité technique. Voici comment décider selon vos besoins.

Plus d’infos

Cycle de vie du contenu avec l'IA générative : création, révision, publication et archivage

Renee Serda févr.. 23 10L'IA générative transforme le cycle du contenu en un système vivant : création, révision, publication et archivage se connectent pour maintenir la pertinence, la crédibilité et la visibilité à long terme.

Plus d’infos

Image-to-Text en IA générative : descriptions, texte alternatif et accessibilité

Renee Serda févr.. 21 10L'IA générative permet de convertir des images en textes alternatifs pour l'accessibilité, mais ses erreurs peuvent être dangereuses. CLIP et BLIP offrent des progrès, mais la vérification humaine reste essentielle.

Plus d’infos

Compression et quantisation des grands modèles linguistiques : Les exécuter sur les appareils périphériques

Renee Serda févr.. 20 10Apprenez comment la compression et la quantisation permettent d'exécuter des modèles linguistiques puissants sur des appareils mobiles, avec des gains de taille, de vitesse et de confidentialité. Techniques récentes comme GPTVQ et TOGGLE révolutionnent l'IA locale.

Plus d’infos

Matériel Génératif IA de Nouvelle Génération : Accélérateurs, Mémoire et Réseaux en 2026

Renee Serda févr.. 19 10En 2026, l'IA générative repose sur des accélérateurs, de la mémoire HBM4 et des réseaux innovants. NVIDIA, AMD, Microsoft et Qualcomm se battent pour dominer cette infrastructure critique.

Plus d’infos

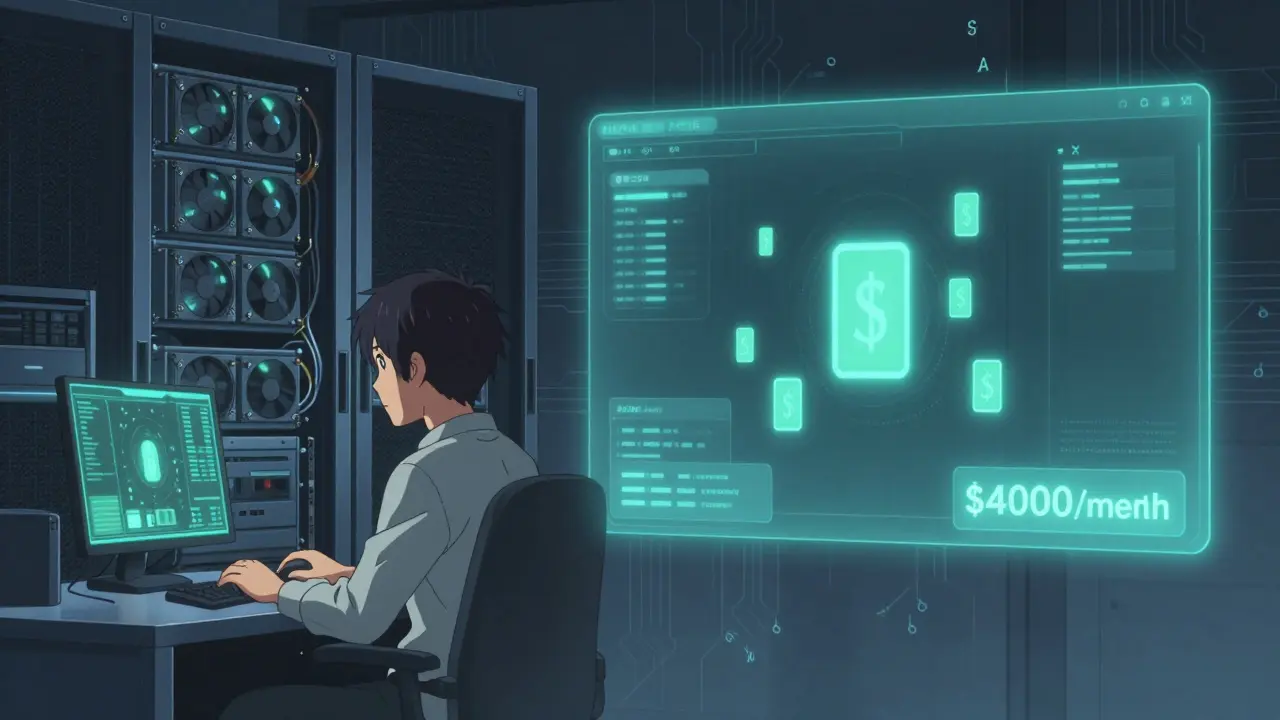

Prototypage rapide avec des API contre mise en production avec des LLM open-source

Renee Serda févr.. 18 8Prototypage rapide avec des API ou mise en production avec des LLM open-source ? Cette comparaison révèle pourquoi la plupart des projets IA échouent en production, et comment passer de l’expérimentation à l’échelle sans perdre le contrôle.

Plus d’infos

Fine-tuning efficace en paramètres des grands modèles linguistiques avec LoRA et les adaptateurs

Renee Serda févr.. 17 5LoRA et les adaptateurs permettent d'adapter des modèles linguistiques massifs avec 500 fois moins de mémoire, sans perte de précision. Découvrez comment les utiliser sur un seul GPU, leurs avantages, leurs limites et les meilleurs outils en 2026.

Plus d’infos

IA générative en construction : optimiser les offres, les plannings et les plans de sécurité

Renee Serda févr.. 16 5L'IA générative révolutionne la construction en optimisant les offres, les plannings et les plans de sécurité. Découvrez comment les outils comme ALICE et nPlan aident les entreprises à gagner du temps, réduire les risques et livrer à temps.

Plus d’infos