Caching et performance dans les applications web générées par l'IA : où commencer

Renee Serda mars. 15 8Le caching est essentiel pour réduire la latence et les coûts des applications web générées par l'IA. Découvrez comment mettre en œuvre Redis, AWS MemoryDB et le caching sémantique pour des réponses instantanées.

Plus d’infos

Agriculture et IA générative : Rapports de culture, manuels d'équipement et perspectives de marché

Renee Serda mars. 13 7En 2026, l'IA générative transforme l'agriculture en fournissant des rapports de culture personnalisés, des manuels d'équipement intelligents et des prévisions de marché en temps réel. Elle aide les petits et grands agriculteurs à prendre de meilleures décisions, avec une transparence et une fiabilité sans précédent.

Plus d’infos

Personnalisation du parcours client avec l'IA générative : segmentation en temps réel et contenu dynamique

Renee Serda mars. 11 6L'IA générative permet de personnaliser en temps réel chaque interaction client grâce à une analyse avancée des comportements. Découvrez comment les entreprises obtiennent jusqu'à 20 % de plus de satisfaction et 15 % de croissance revenue, tout en évitant les pièges de la sur-personnalisation.

Plus d’infos

Vibe Coding et DevOps : Réinventer les pipelines et les pratiques d'astreinte

Renee Serda mars. 10 8Le vibe coding transforme le DevOps en une conversation naturelle avec l'IA. Déployez, testez et surveillez votre infrastructure en quelques mots, sans code manuel. Découvrez comment les agents intelligents réinventent les pipelines et les pratiques d'astreinte.

Plus d’infos

Comment les modèles linguistiques massifs généralisent : apprentissage des motifs vs raisonnement explicite

Renee Serda mars. 9 0Les modèles linguistiques massifs ne raisonnent pas : ils reconnaissent des motifs. Cette distinction fondamentale explique pourquoi ils brillent dans certains domaines et échouent dans d'autres. Comprendre cette limite est essentiel pour les utiliser avec intelligence.

Plus d’infos

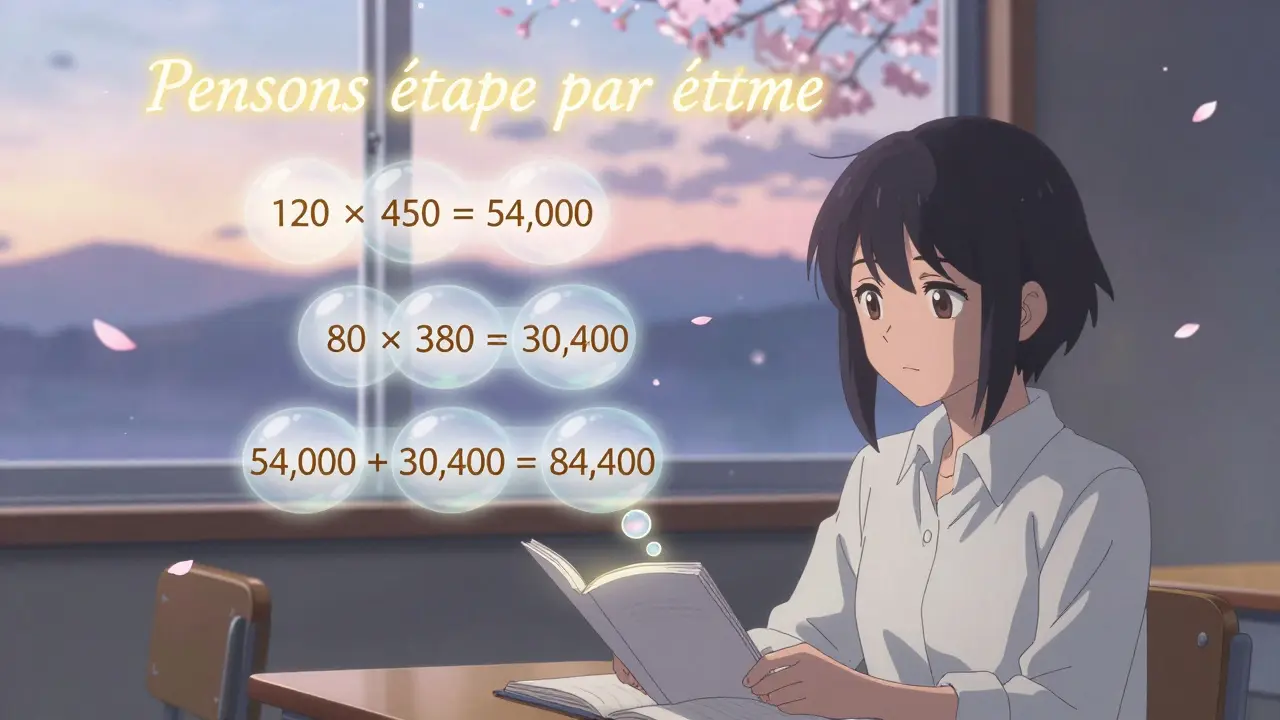

Chain-of-Thought Prompting en IA générative : un guide étape par étape pour les tâches complexes

Renee Serda mars. 7 6Le Chain-of-Thought Prompting permet aux IA génératives de résoudre des tâches complexes en montrant leurs étapes de raisonnement. Découvrez comment ça marche, ses avantages, ses pièges et comment l’appliquer en 2026.

Plus d’infos

Gain de productivité avec les assistants IA pour le développement logiciel

Renee Serda mars. 6 5Les assistants IA comme GitHub Copilot augmentent la productivité des développeurs, mais seulement si on les utilise bien. Découvrez les chiffres réels, les pièges à éviter et les meilleures pratiques pour 2026.

Plus d’infos

Calibration Post-Entraînement des Modèles de Langage : Confiance et Abstention

Renee Serda mars. 3 10La calibration post-entraînement permet aux modèles de langage de mieux exprimer leur confiance ou leur incertitude. Elle améliore la fiabilité sans changer les connaissances du modèle, et est essentielle pour les applications critiques.

Plus d’infos

Stratégies de découpage qui améliorent la qualité de récupération dans les systèmes RAG pour grands modèles linguistiques

Renee Serda févr.. 28 9Les stratégies de découpage des documents dans les systèmes RAG déterminent la qualité des réponses des modèles linguistiques. Le découpage par page avec recouvrement est la méthode la plus efficace, selon des études récentes. Découvrez comment optimiser votre système pour éviter les hallucinations et améliorer la précision.

Plus d’infos

IA générative préservant la vie privée : chiffrement homomorphe et enclaves sécurisées

Renee Serda févr.. 27 5Le chiffrement homomorphe permet à l'IA générative de traiter des données sensibles sans jamais les déchiffrer. Une avancée majeure pour la santé, la finance et la protection de la vie privée, déjà en production en 2025.

Plus d’infos

Apprentissage Continuel dans l'IA Générative : S'Adapter Sans Oublis Catastrophiques

Renee Serda févr.. 26 8L'apprentissage continu dans l'IA générative permet aux modèles de s'adapter sans oublier ce qu'ils ont appris. Découvrez les méthodes les plus efficaces, les limites réelles et pourquoi Google Nested Learning change la donne en 2026.

Plus d’infos

Choix de conception des tokenizeurs et leur impact sur la qualité des grands modèles de langage

Renee Serda févr.. 25 9Le choix du tokenizer influence directement la précision, la vitesse et la capacité des grands modèles de langage. BPE, WordPiece et Unigram ont des impacts différents selon les données. Une mauvaise configuration peut réduire la performance de 15 %.

Plus d’infos